Examples¶

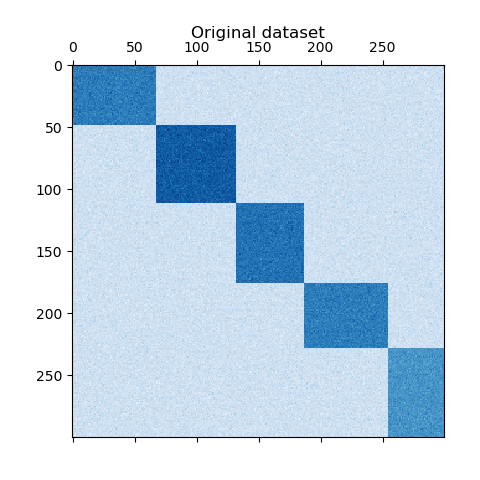

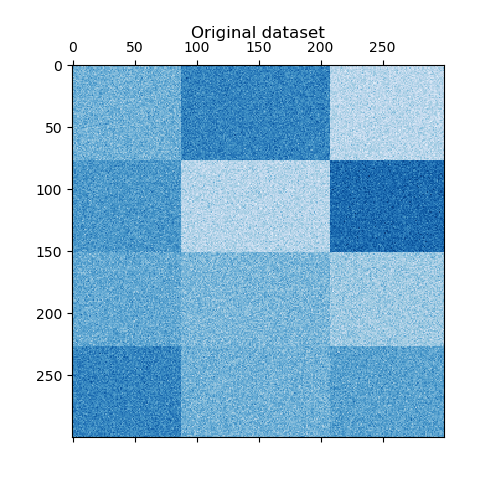

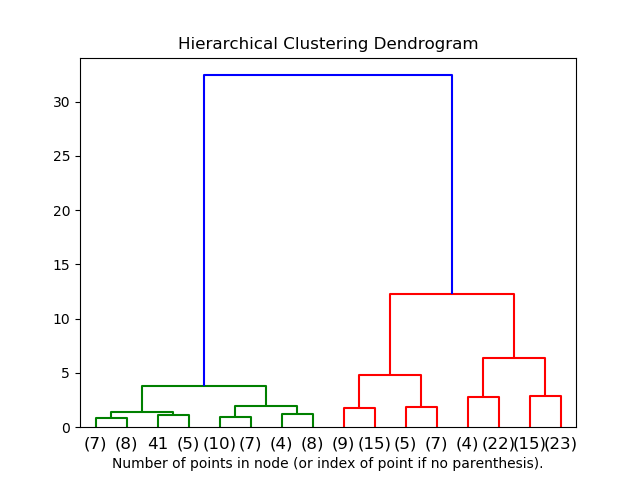

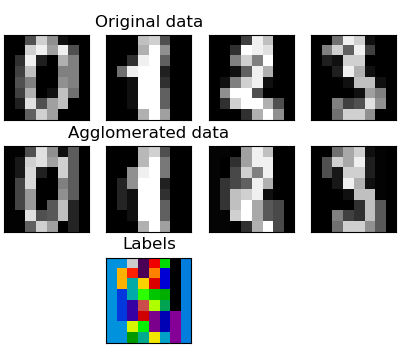

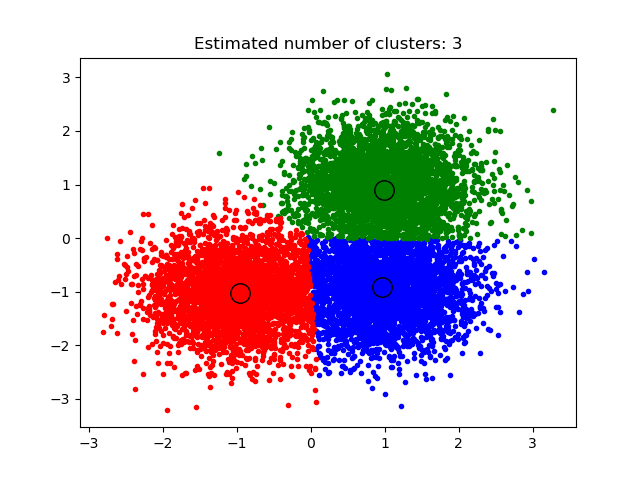

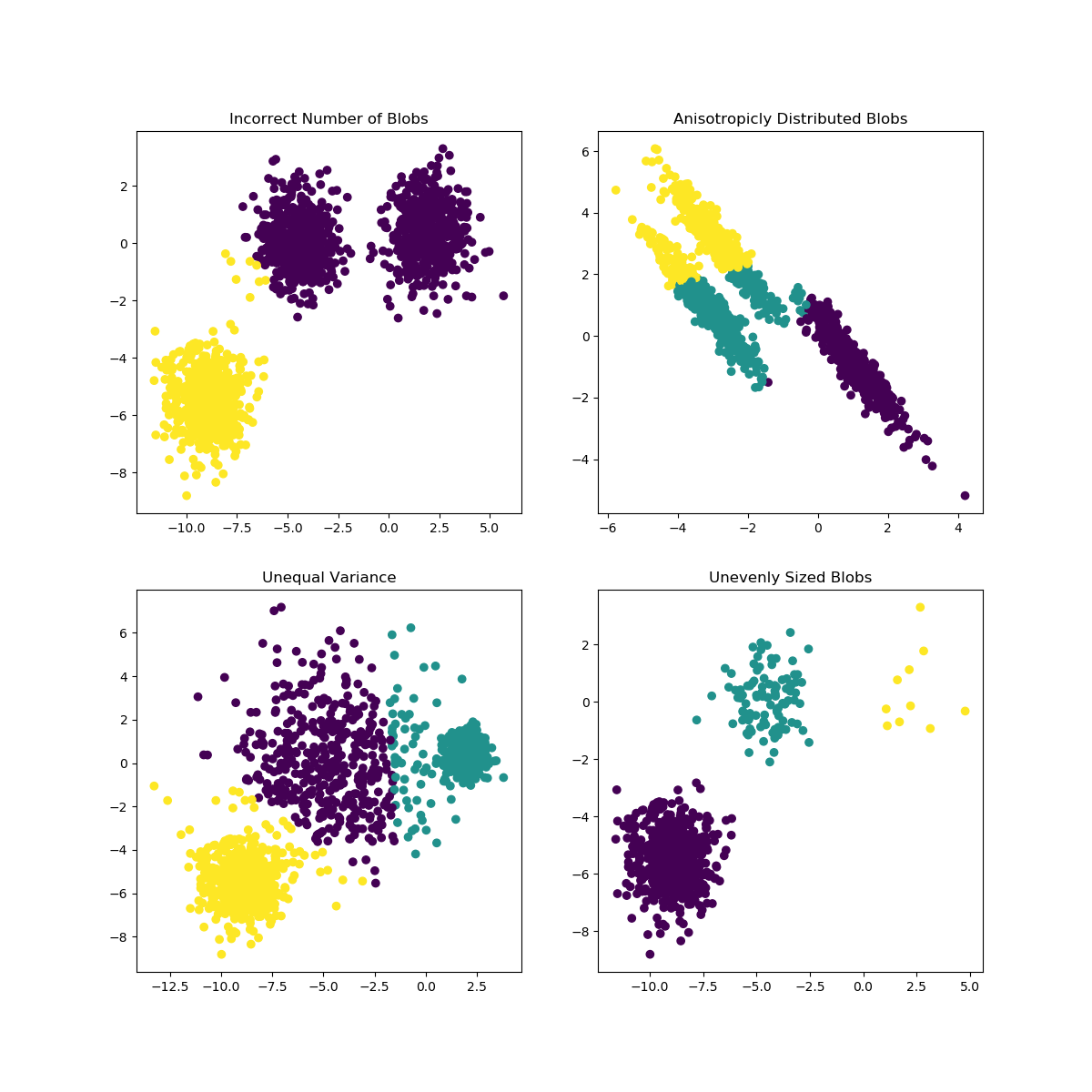

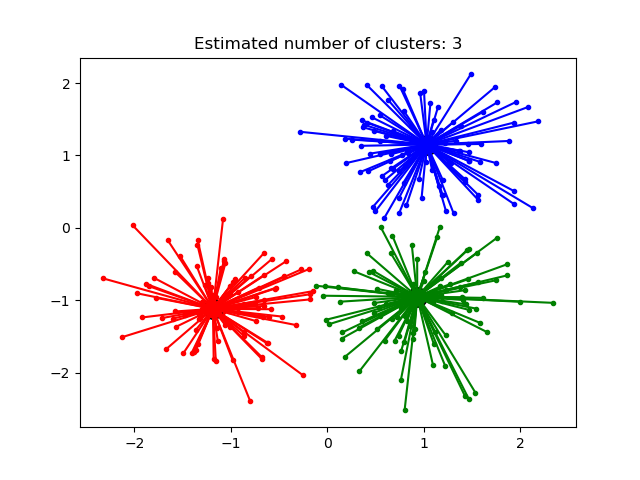

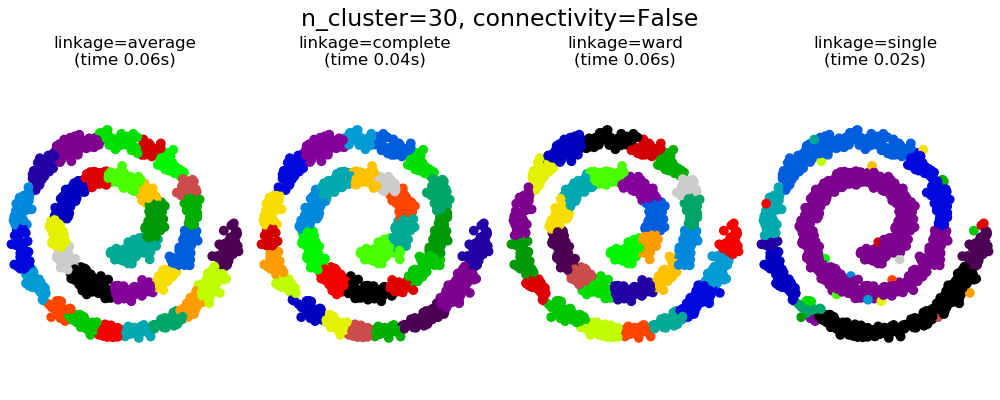

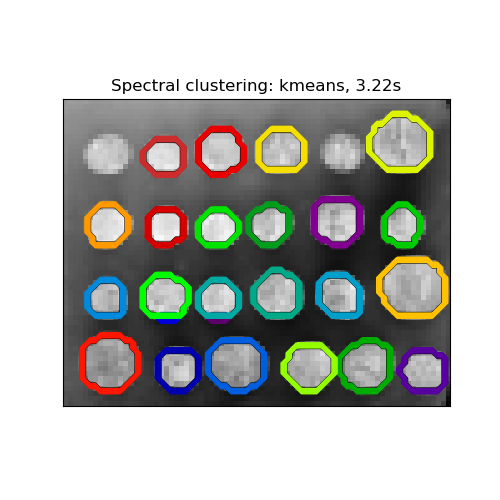

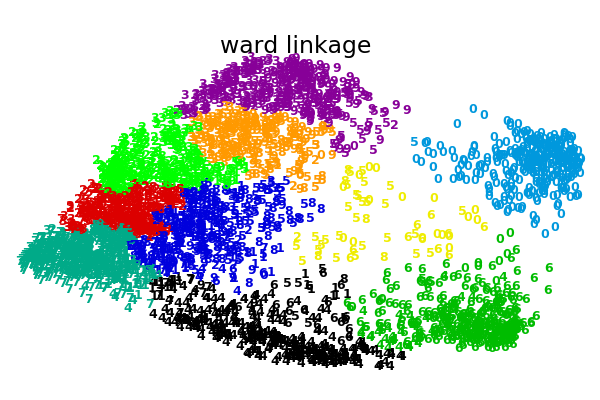

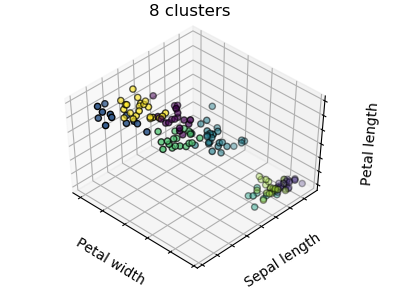

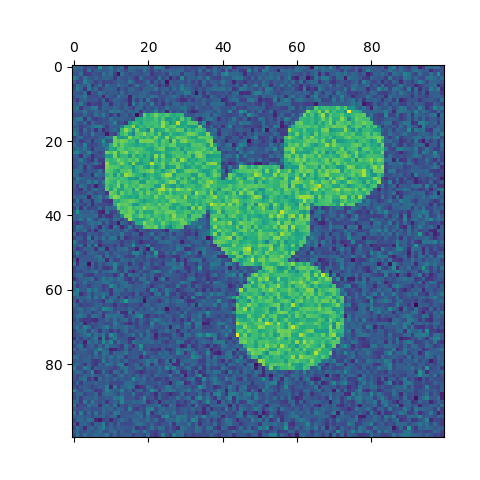

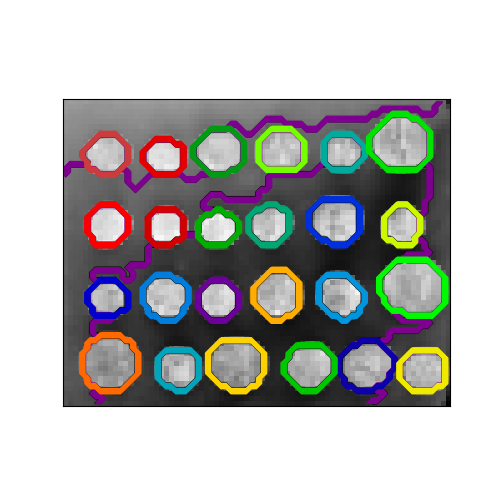

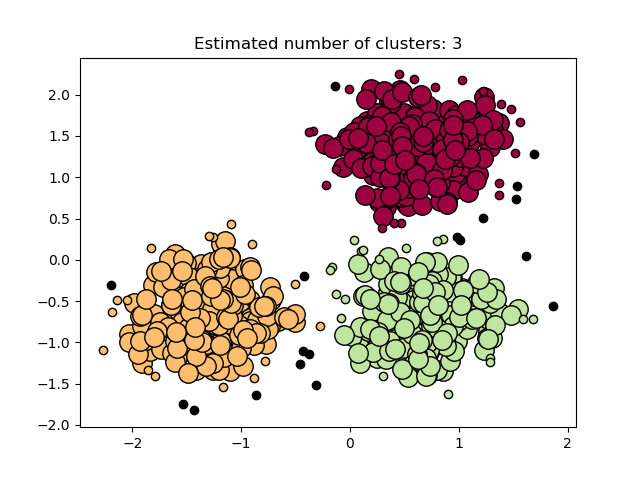

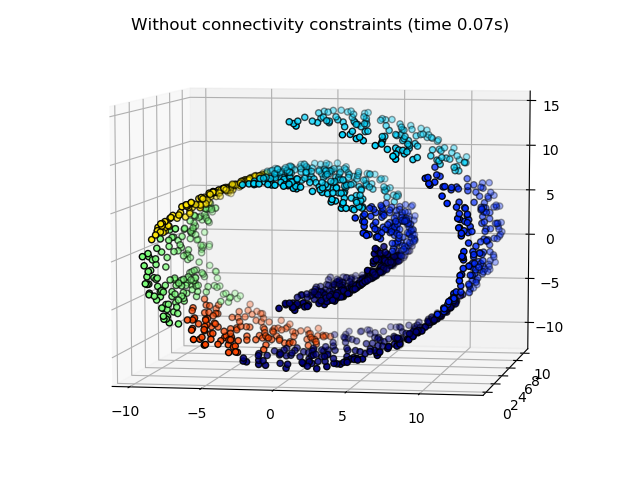

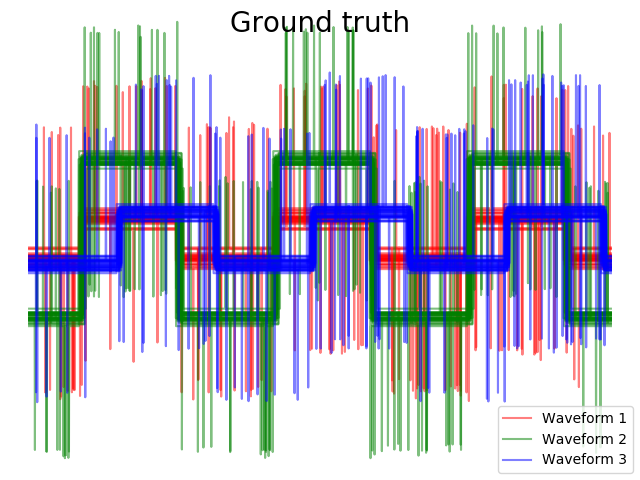

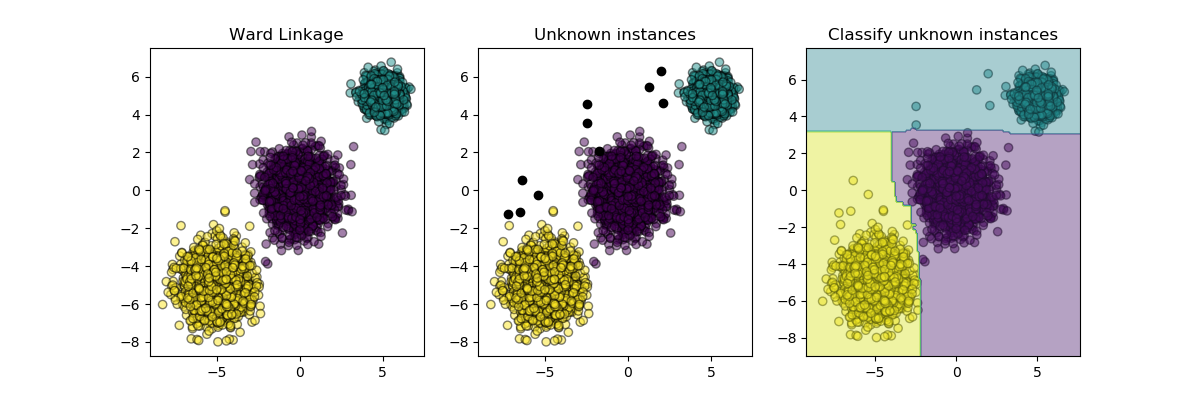

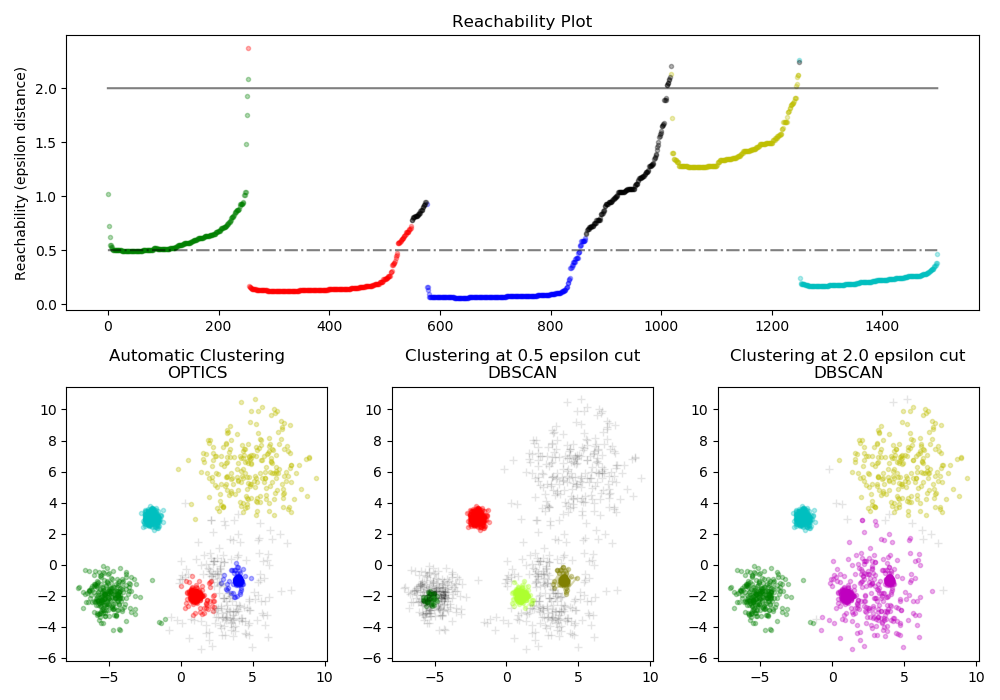

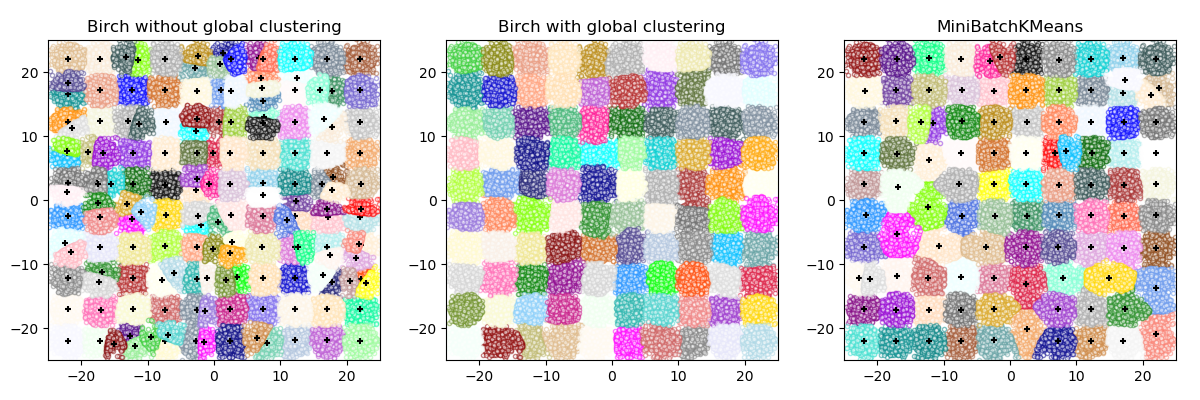

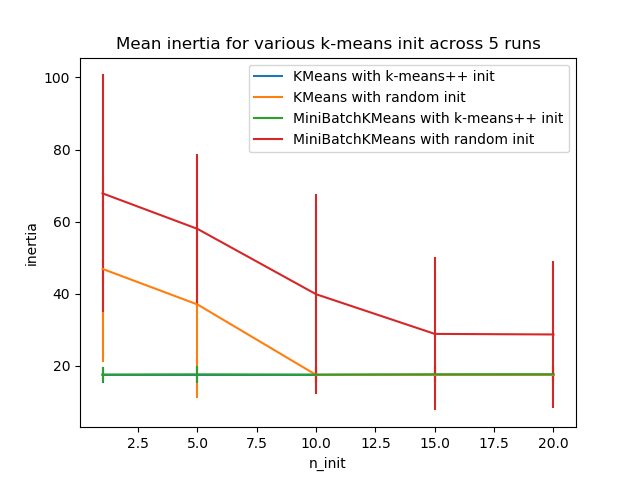

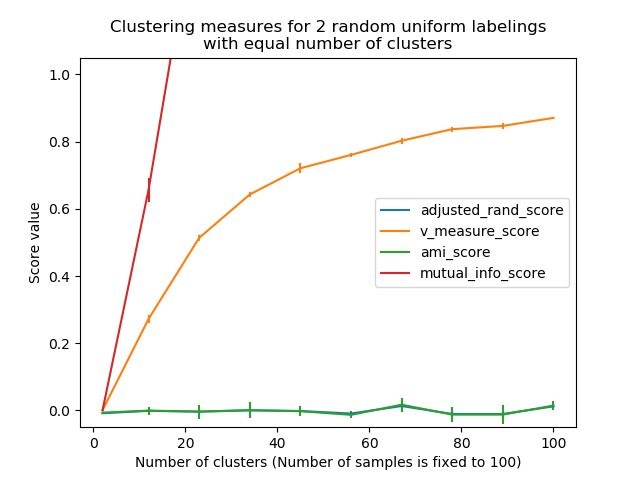

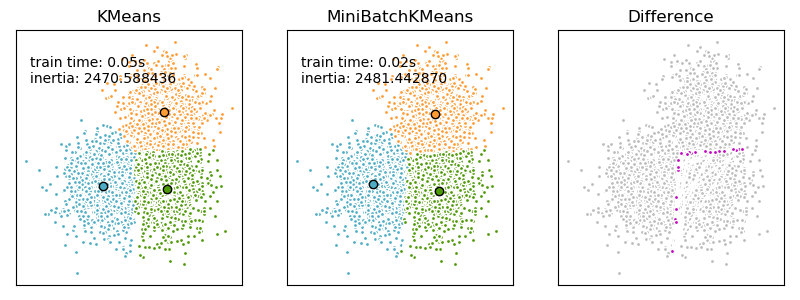

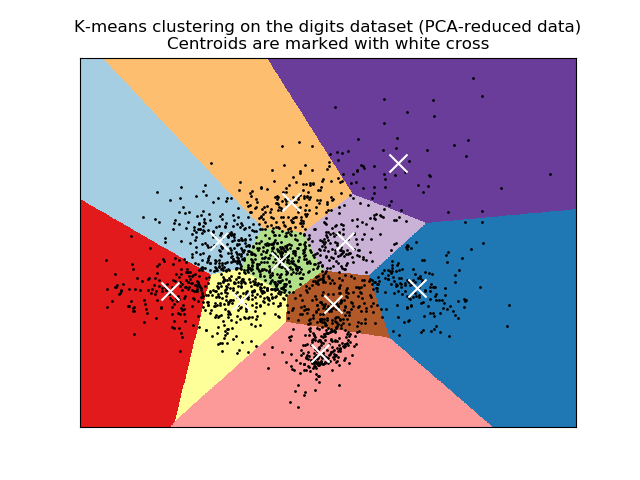

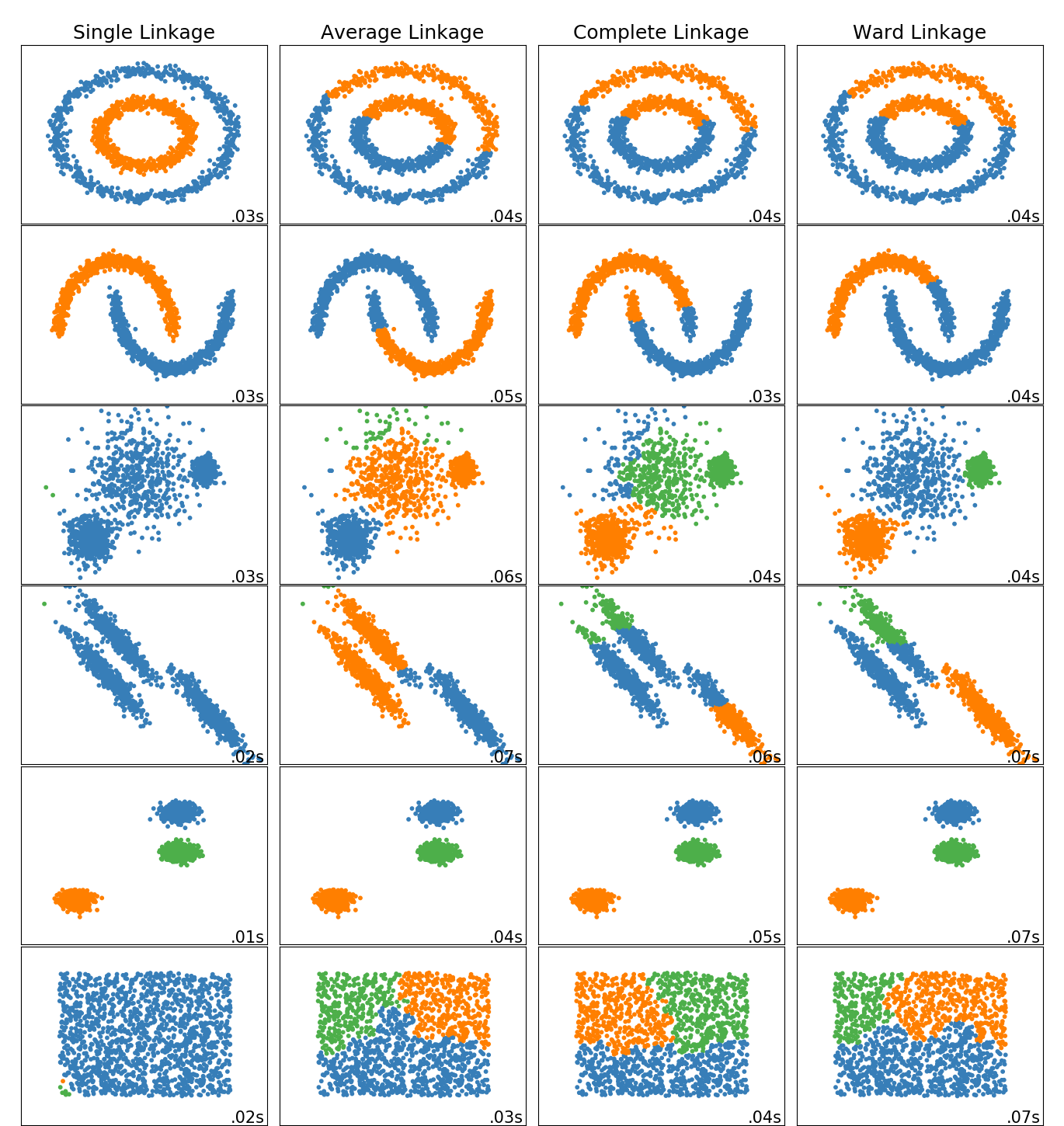

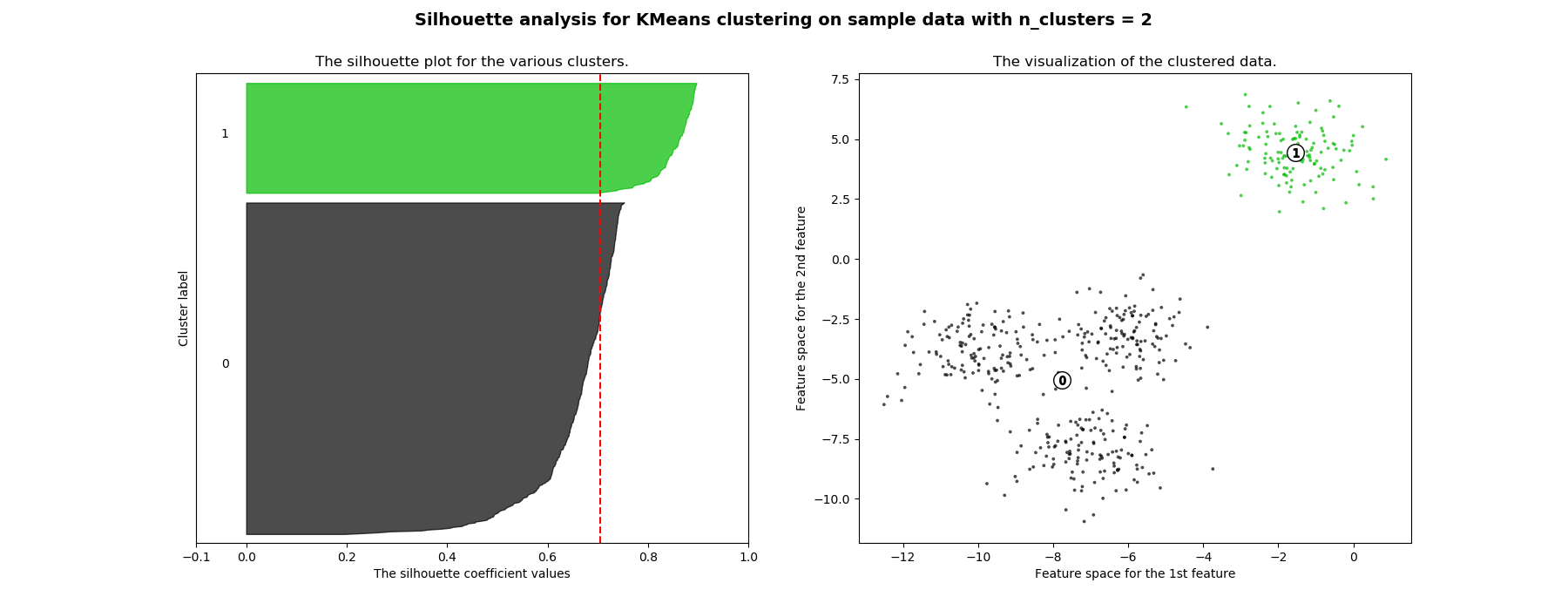

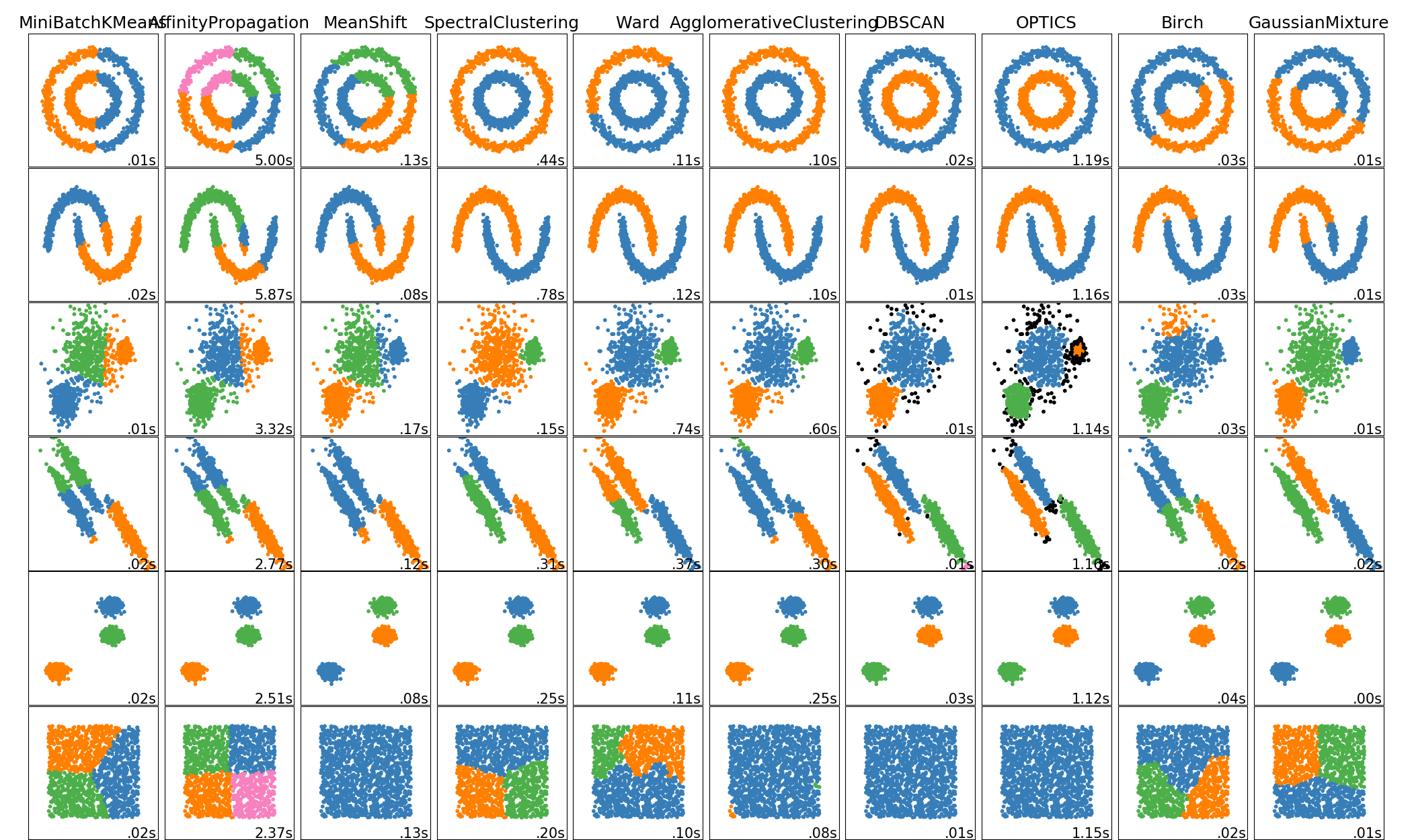

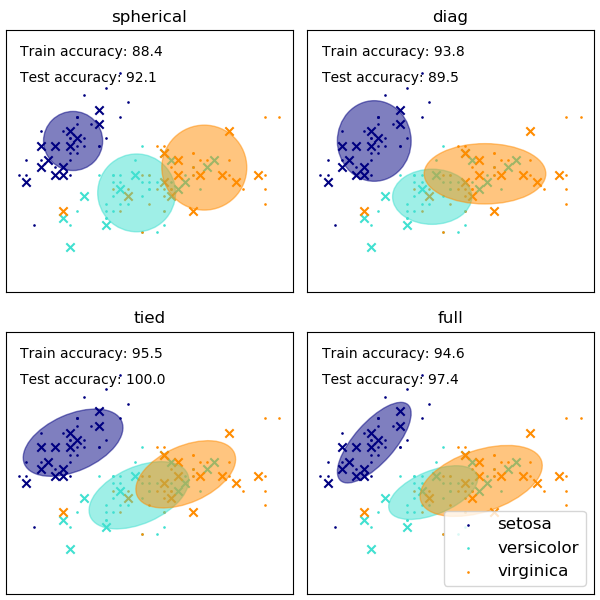

聚类 ¶

有关sklearn.cluster模块的示例。

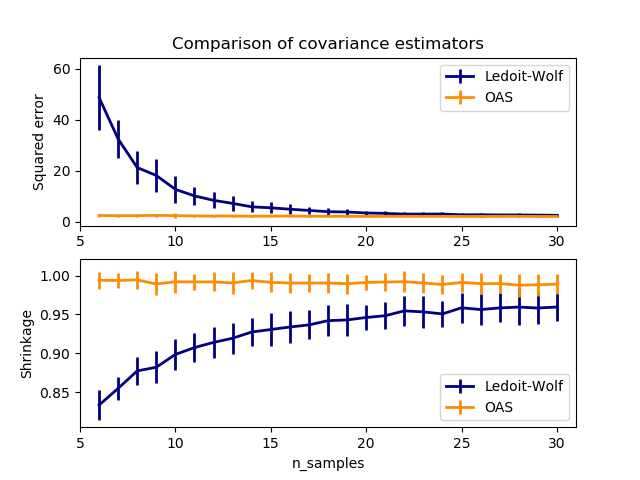

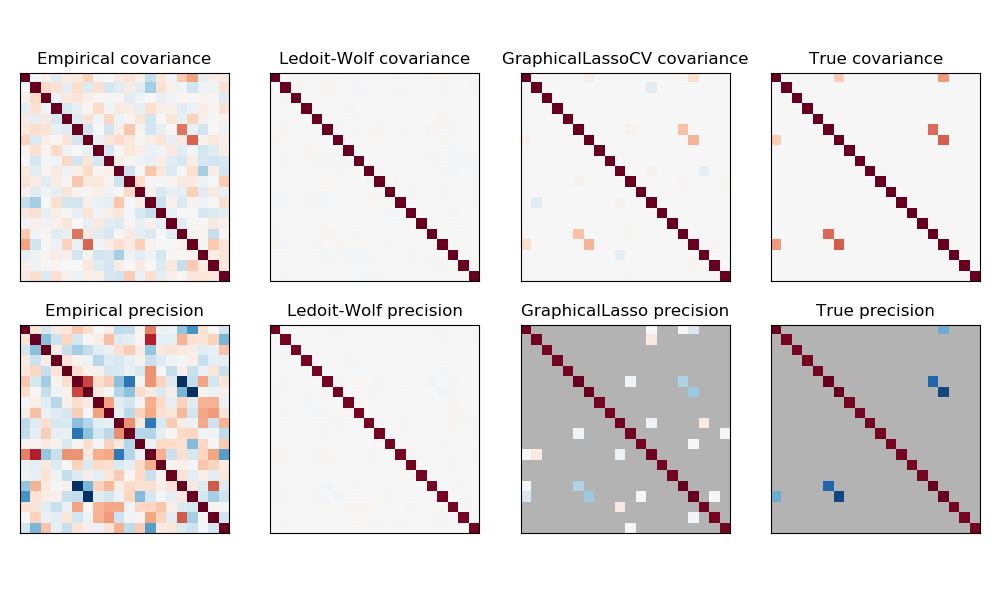

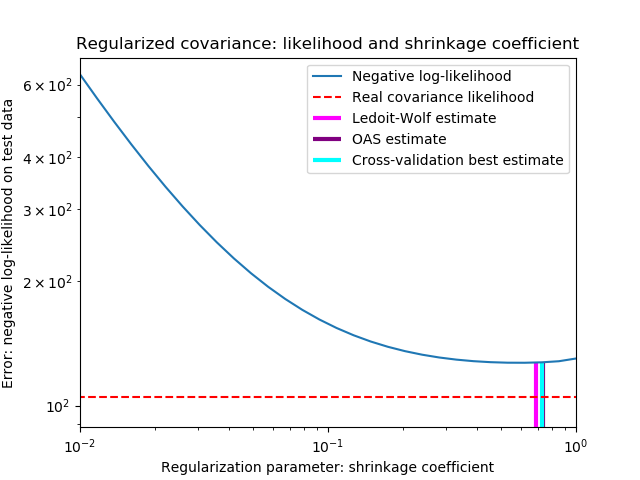

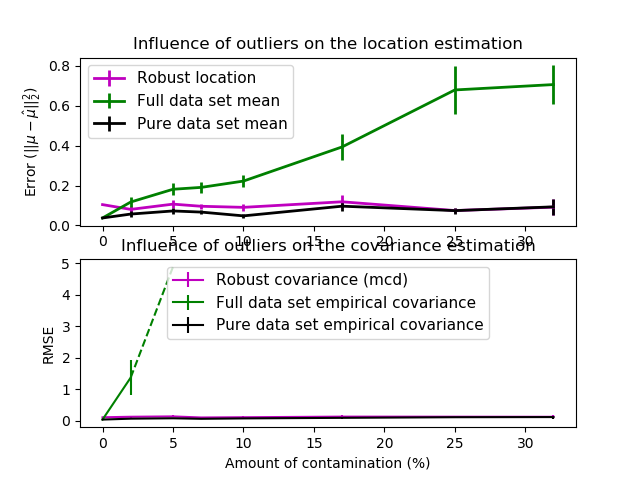

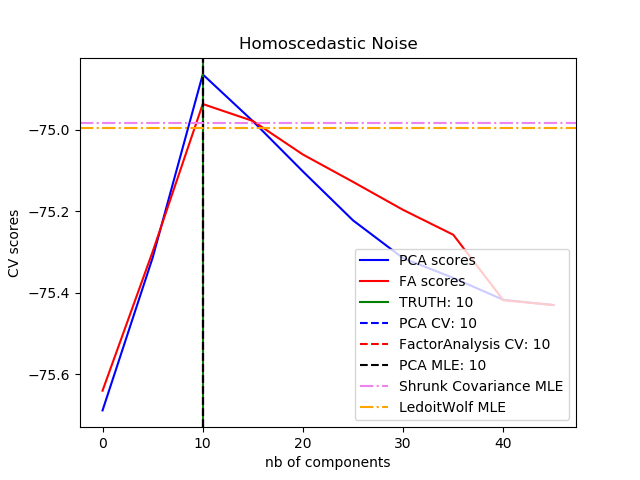

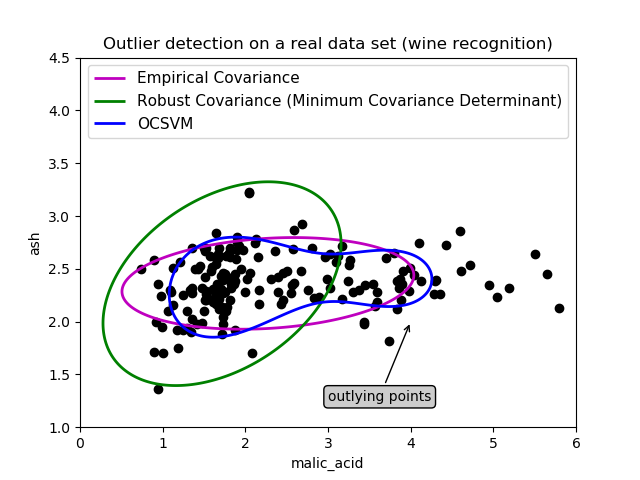

协方差估计 ¶

有关sklearn.covariance模块的示例。

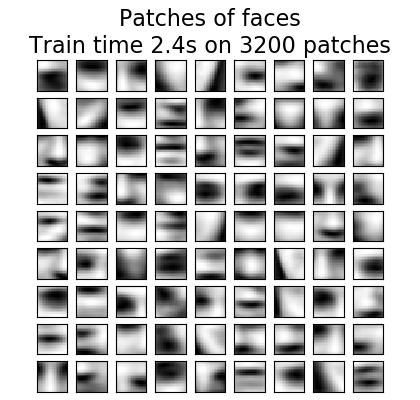

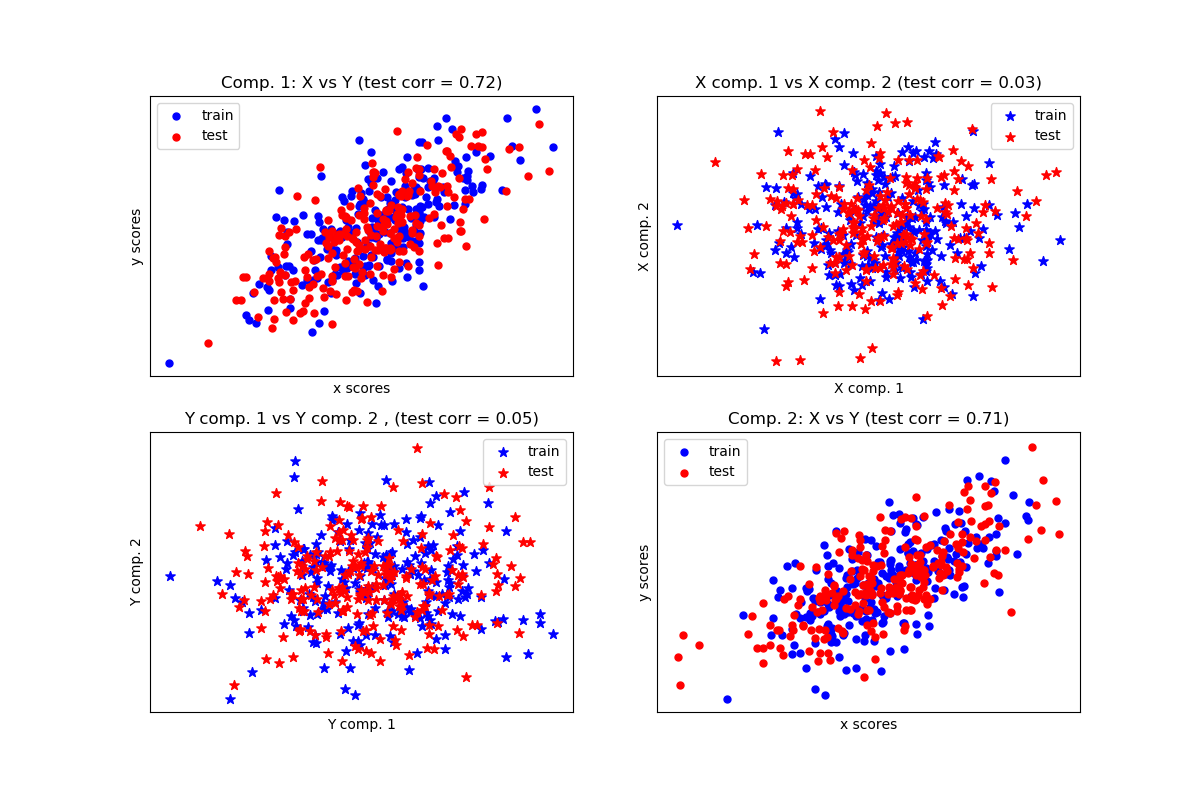

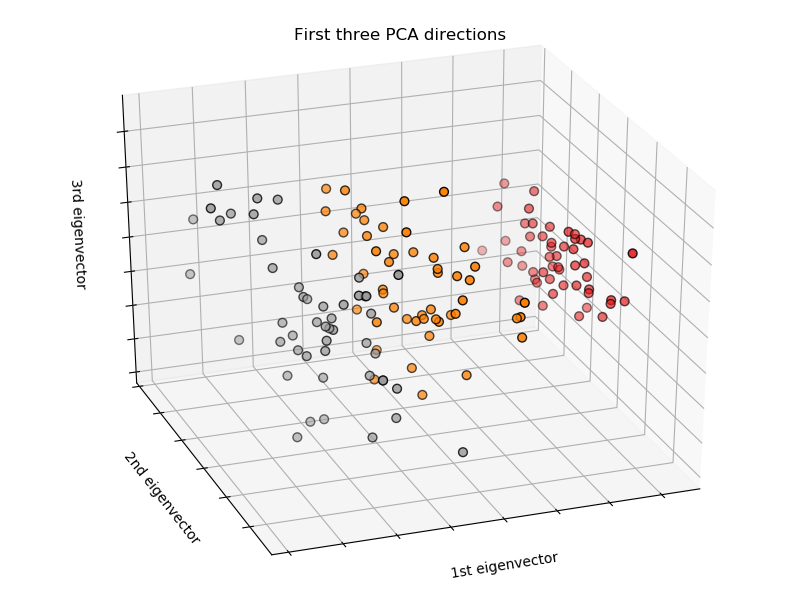

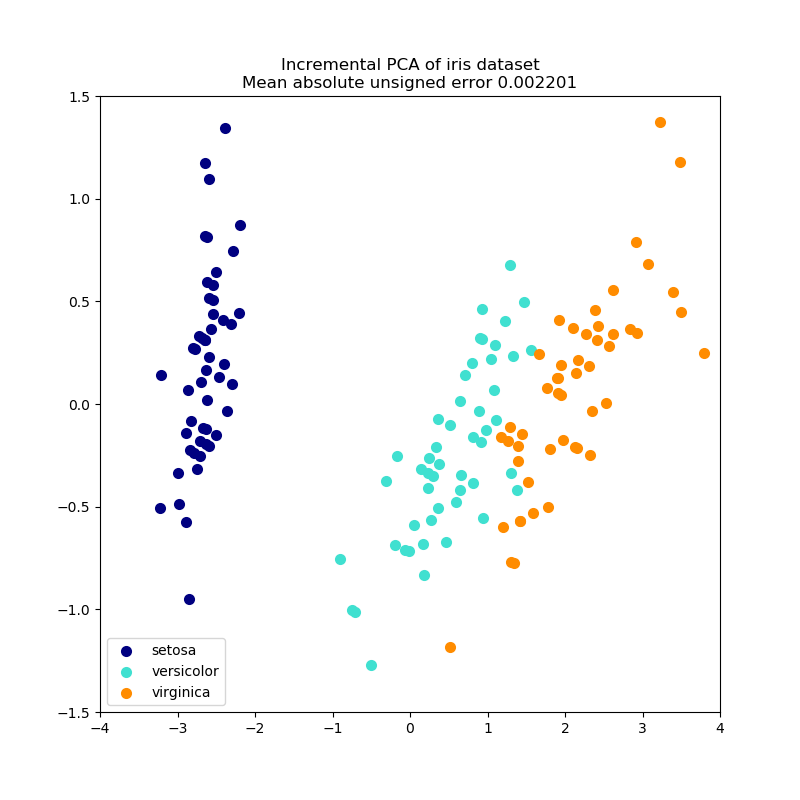

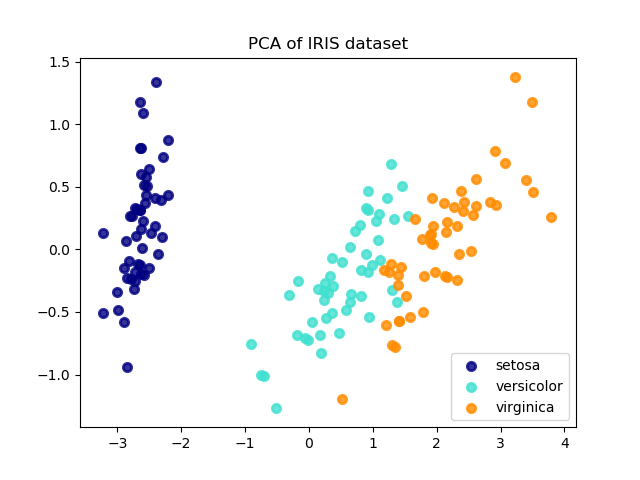

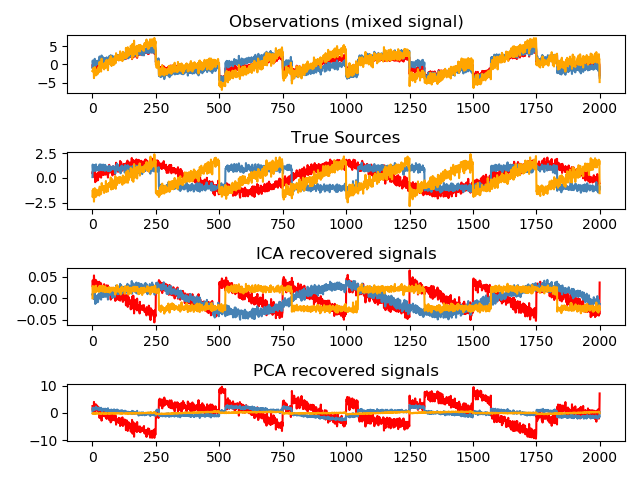

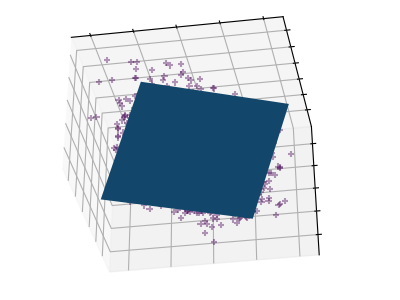

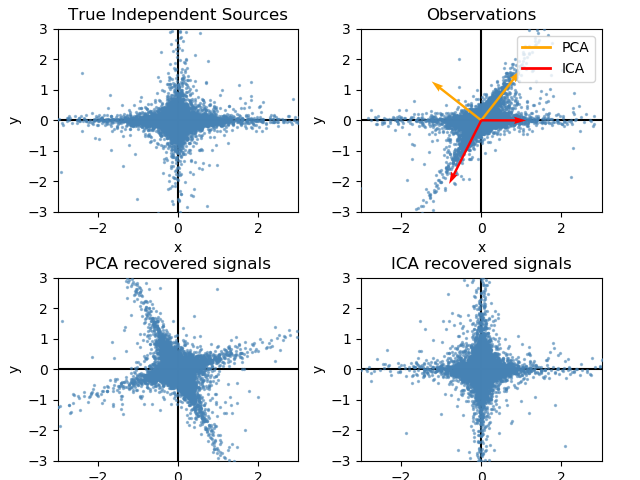

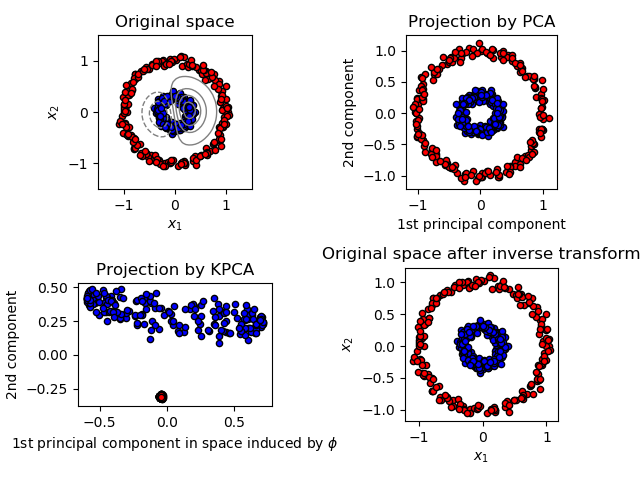

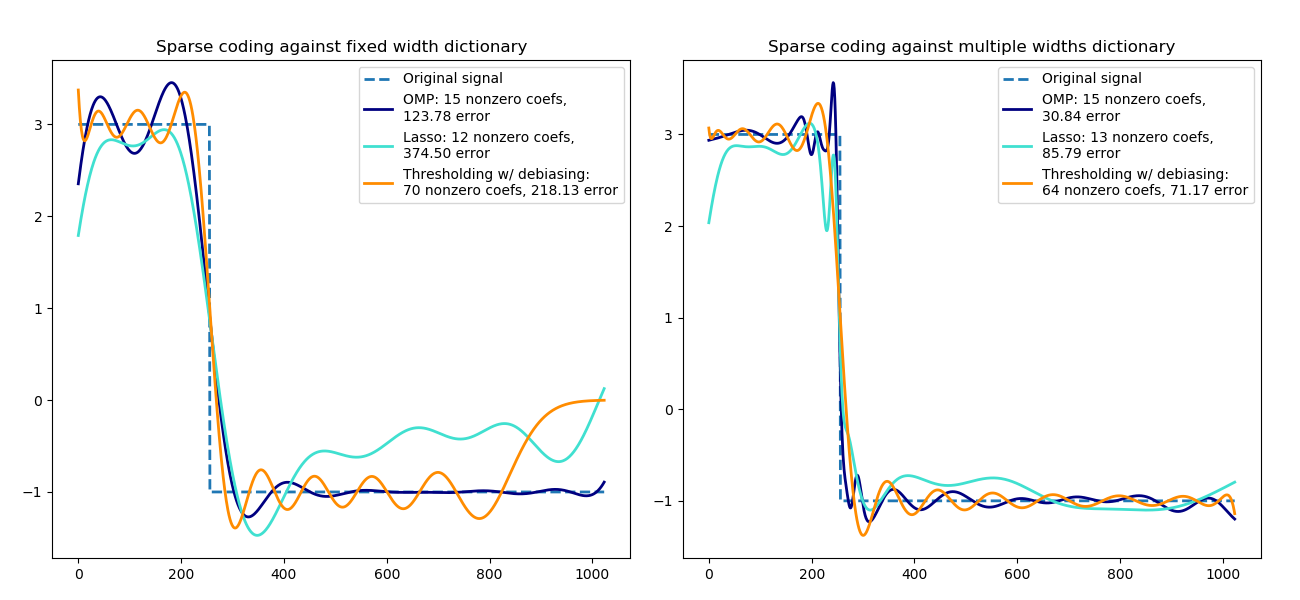

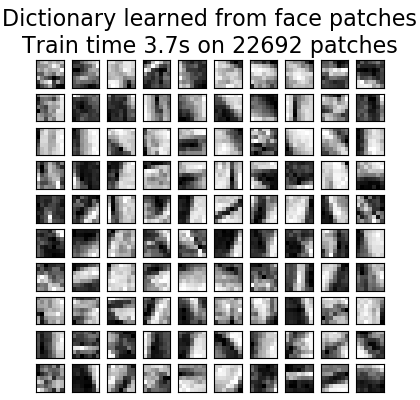

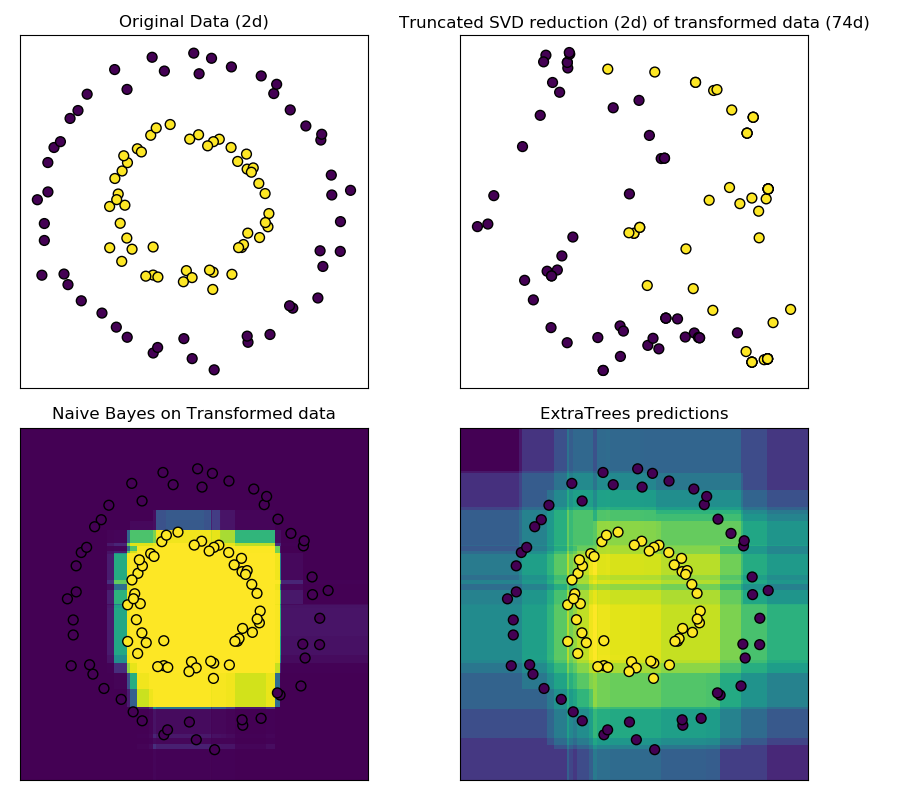

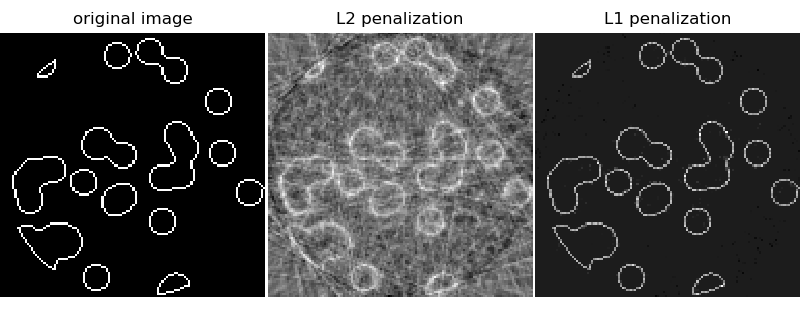

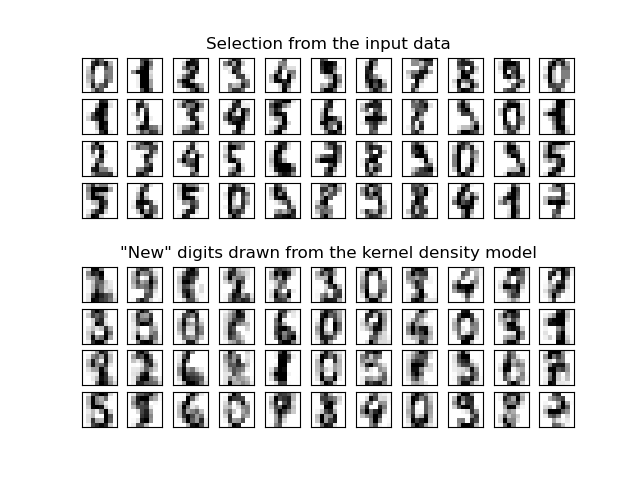

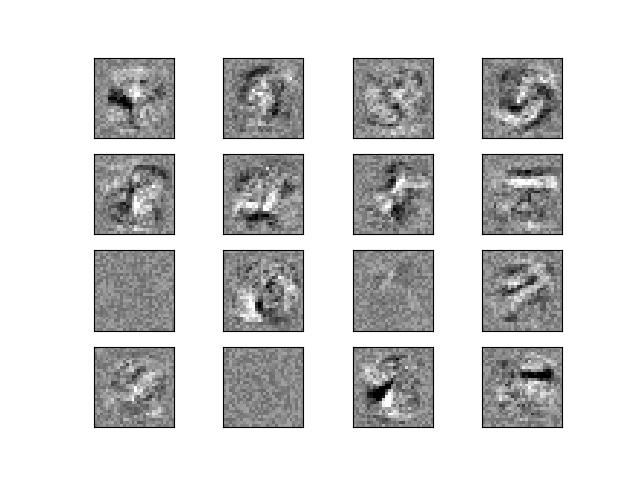

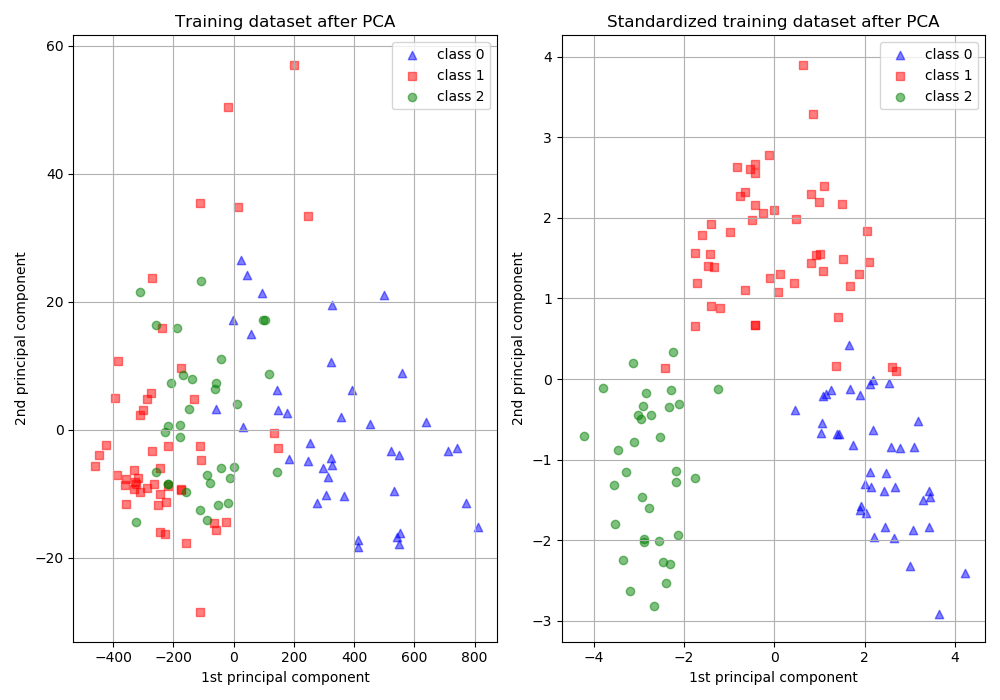

分解 ¶

有关sklearn.decomposition模块的示例。

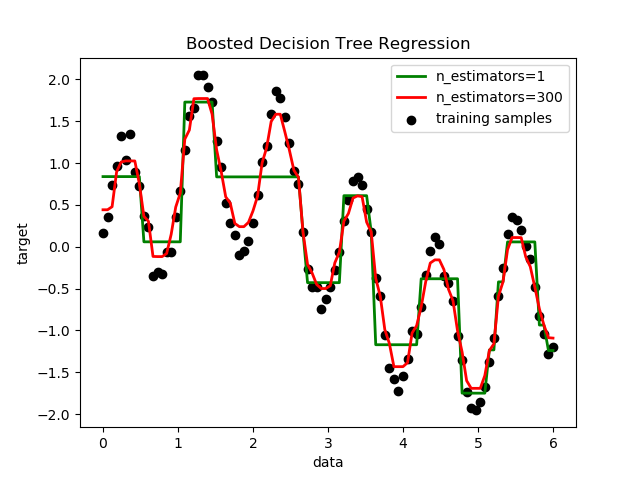

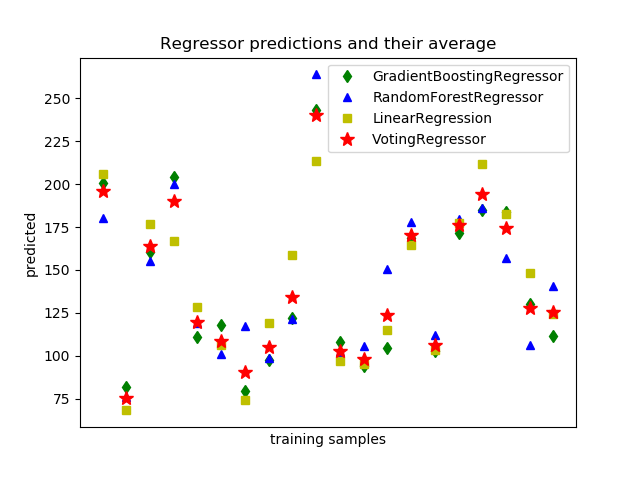

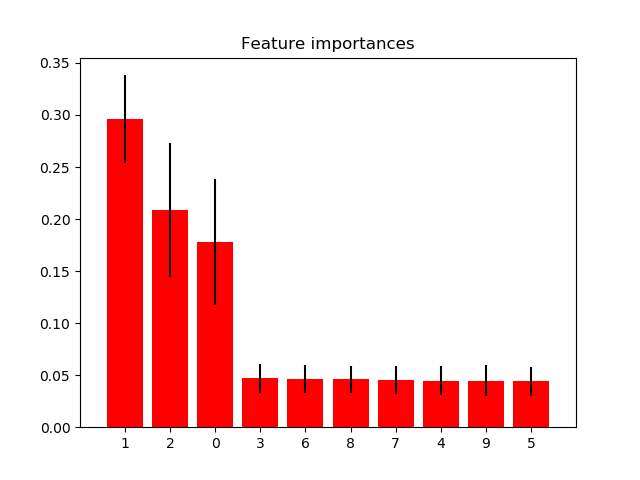

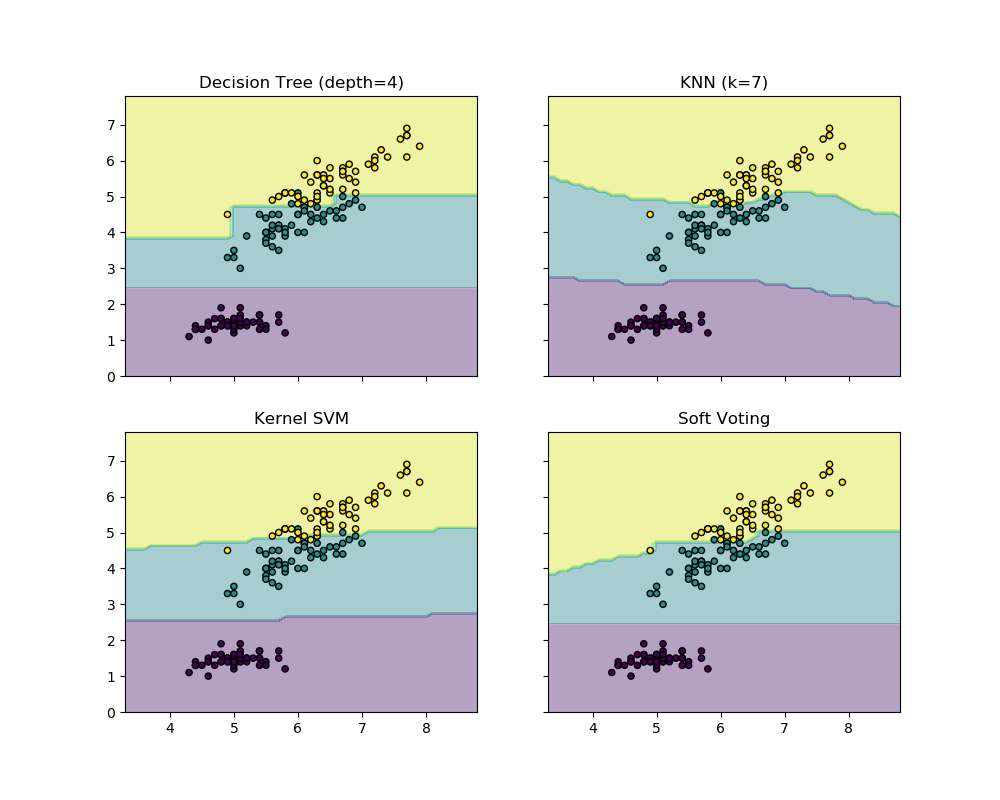

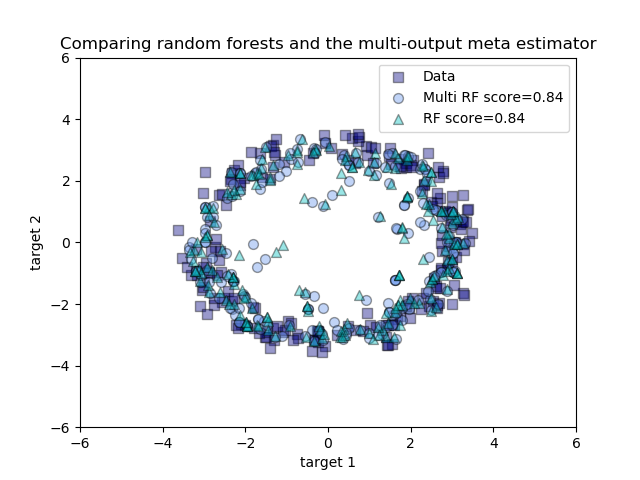

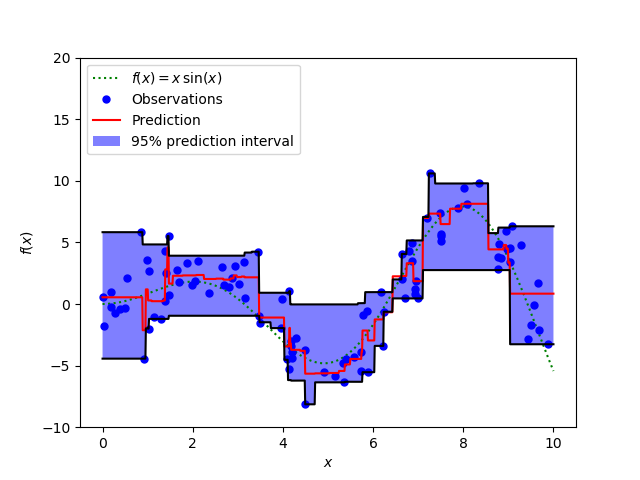

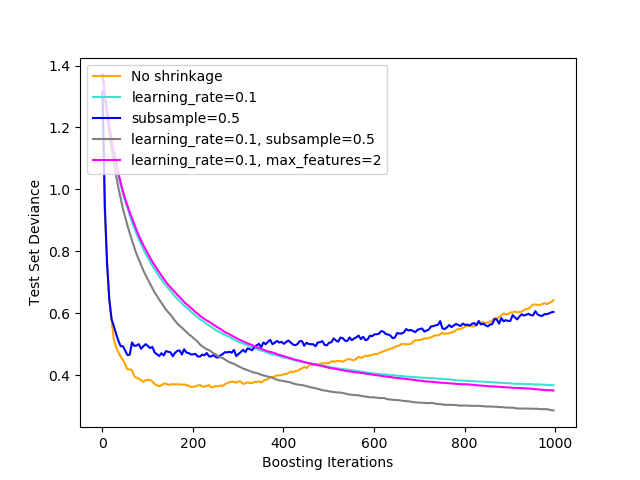

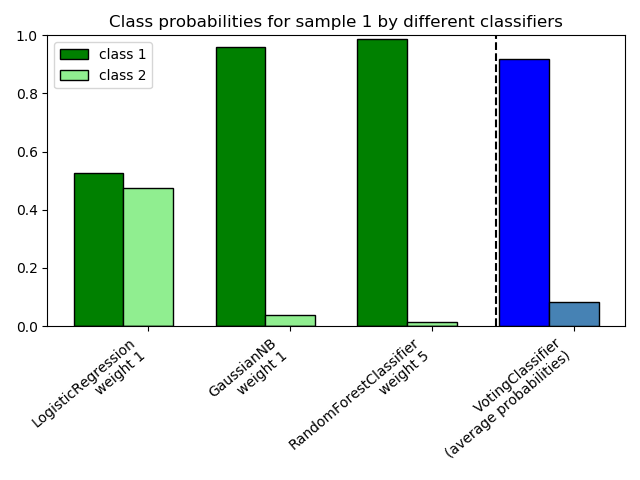

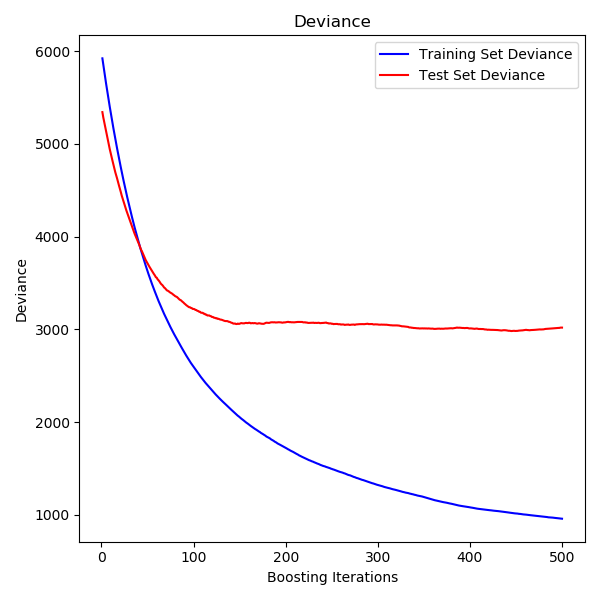

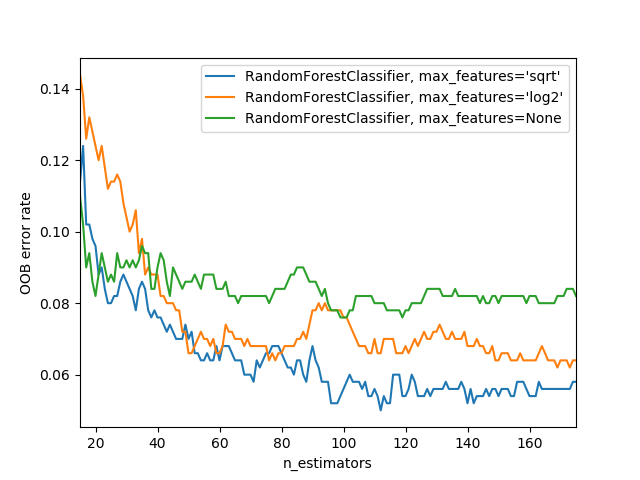

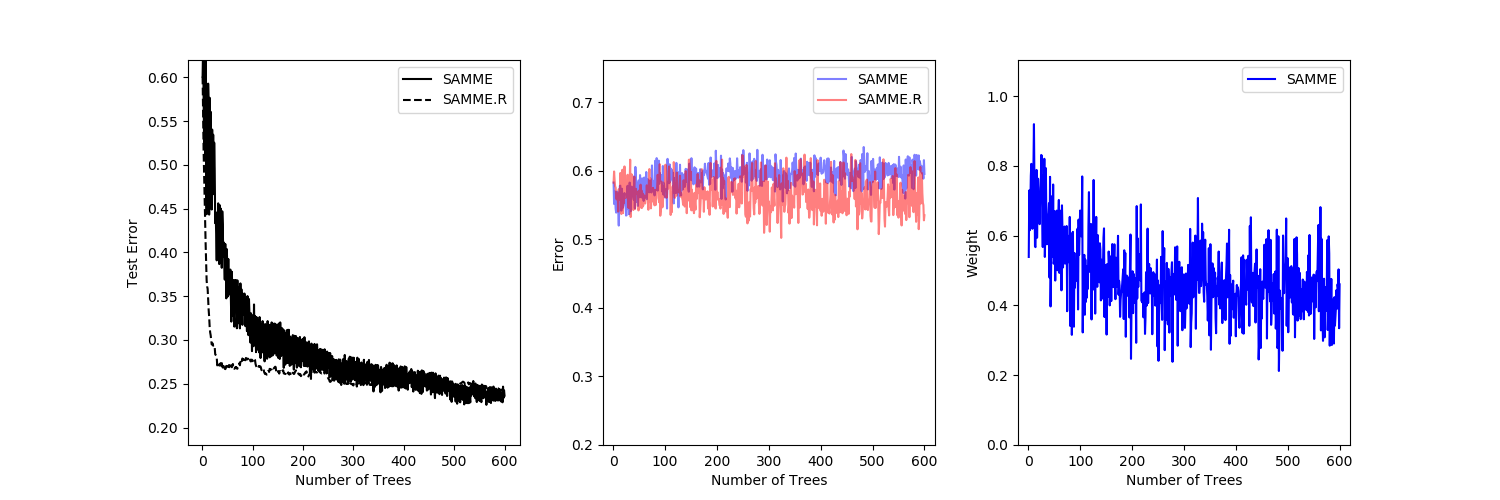

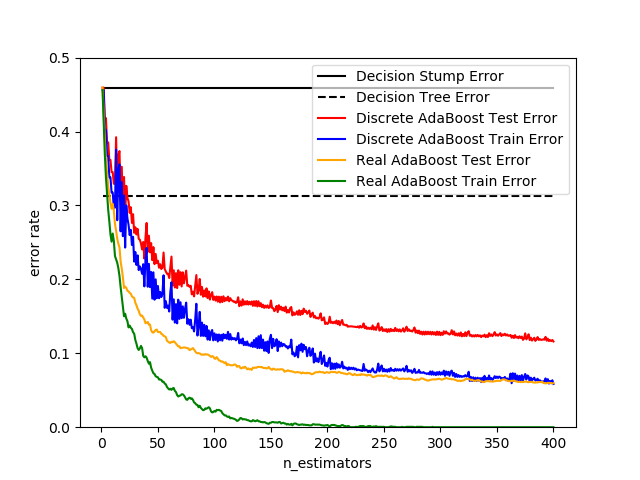

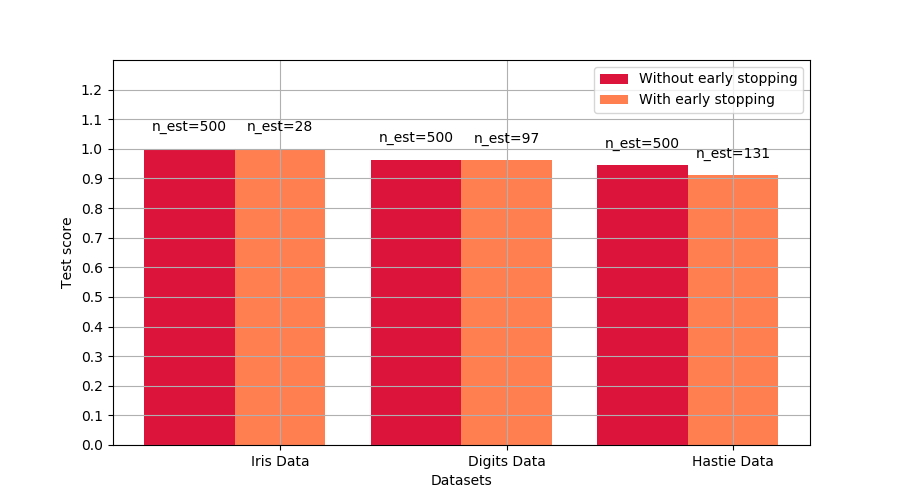

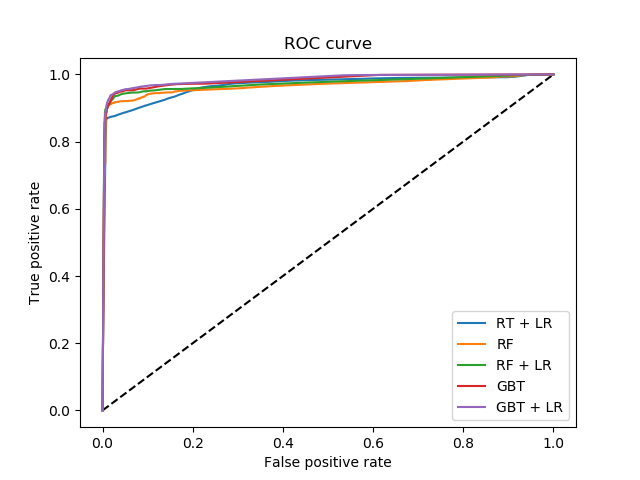

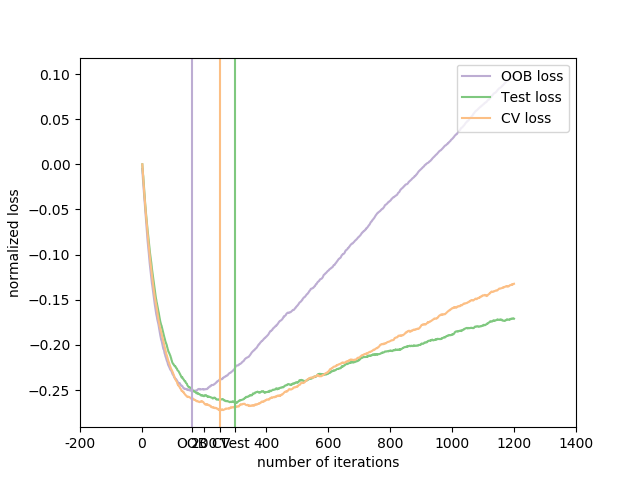

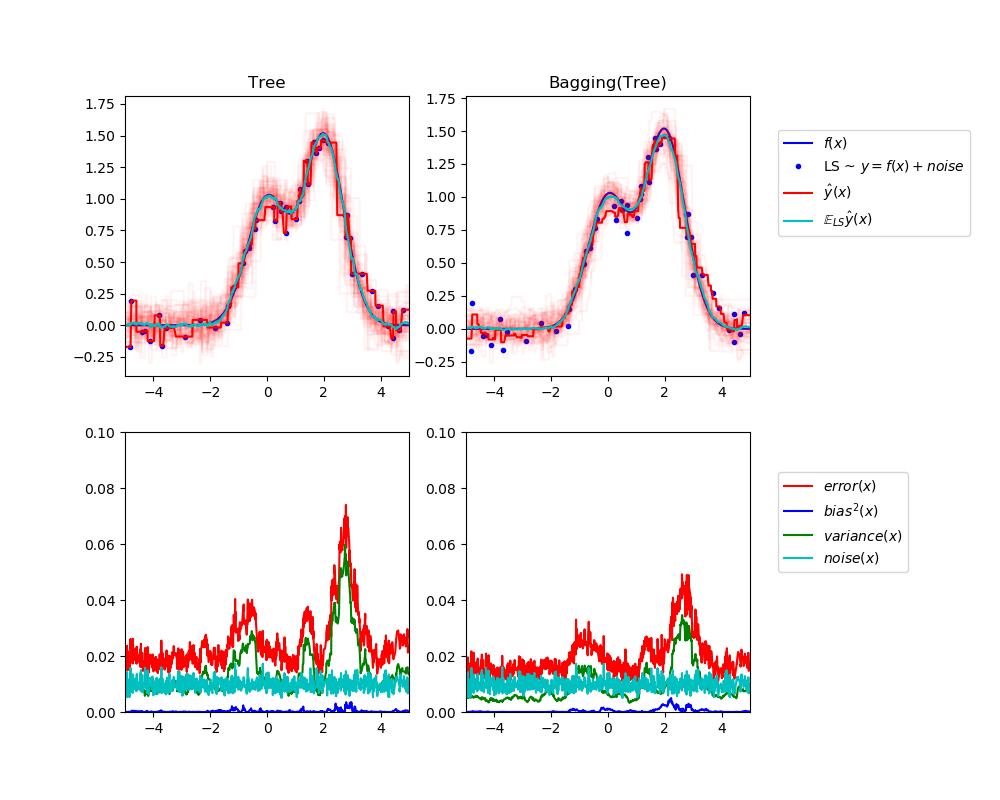

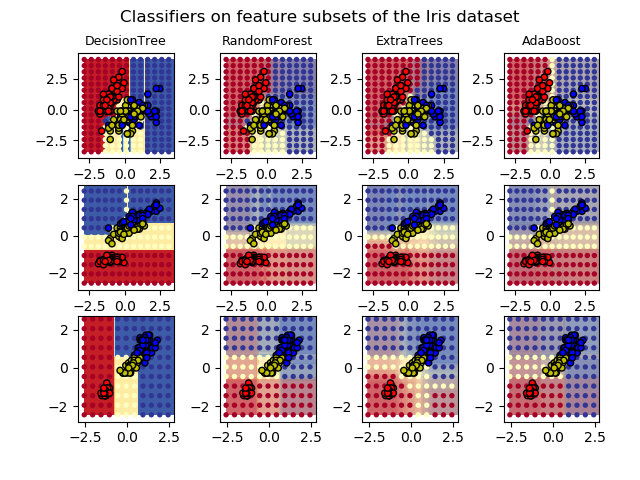

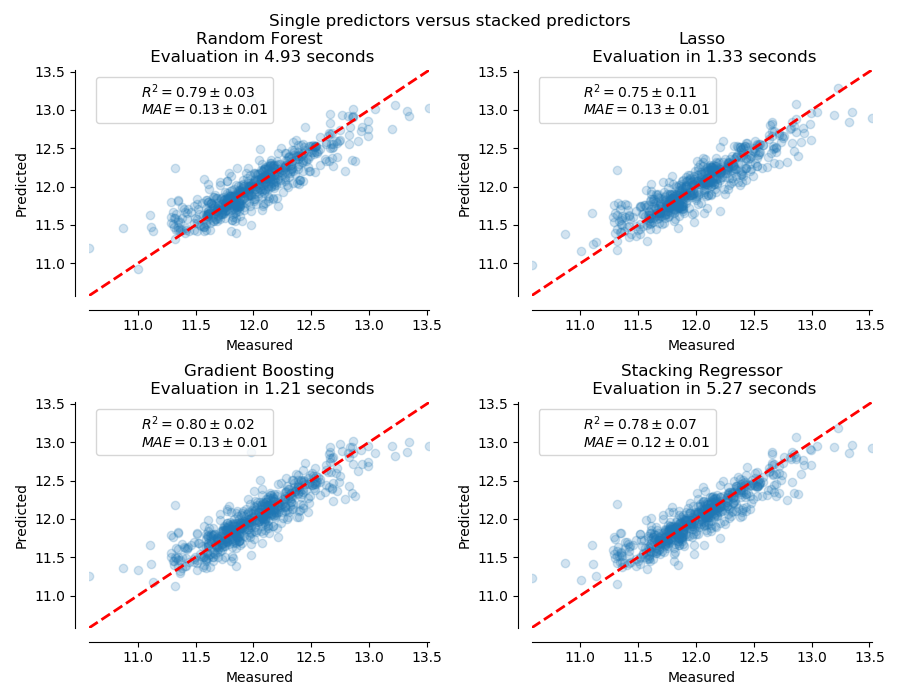

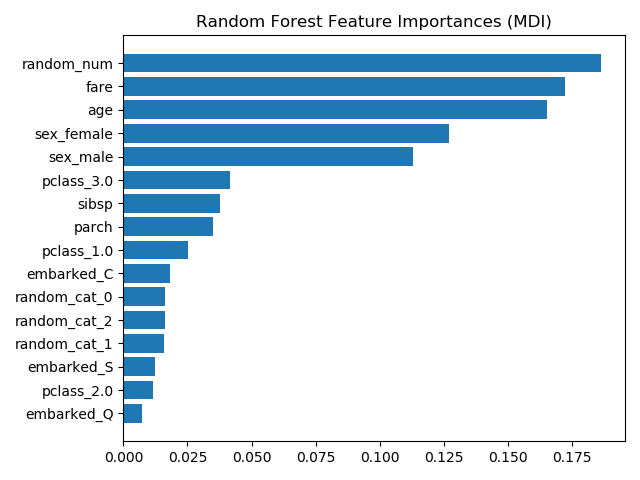

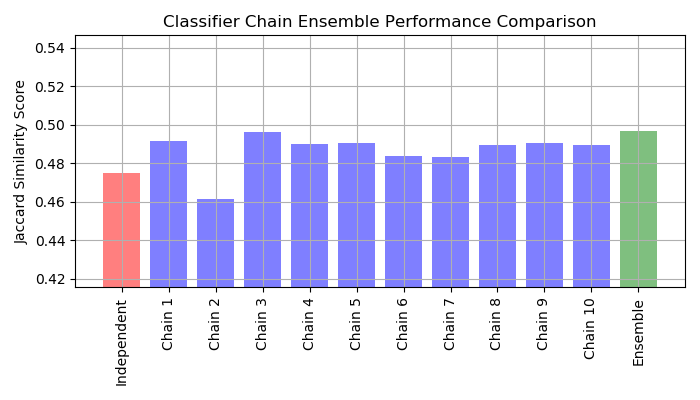

集成方法 ¶

有关sklearn.ensemble模块的示例。

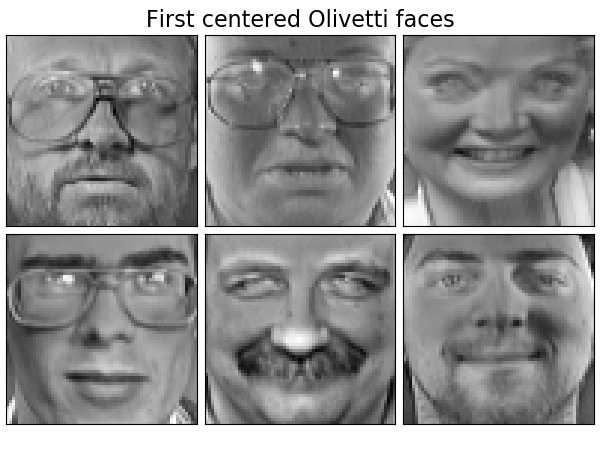

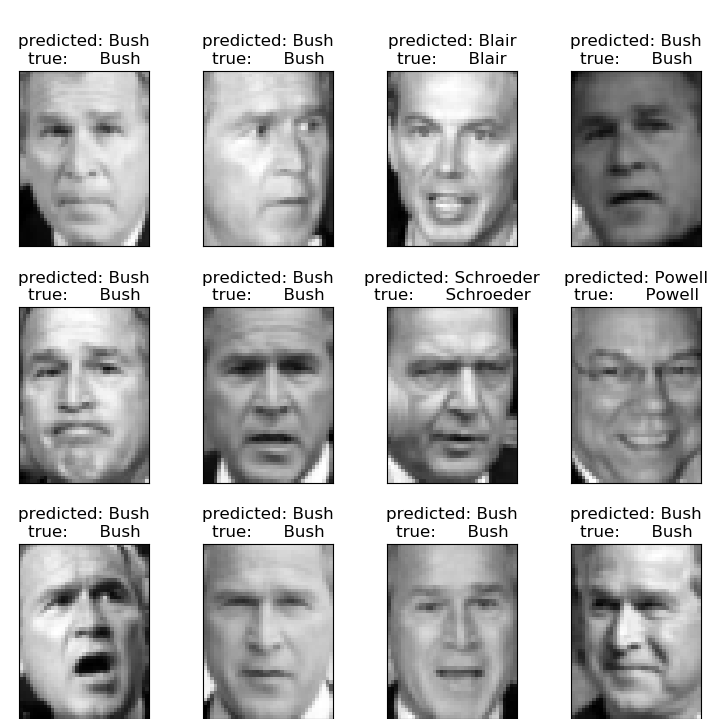

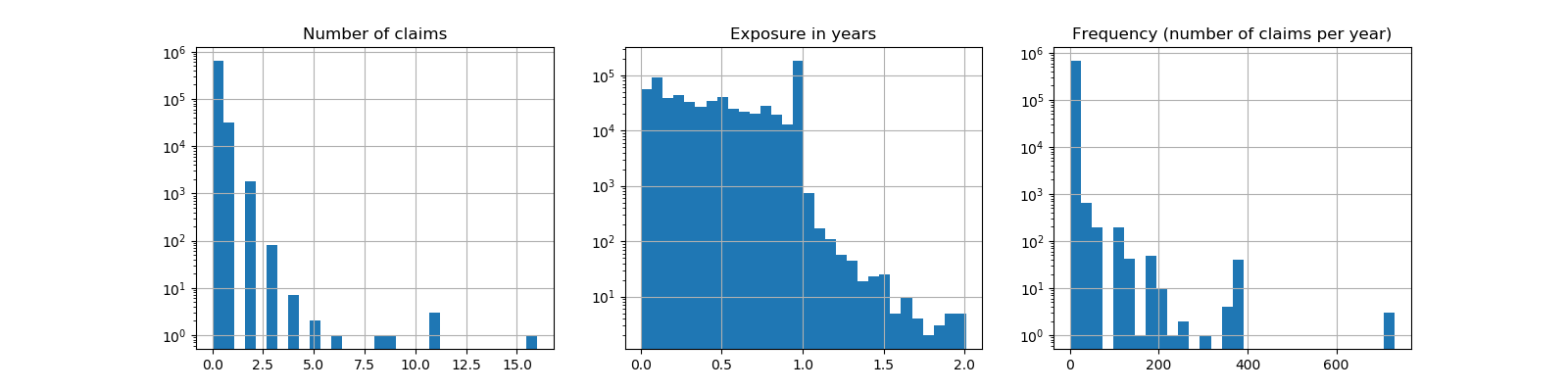

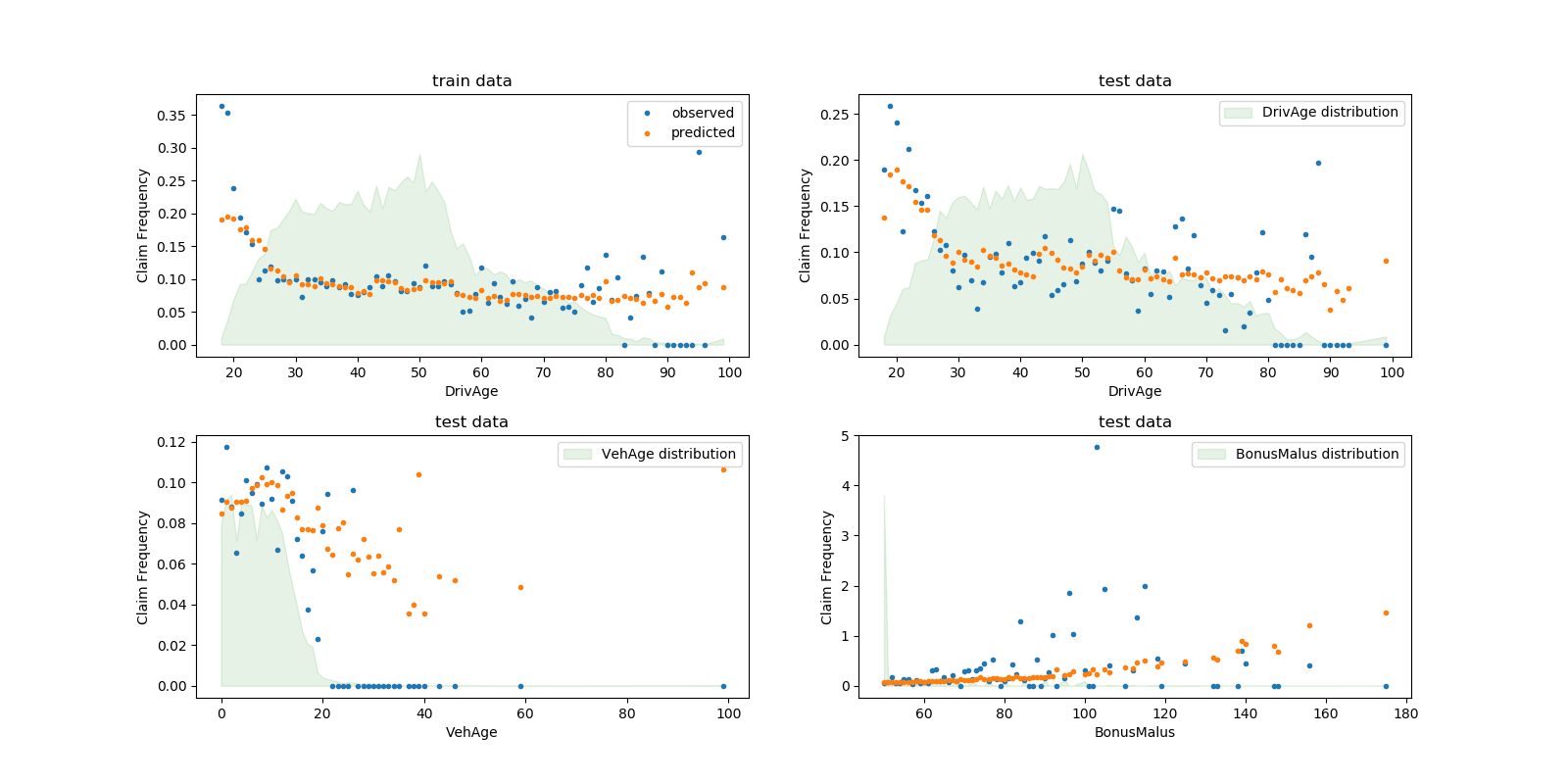

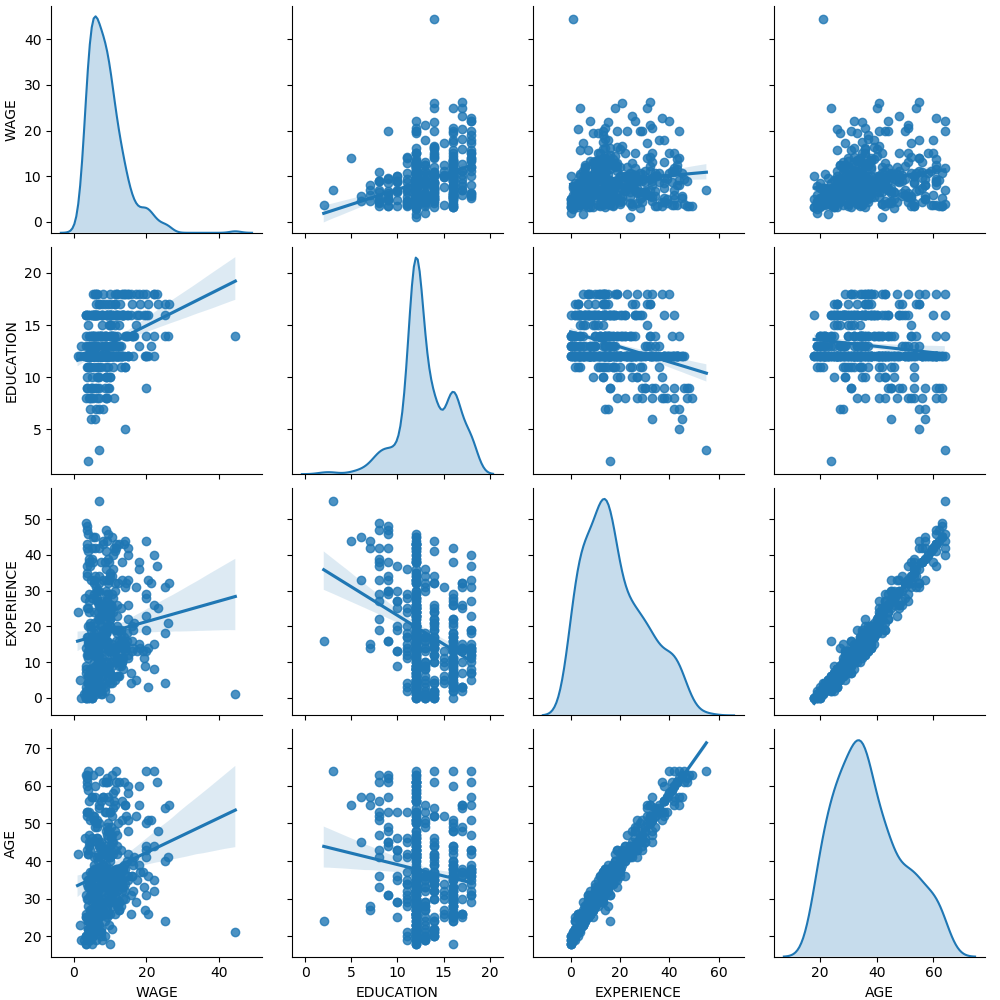

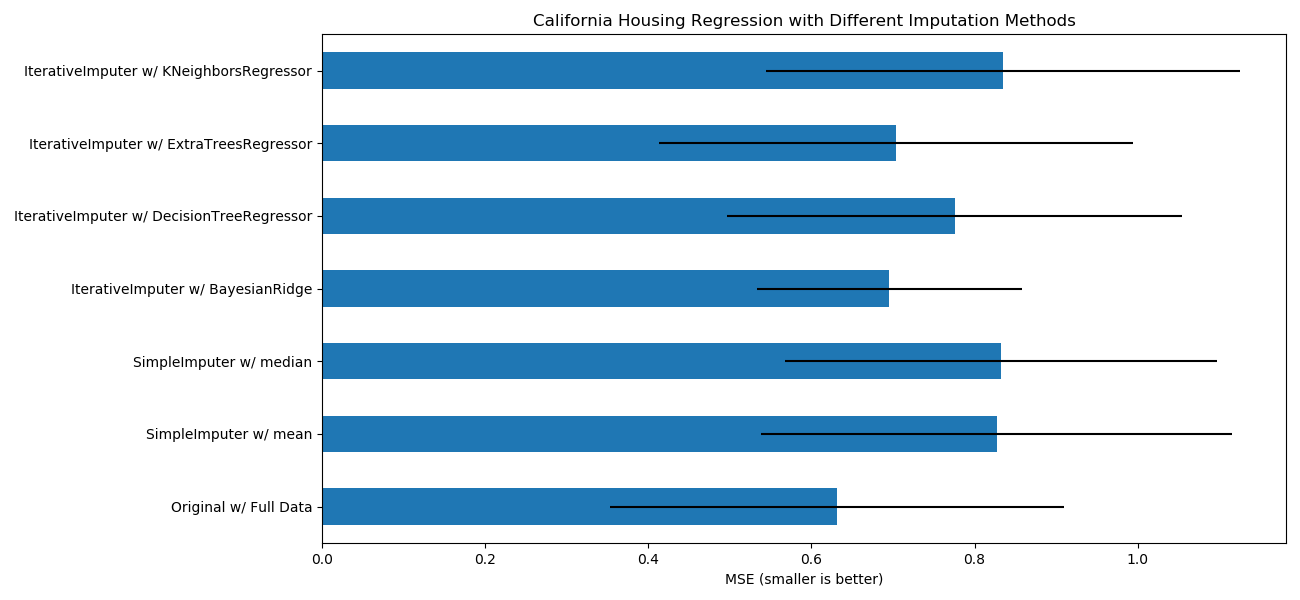

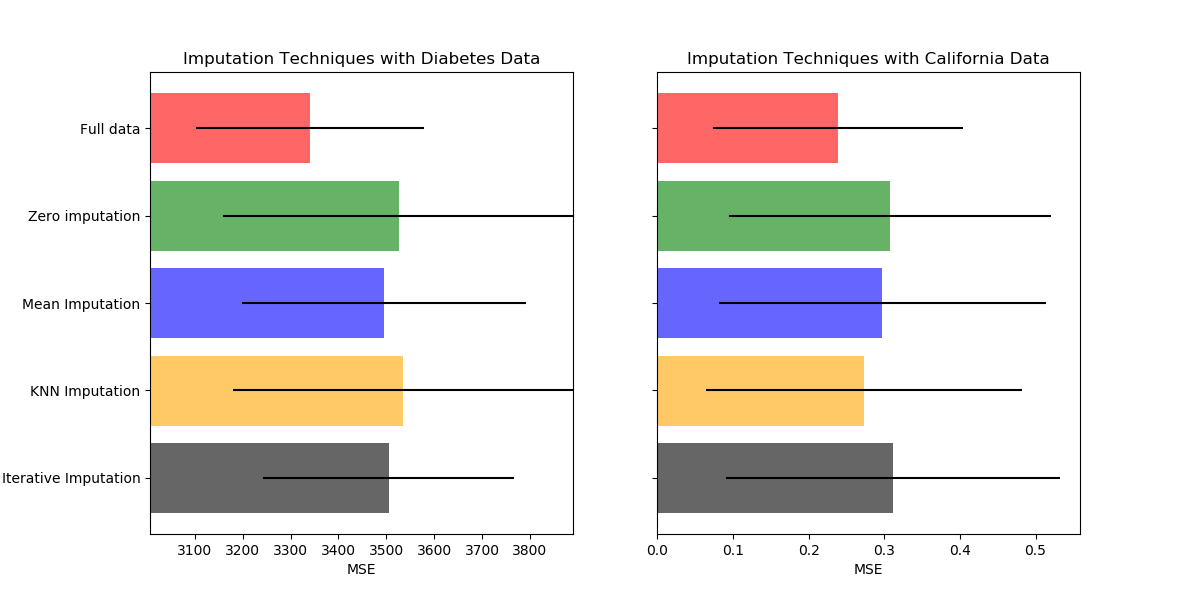

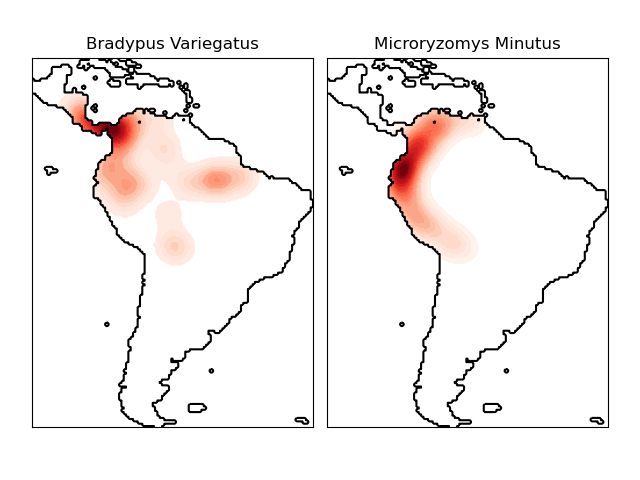

基于真实世界数据集的实例 ¶

具有一些中等大小的数据集或交互式用户界面的现实问题的应用程序。

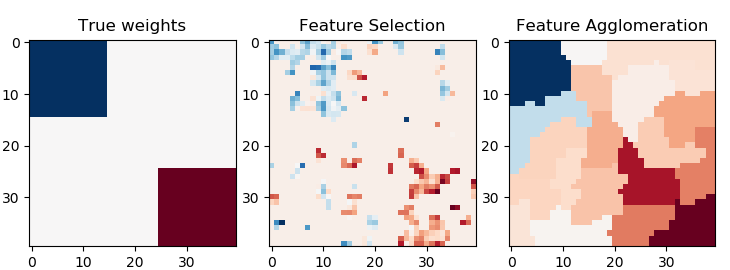

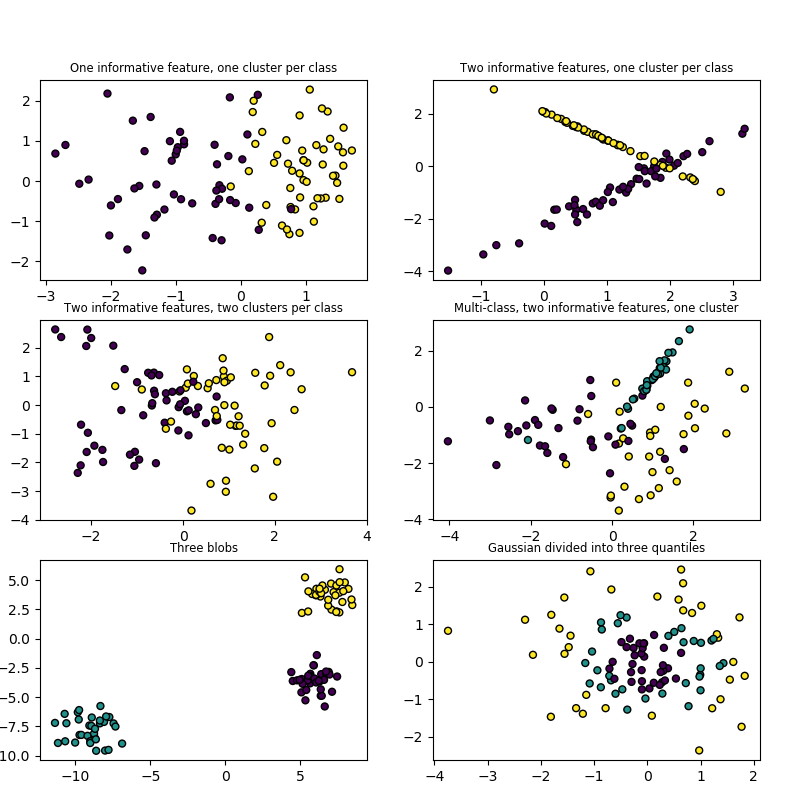

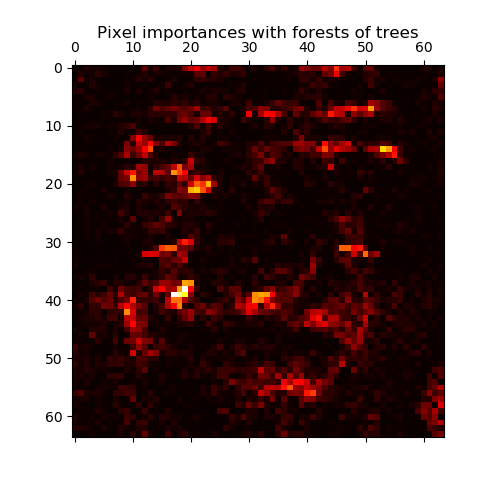

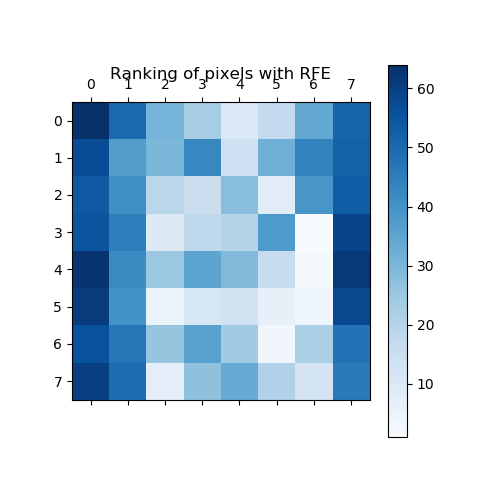

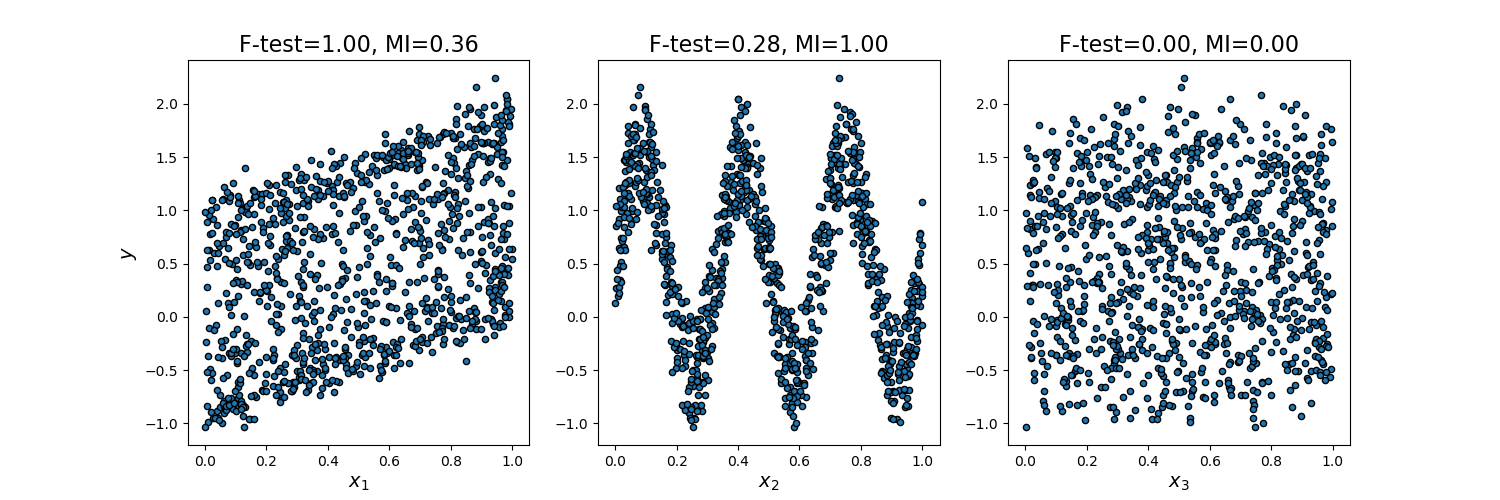

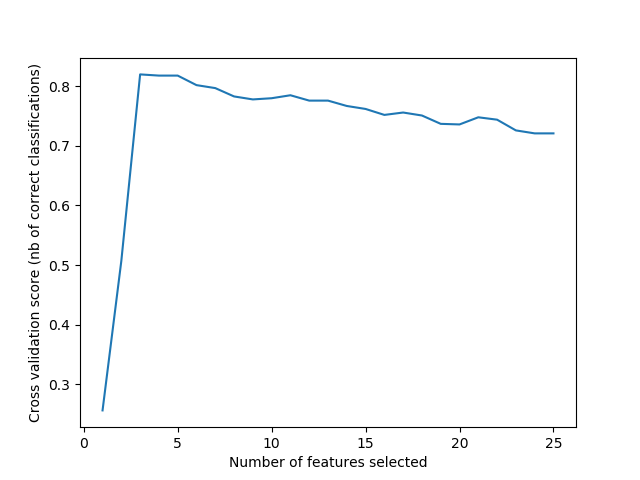

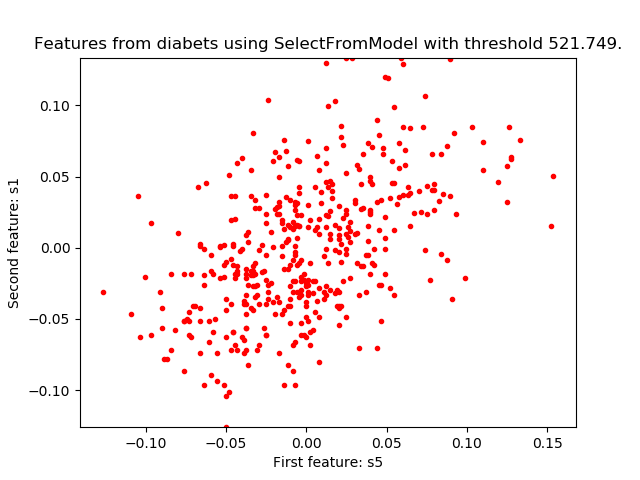

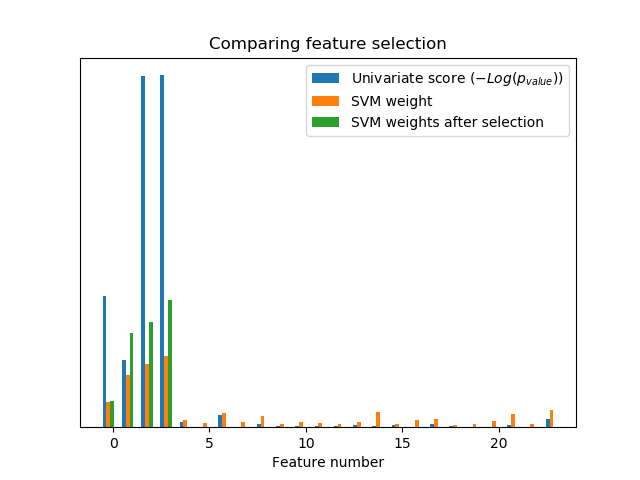

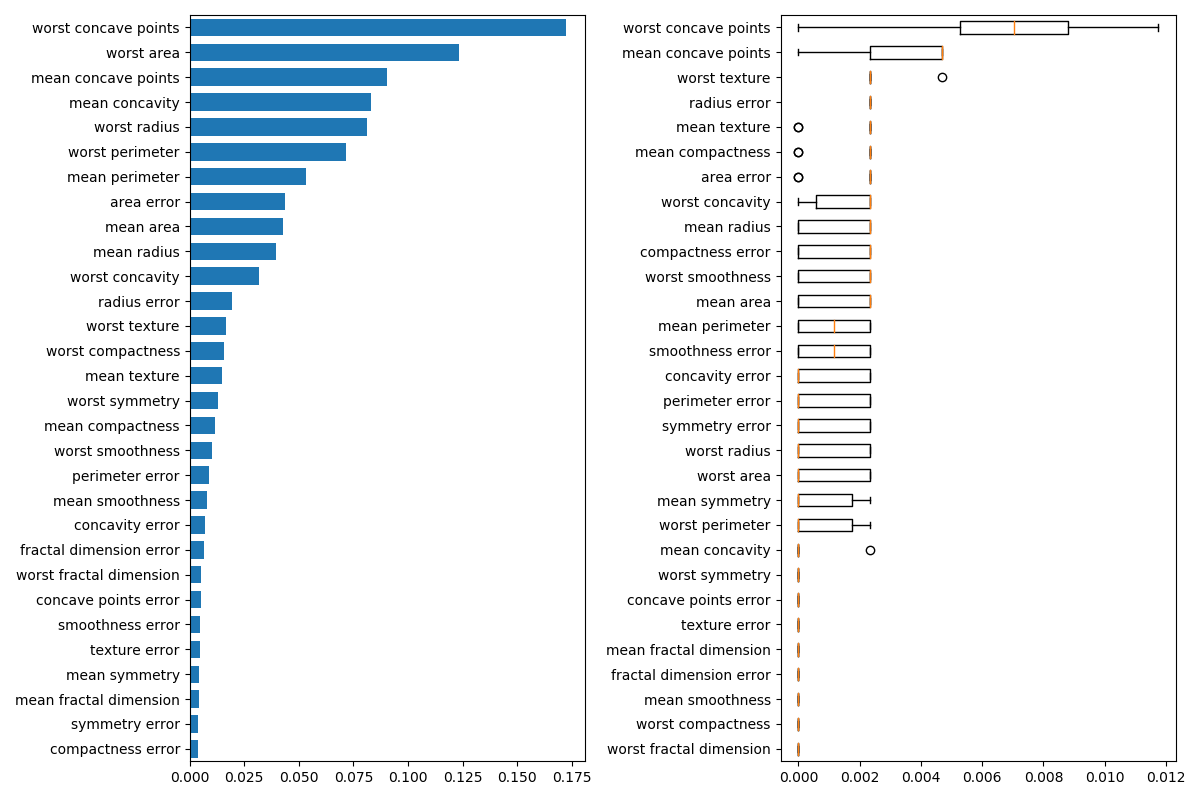

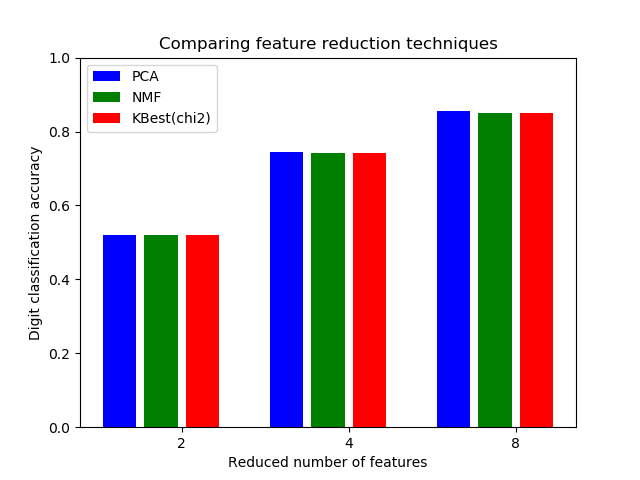

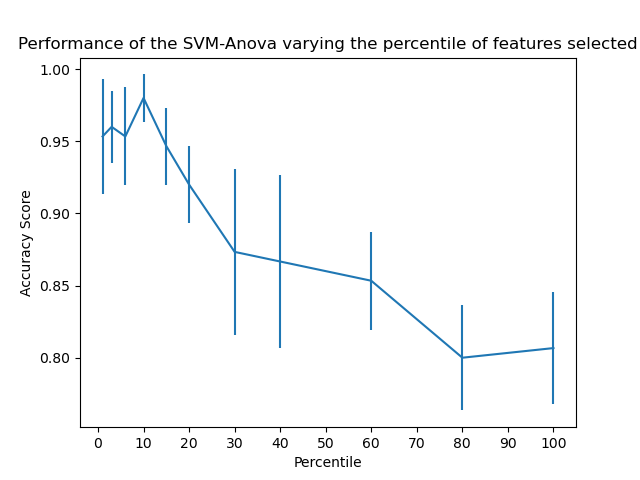

特征选择 ¶

有关sklearn.feature_selection模块的示例。

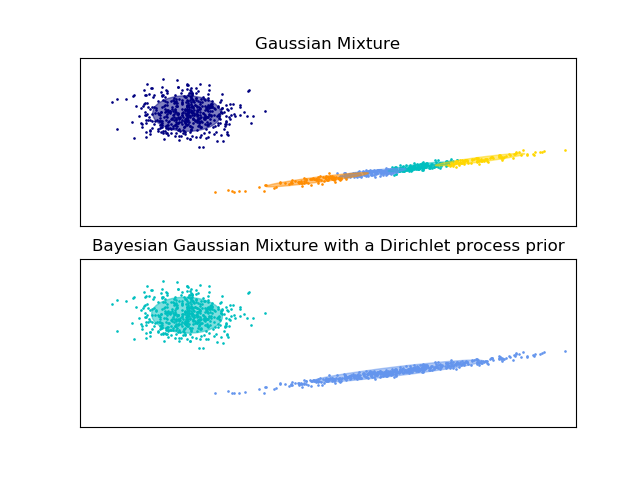

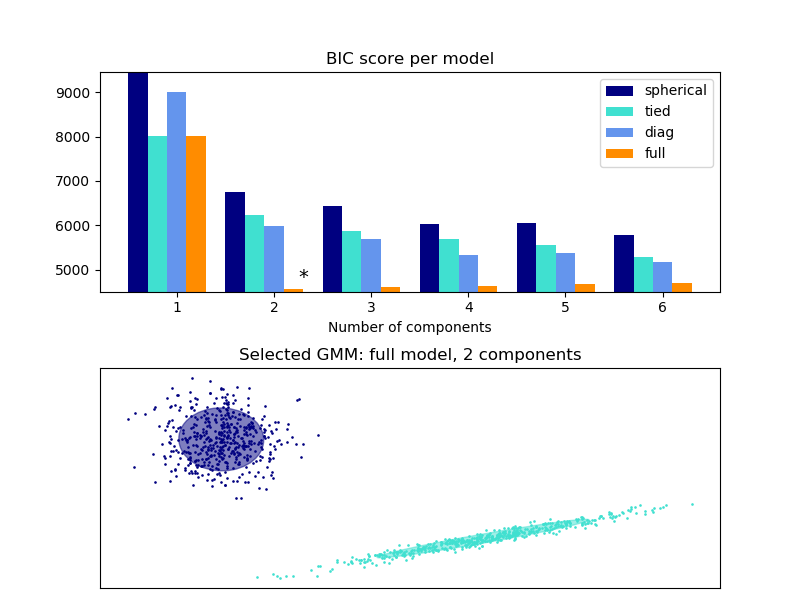

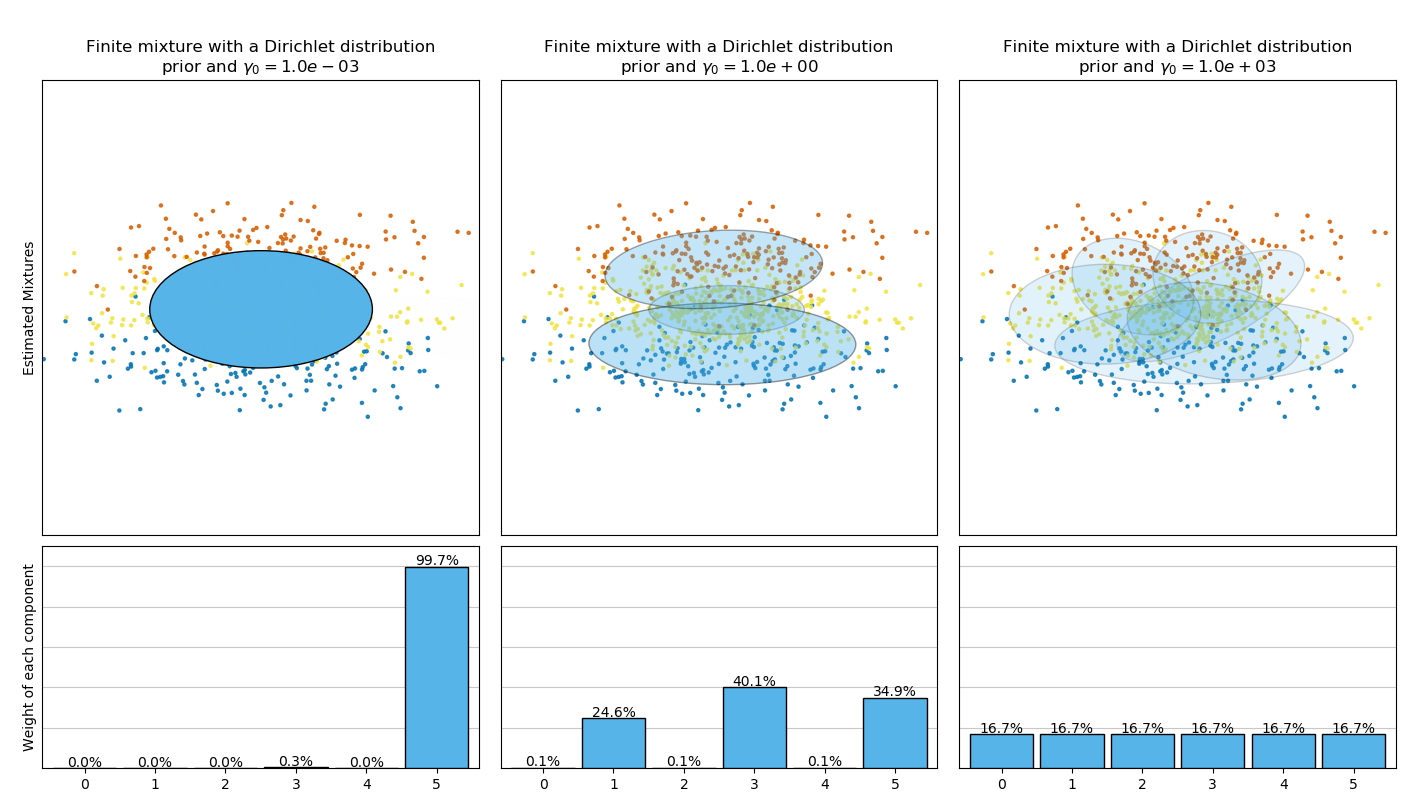

高斯混合模型 ¶

有关sklearn.mixture模块的示例。

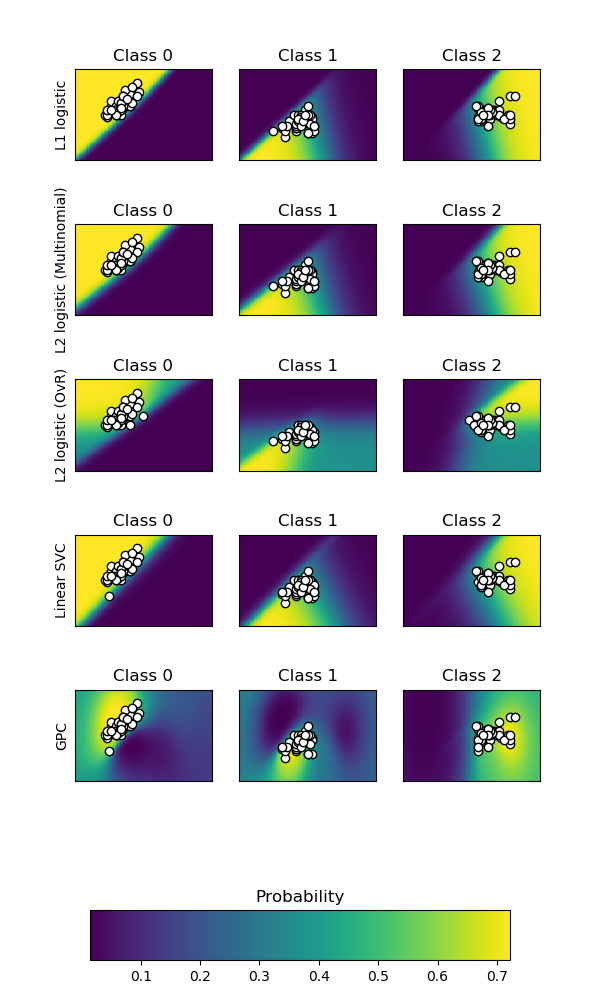

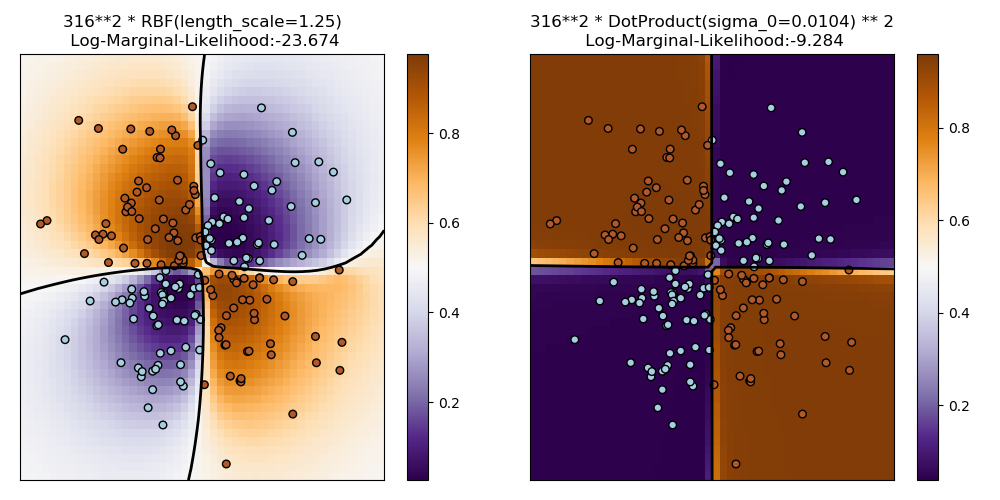

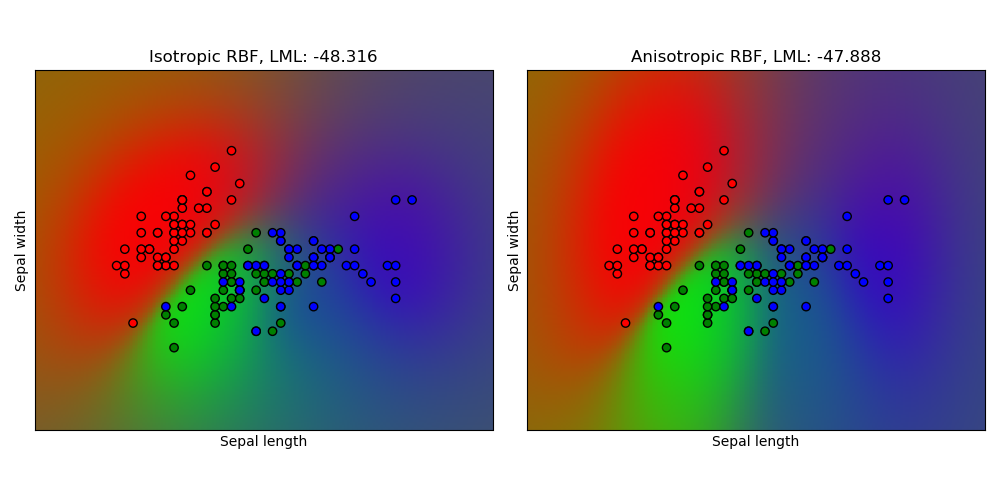

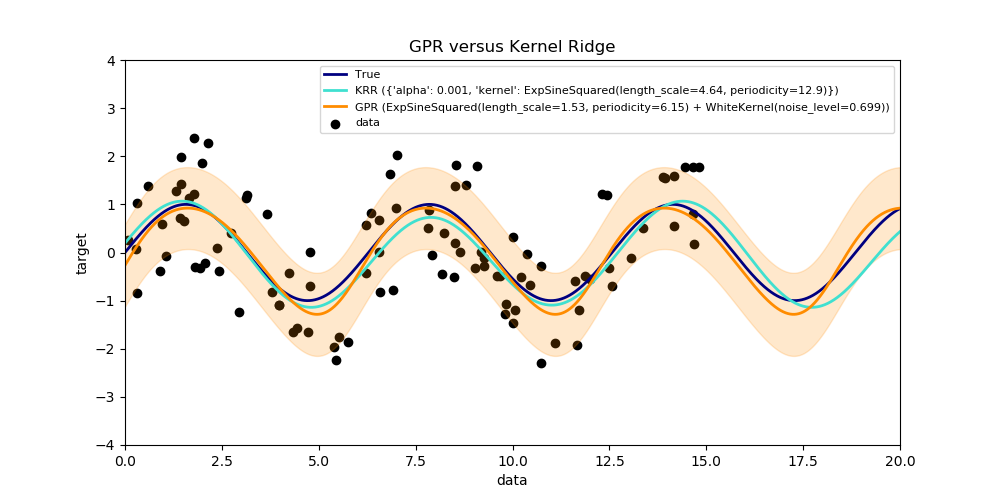

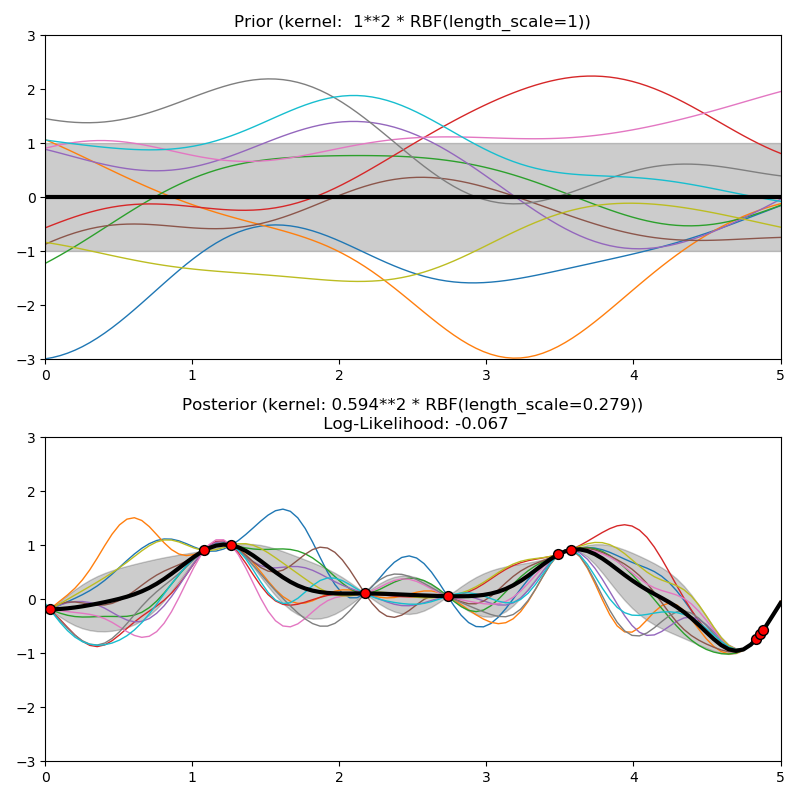

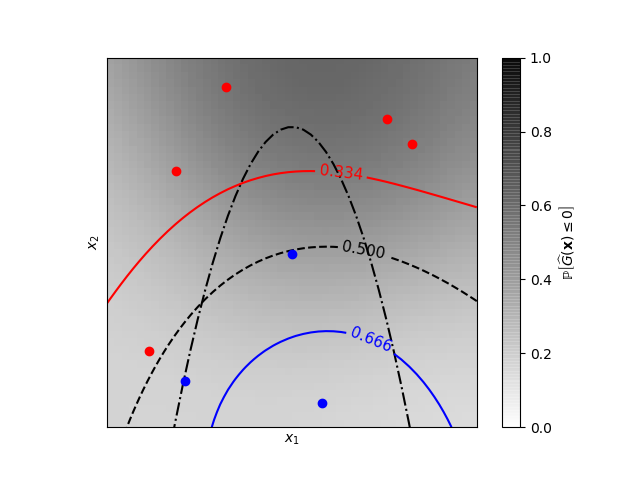

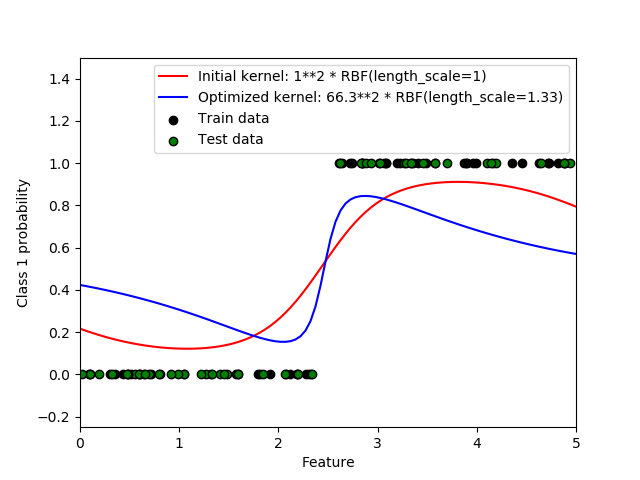

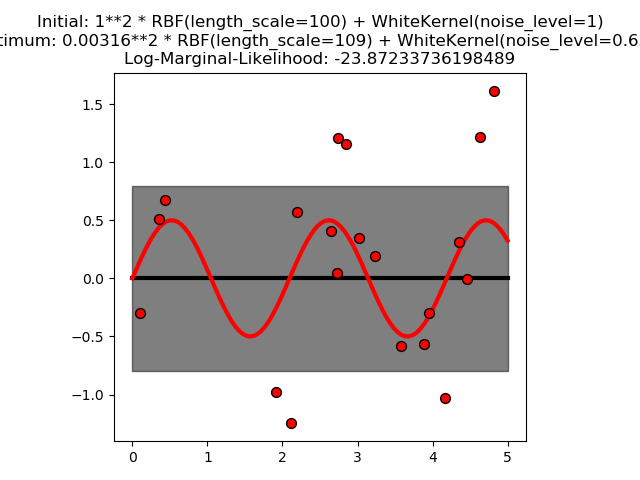

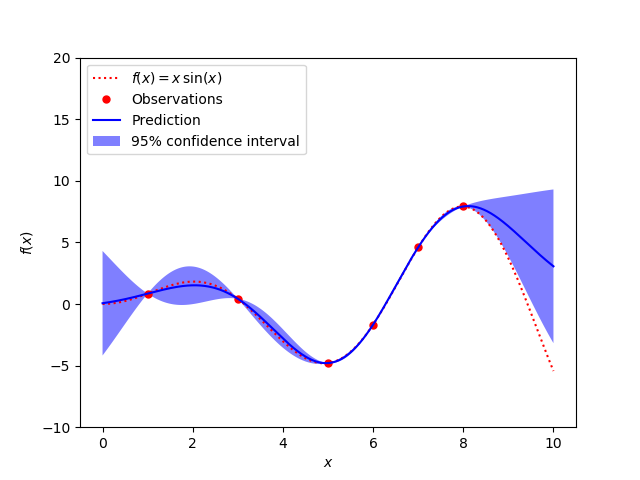

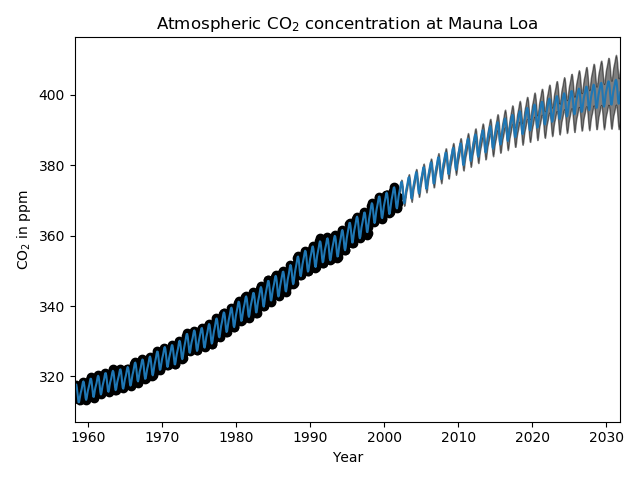

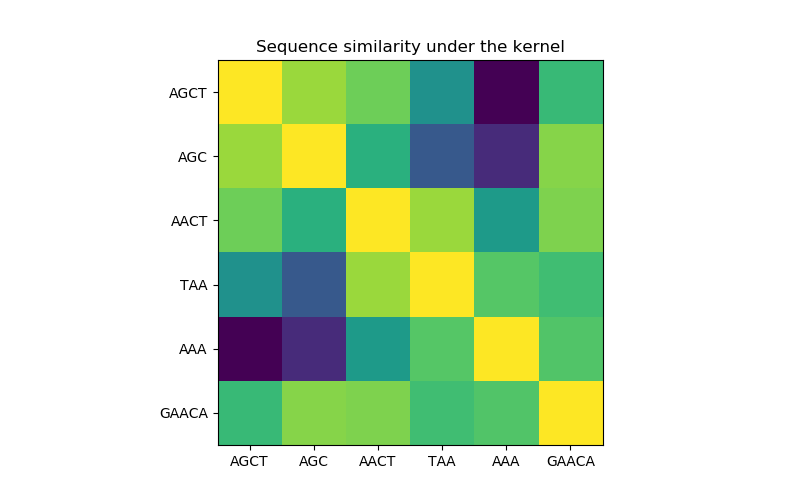

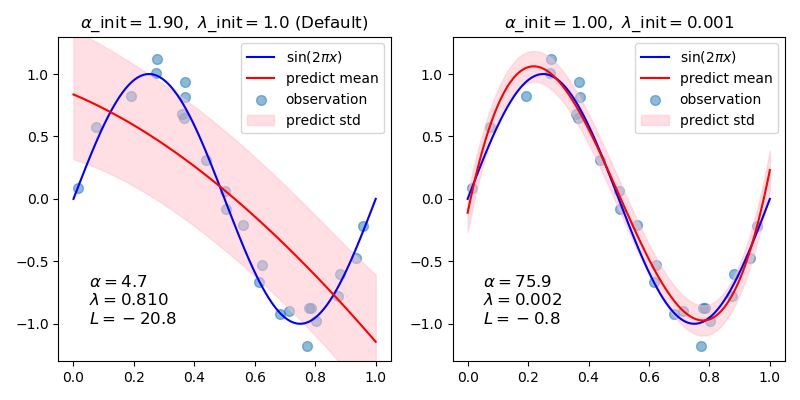

机器学习的高斯过程 ¶

有关sklearn.gaussian_process模块的示例。

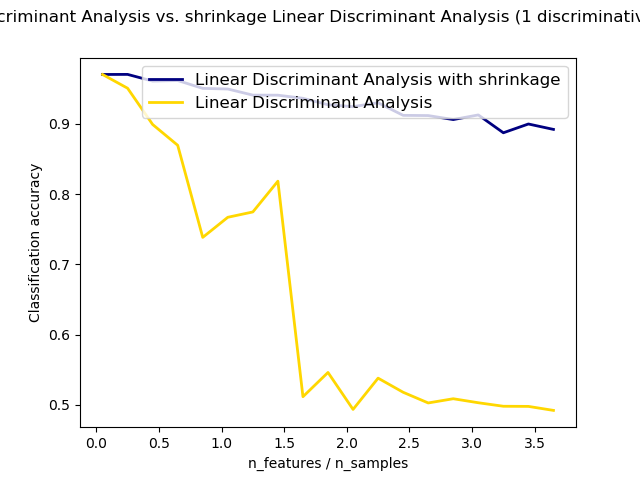

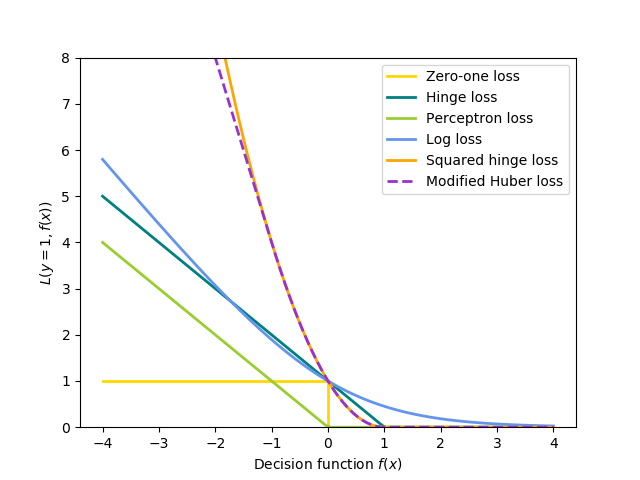

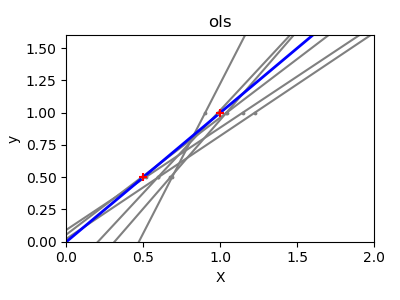

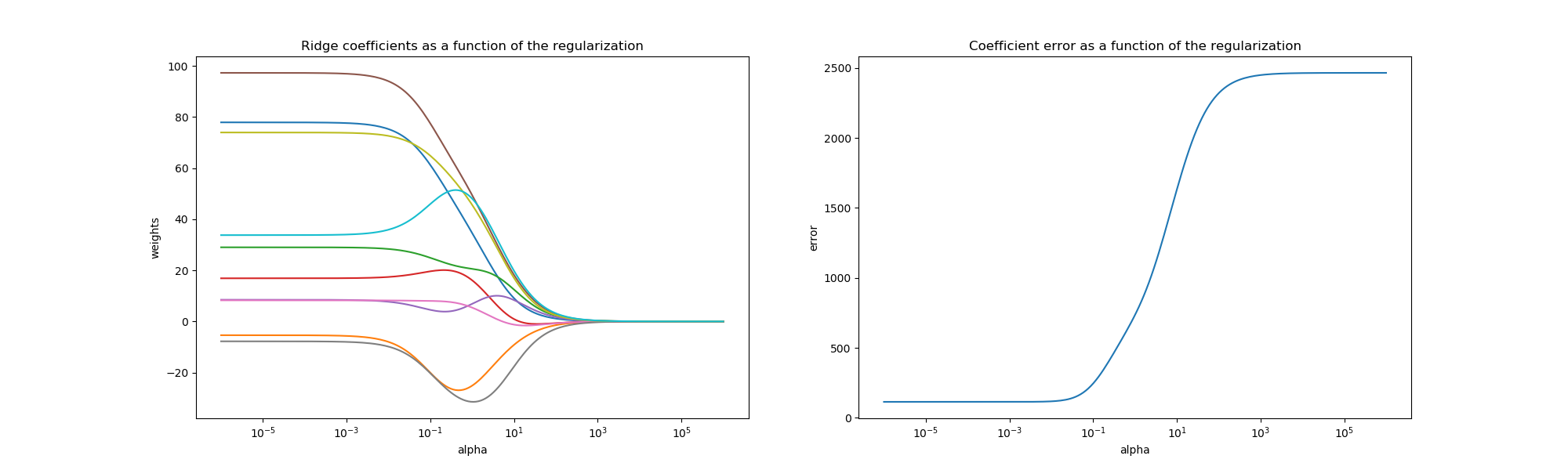

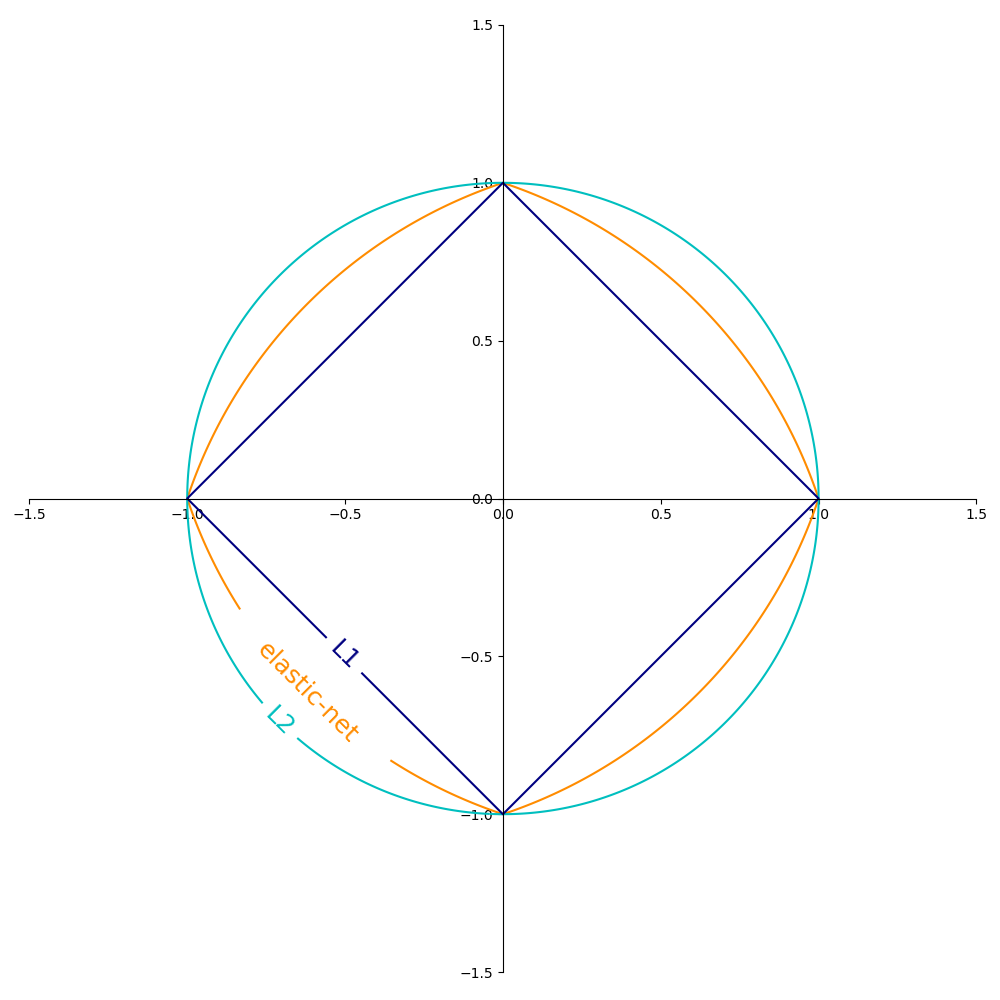

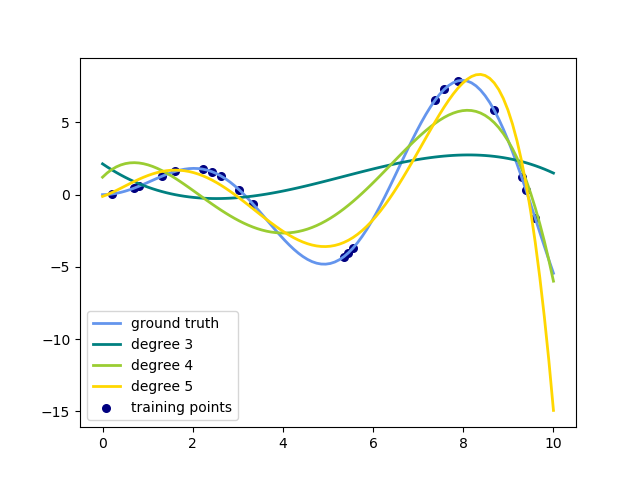

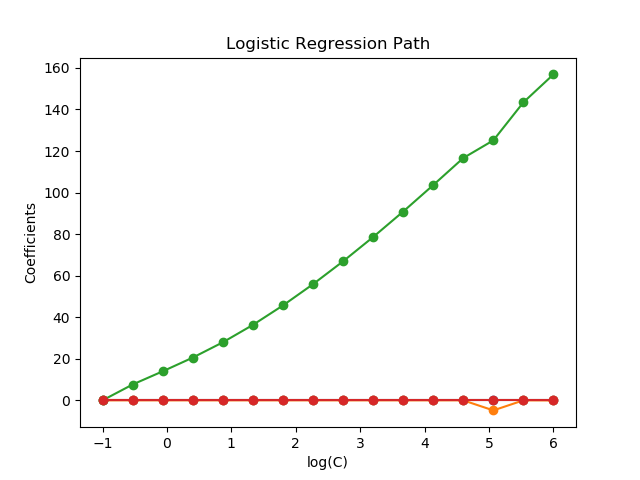

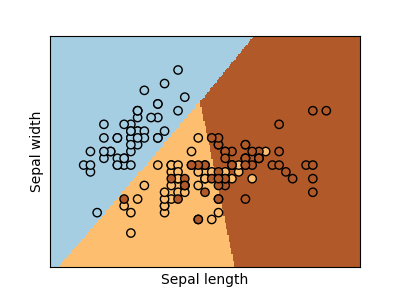

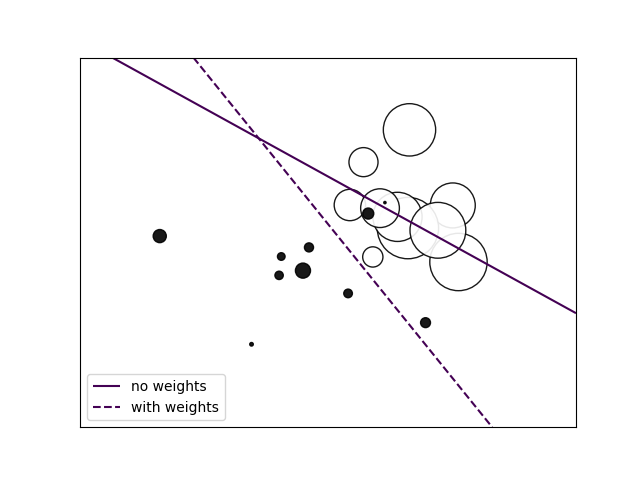

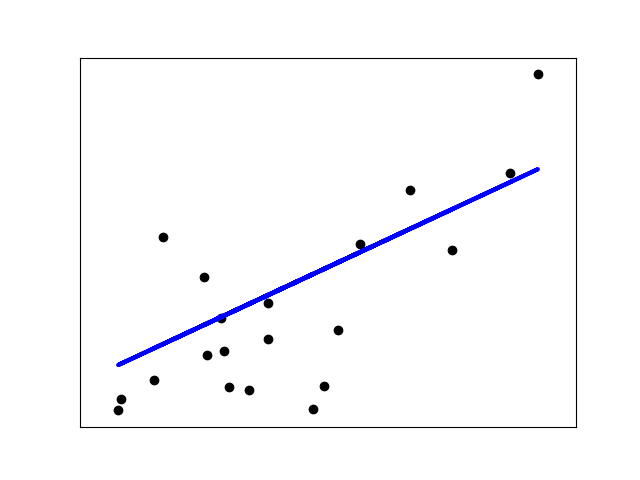

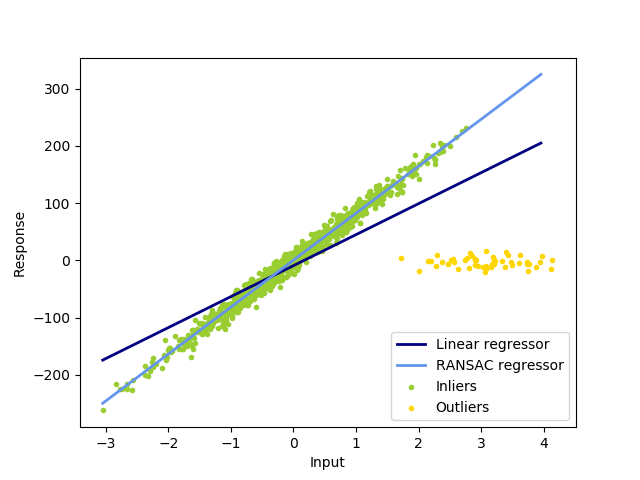

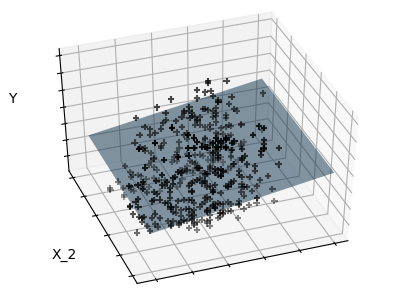

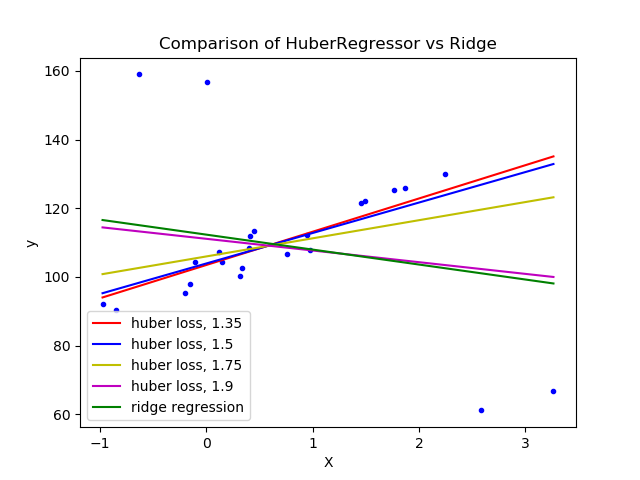

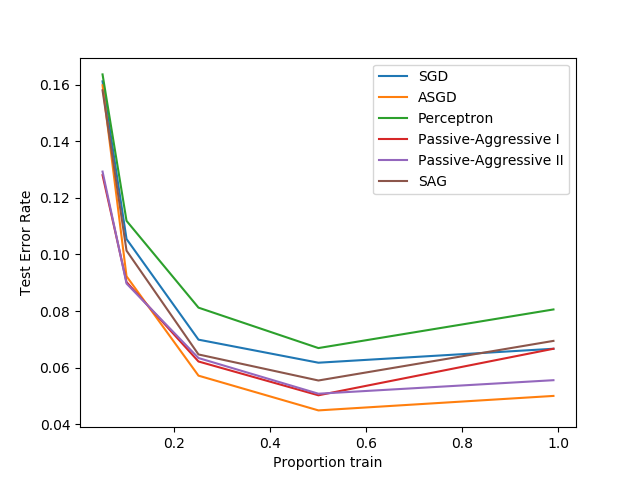

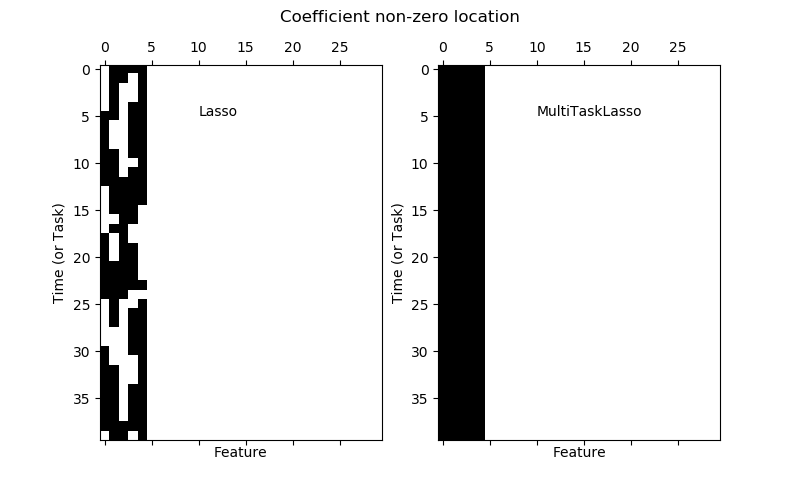

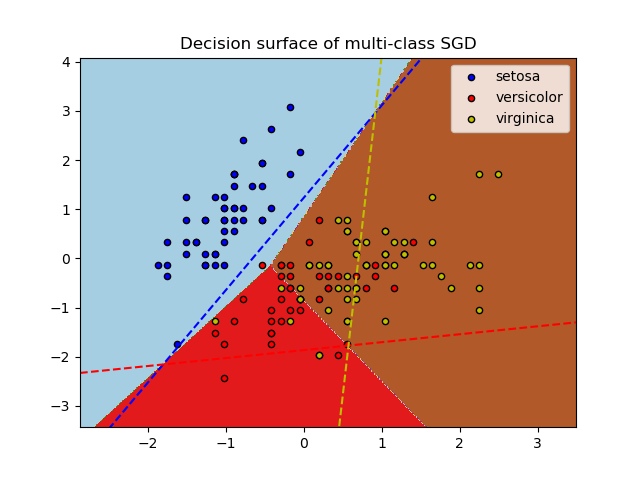

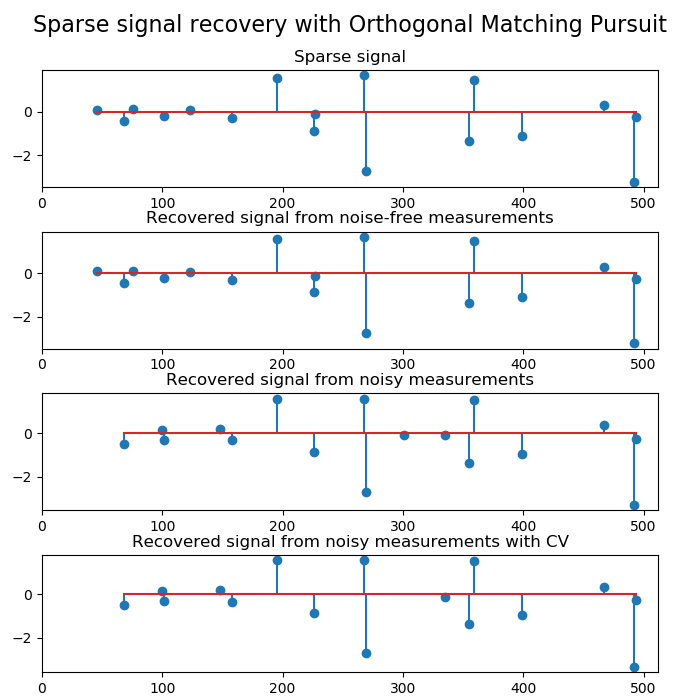

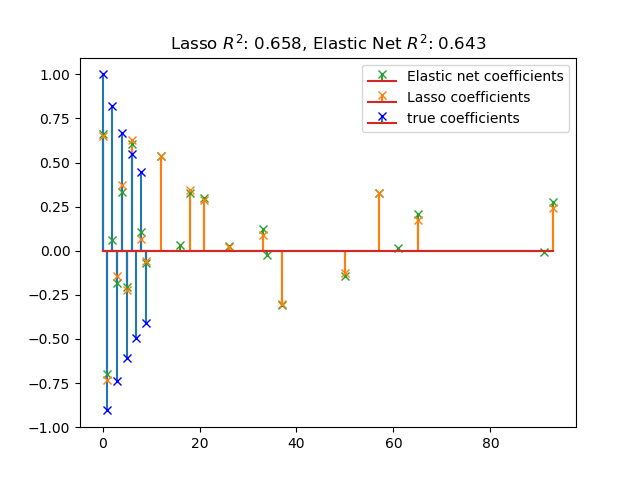

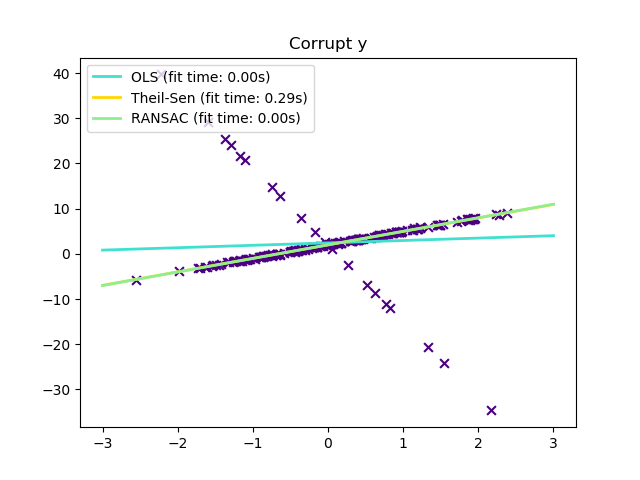

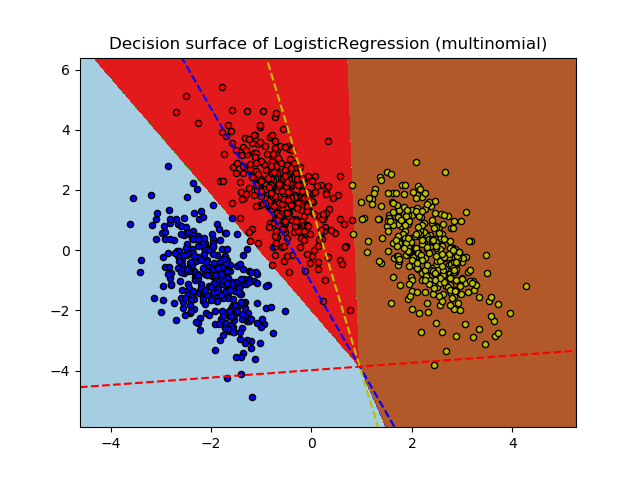

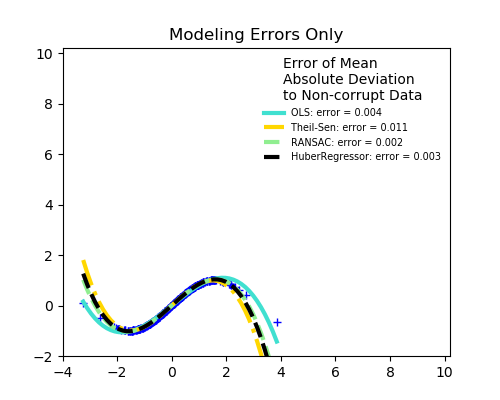

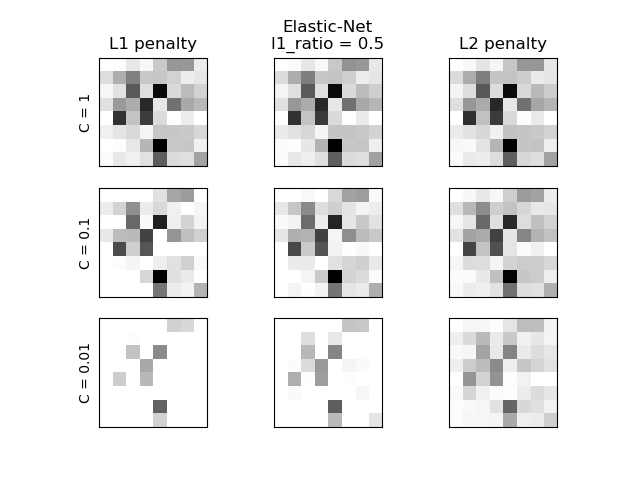

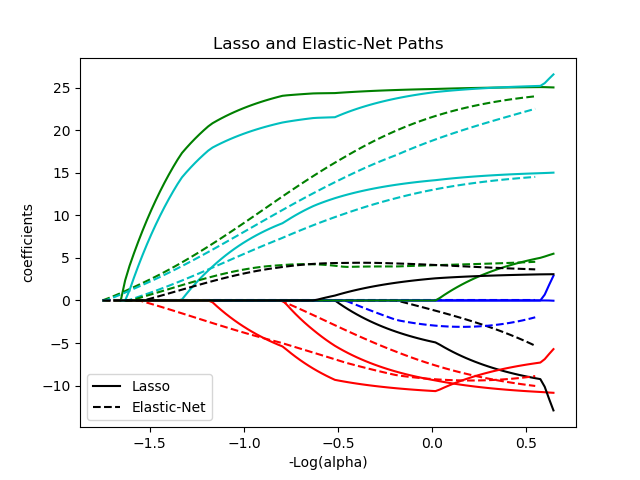

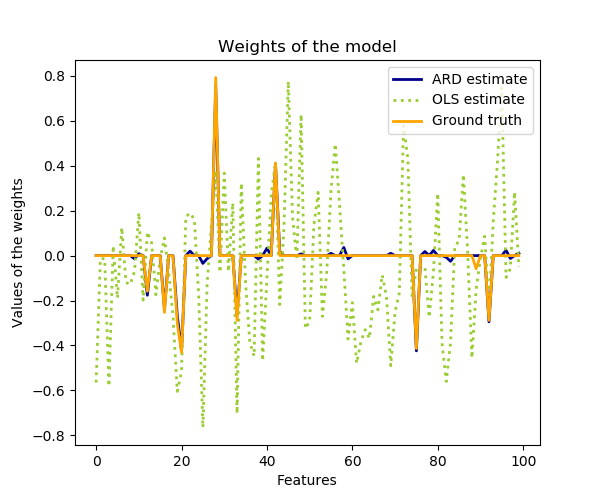

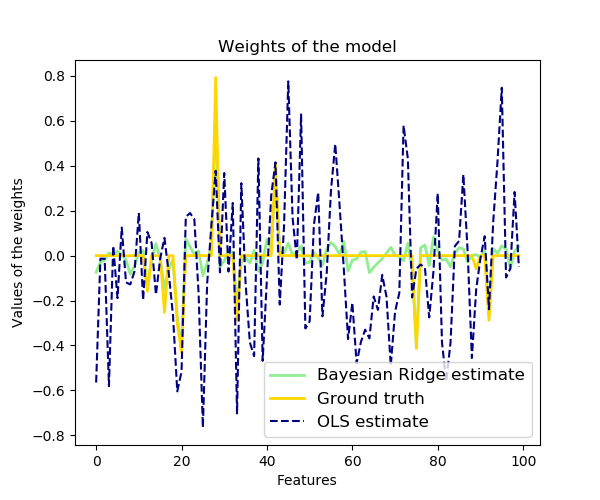

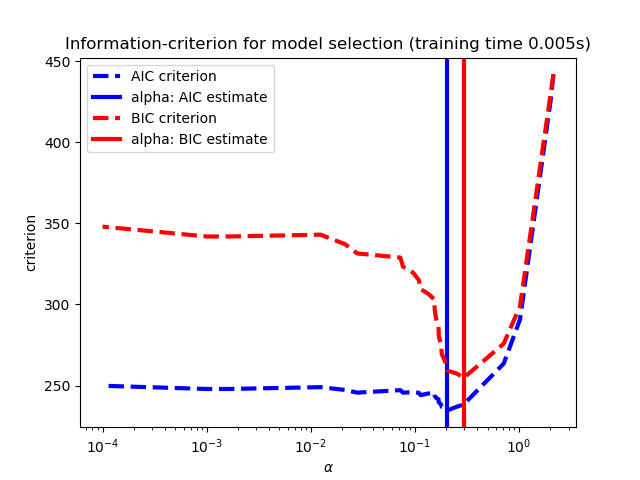

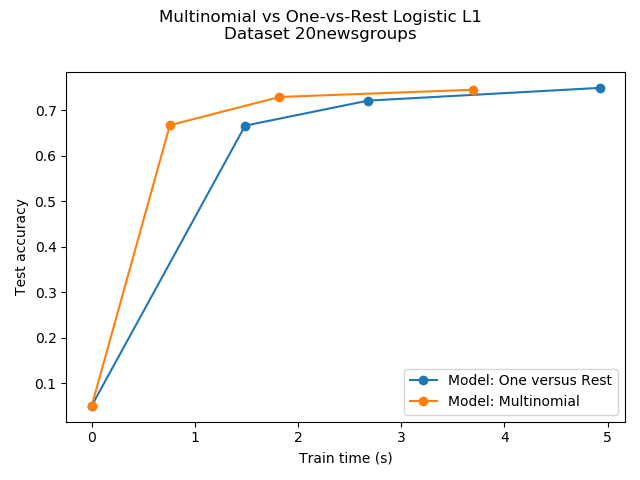

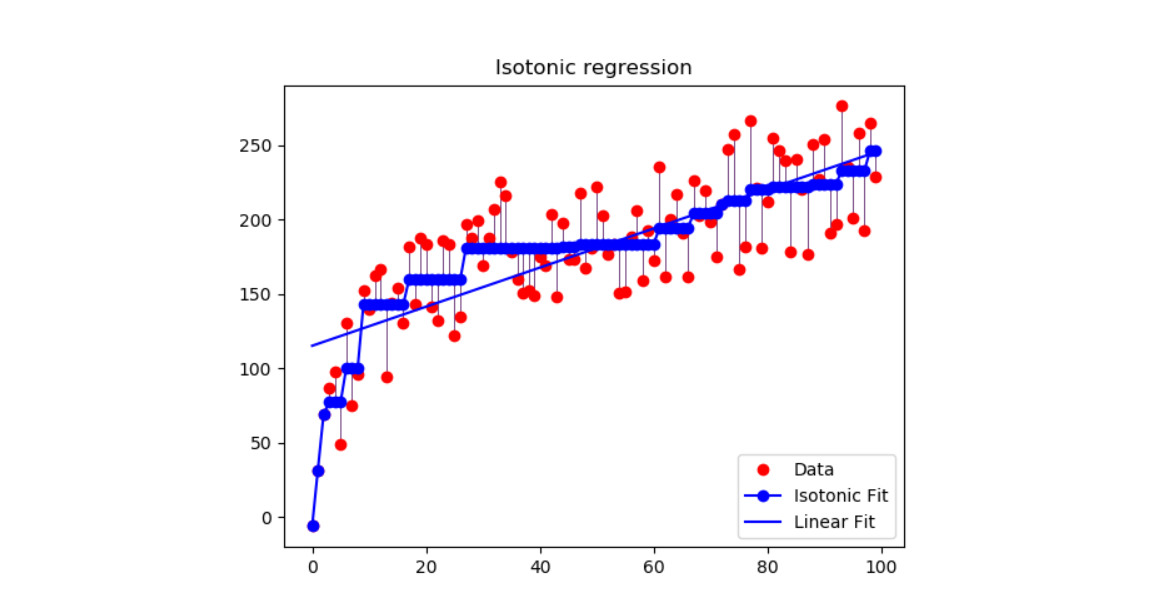

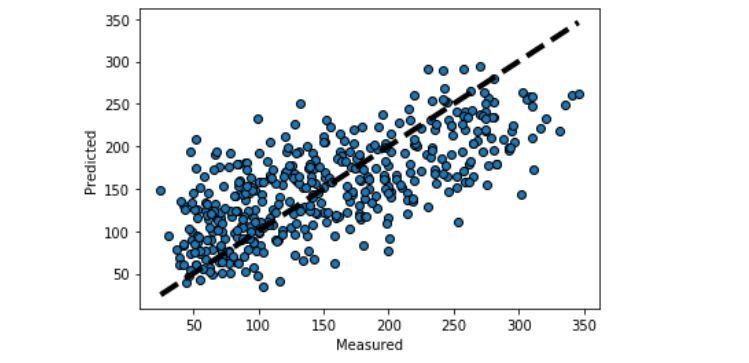

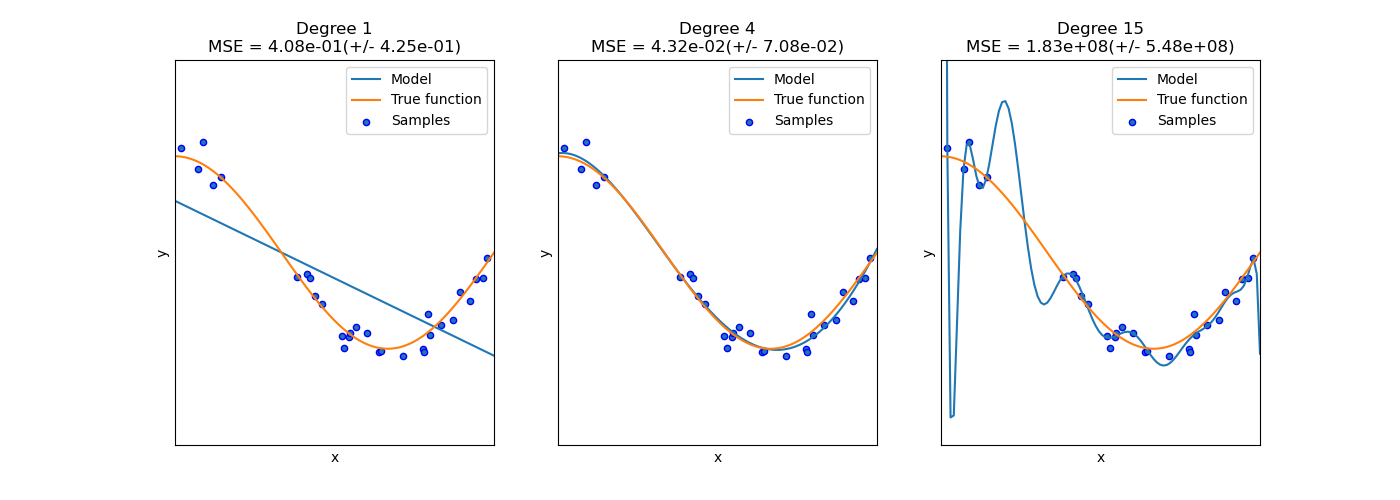

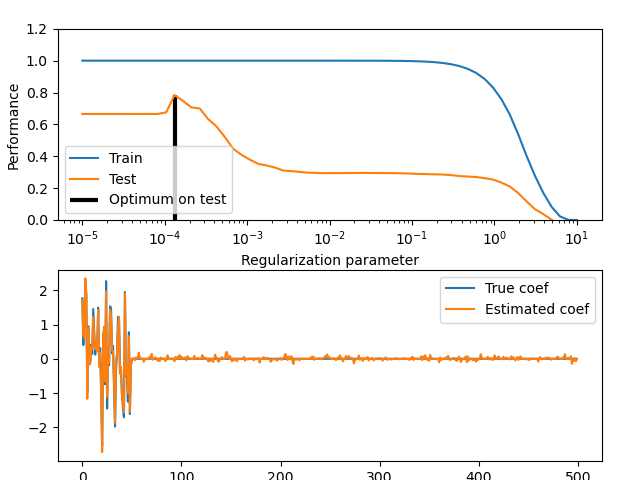

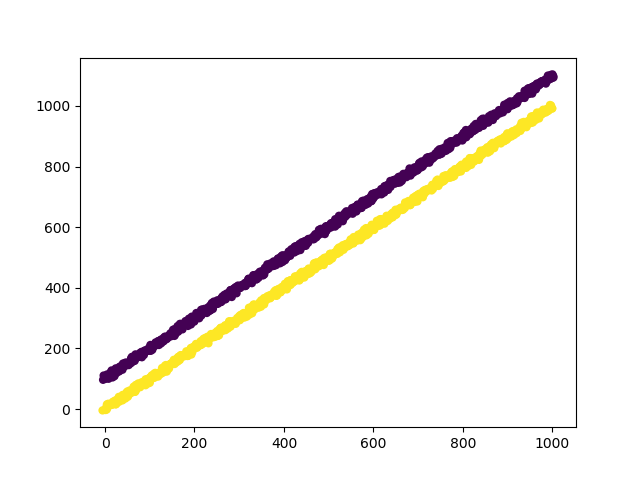

广义线性模型 ¶

有关sklearn.linear_model模块的示例。

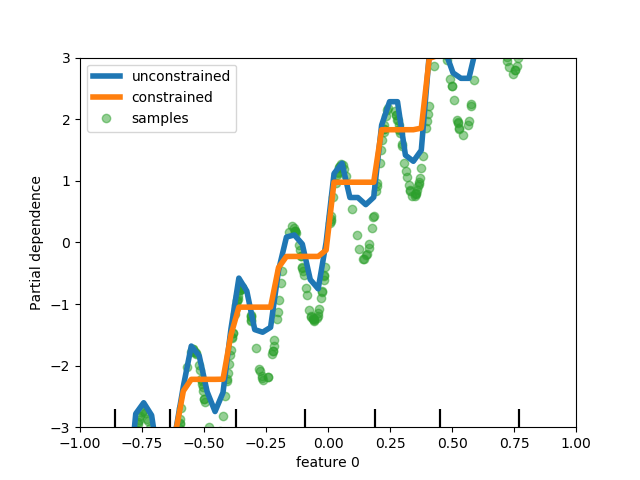

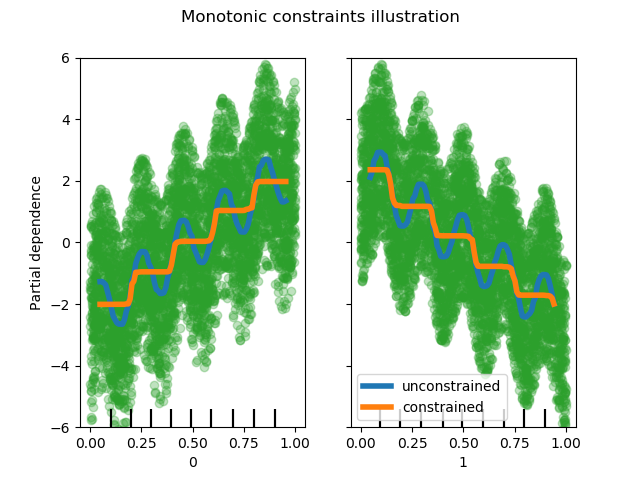

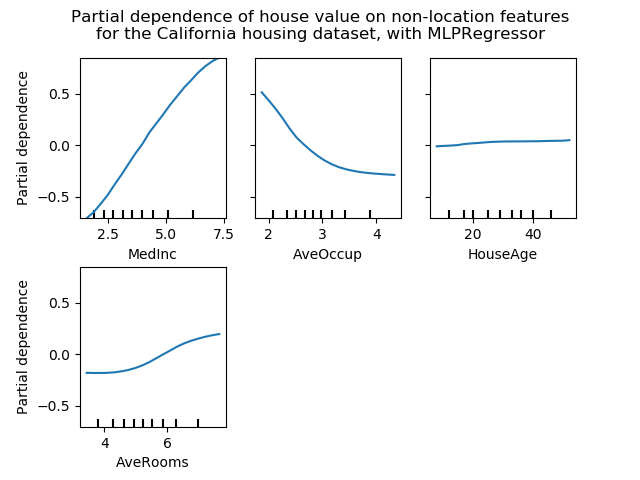

检查 ¶

与sklearn.inspection模块有关的示例。

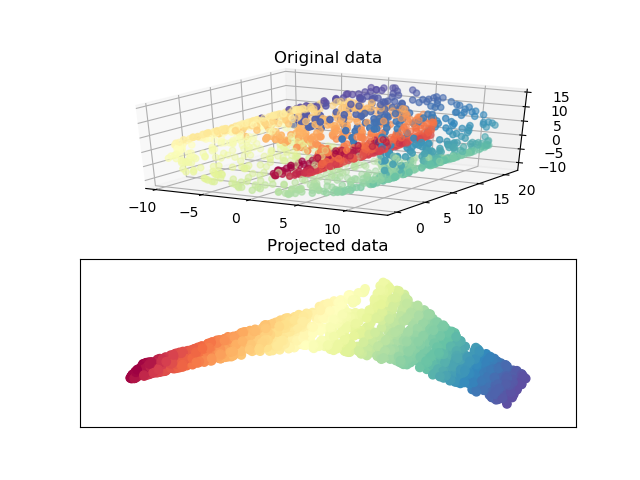

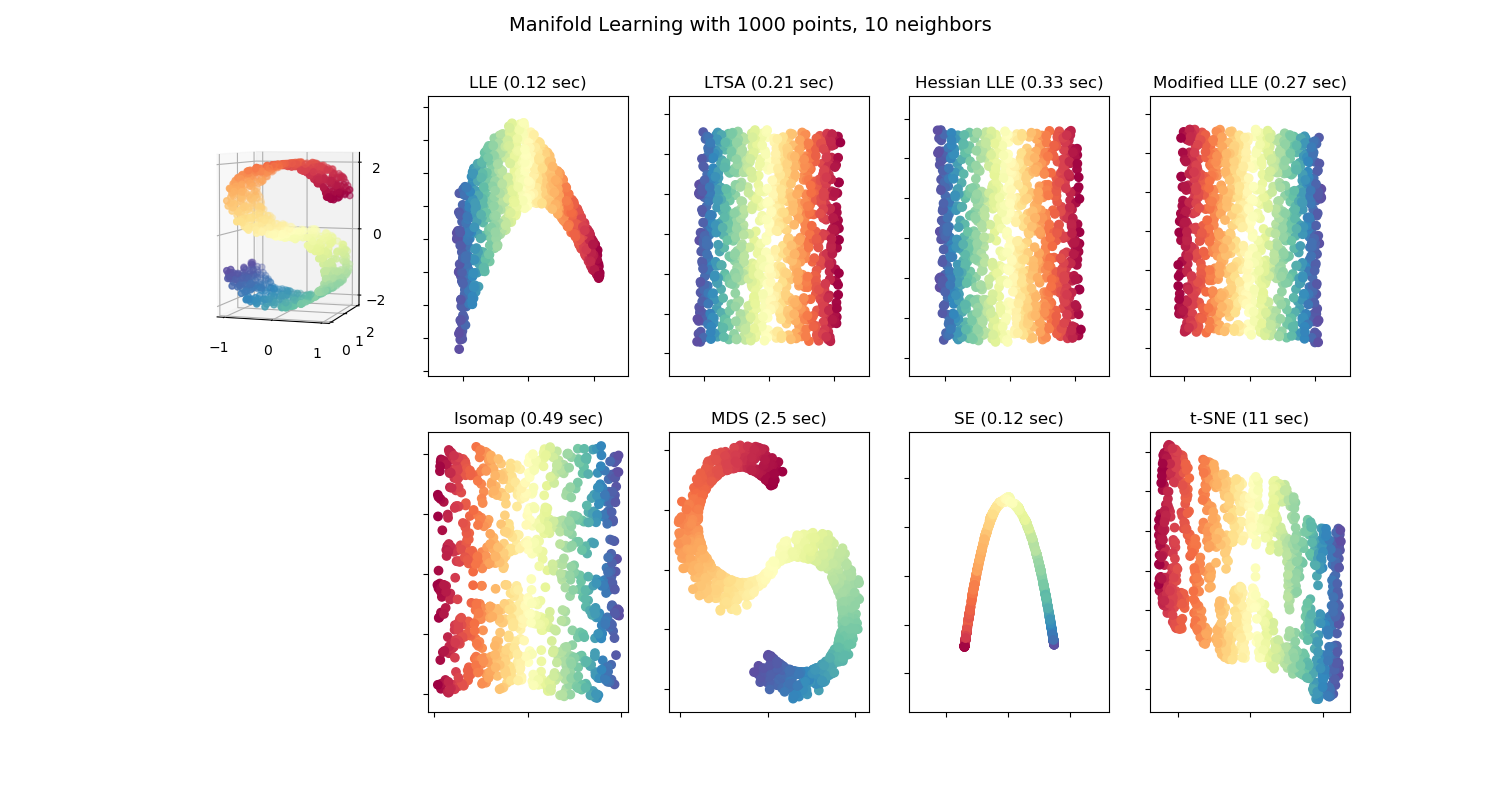

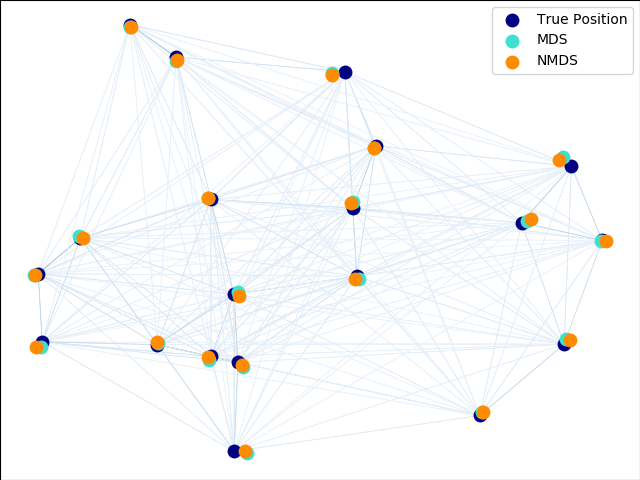

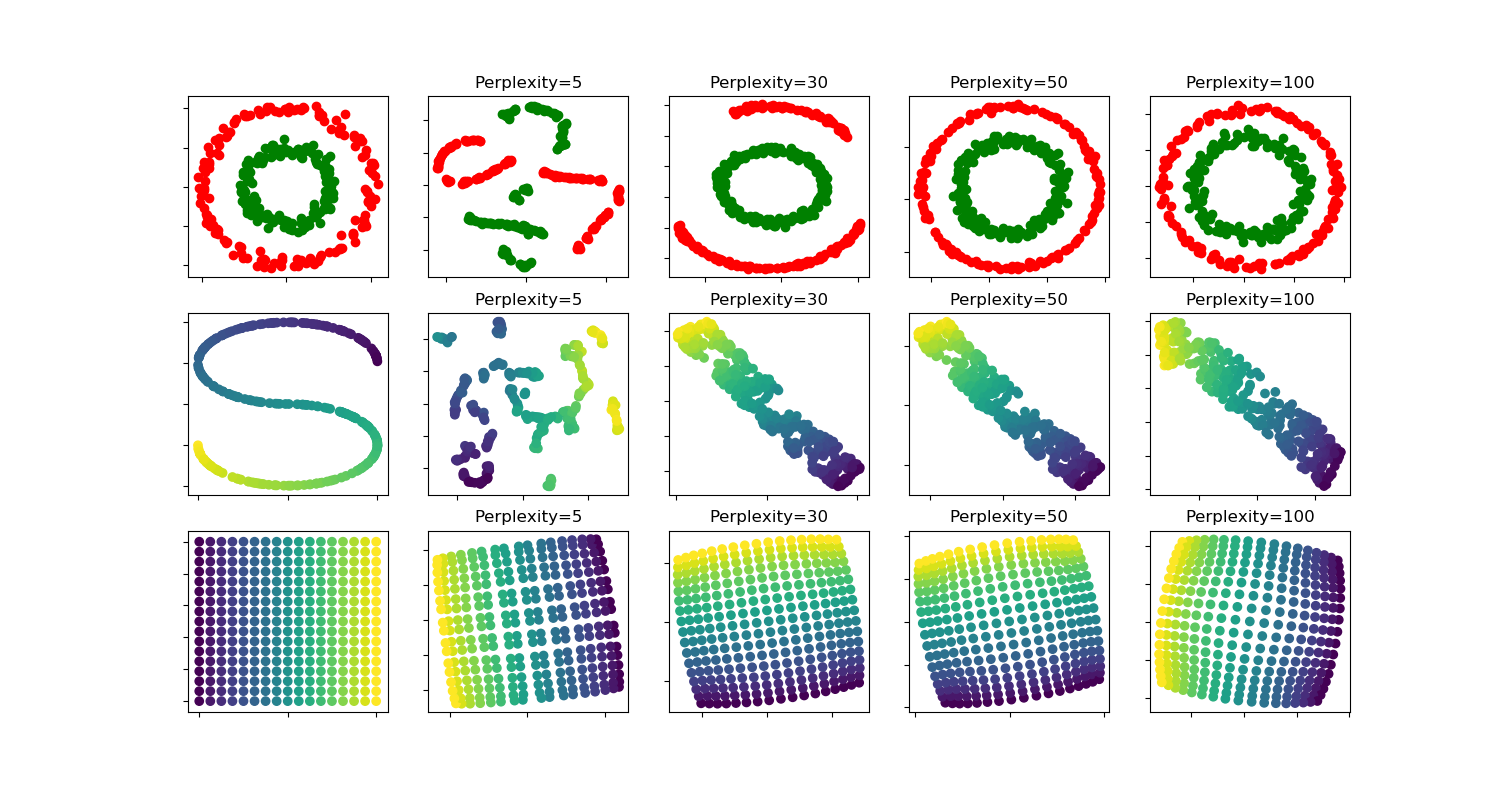

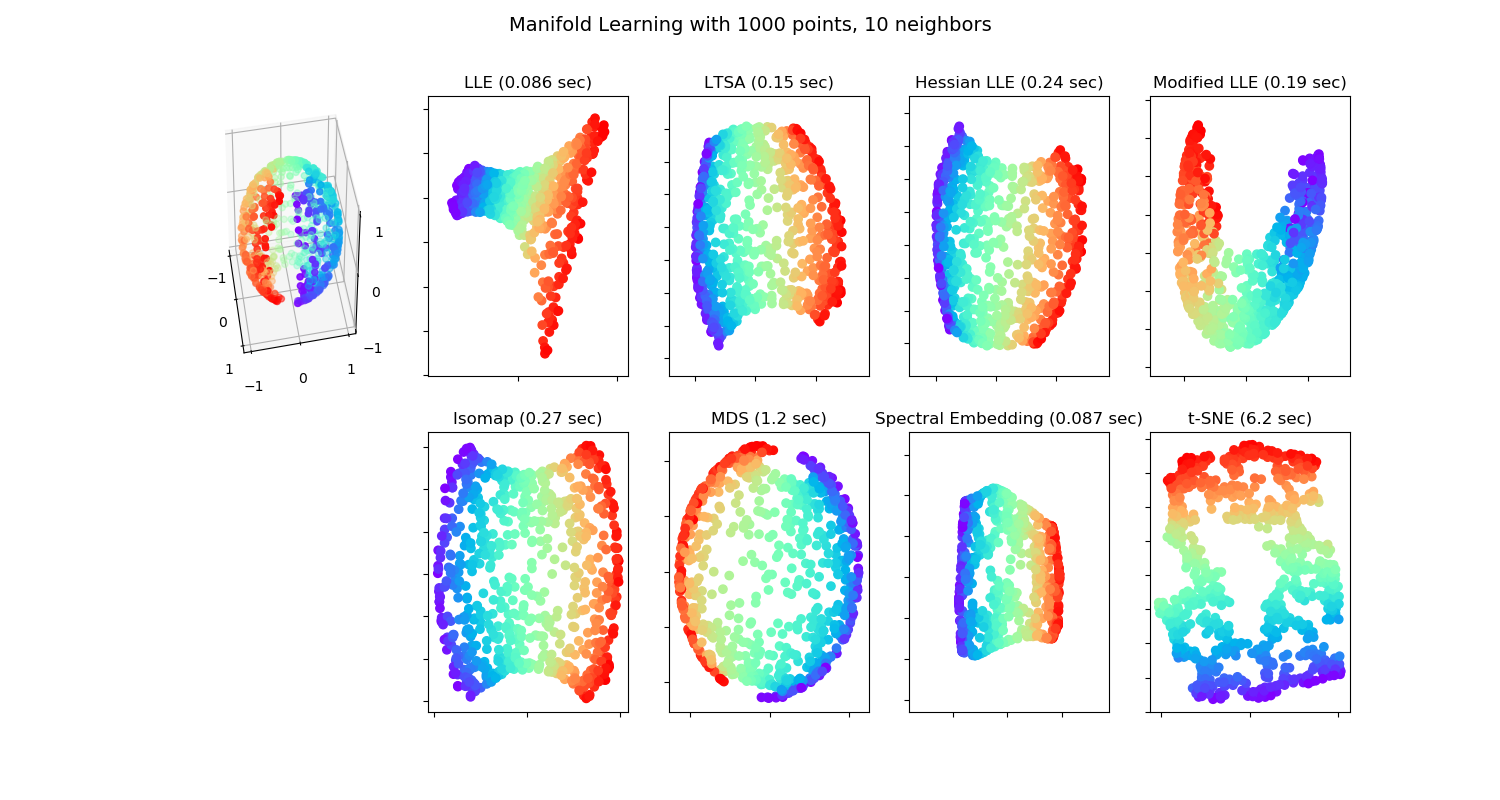

流形学习 ¶

有关sklearn.manifold模块的示例。

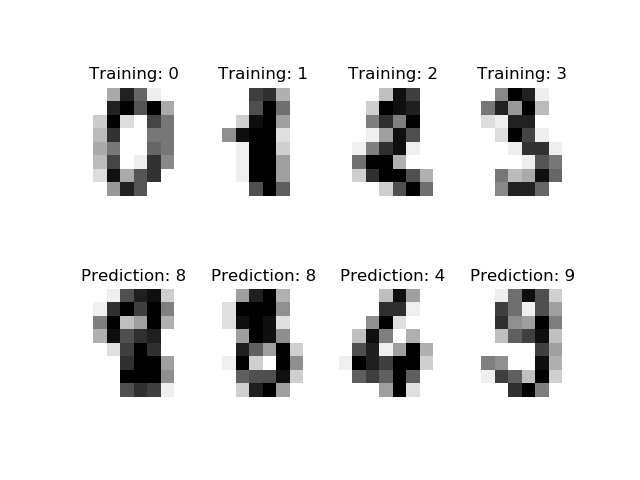

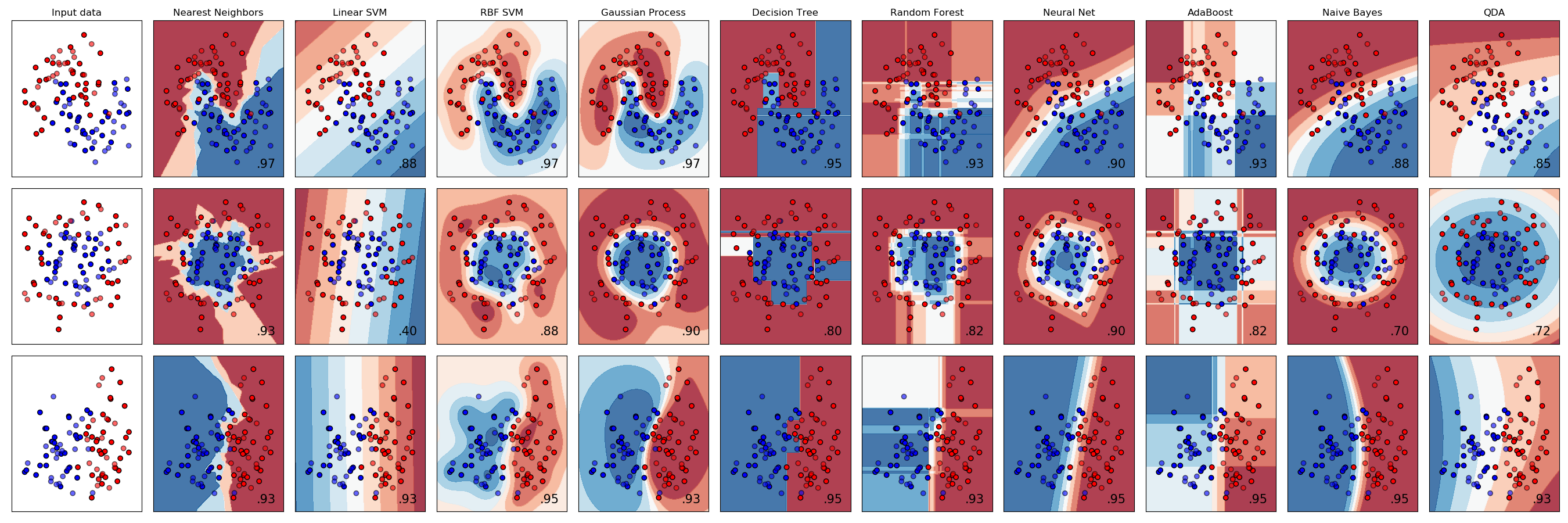

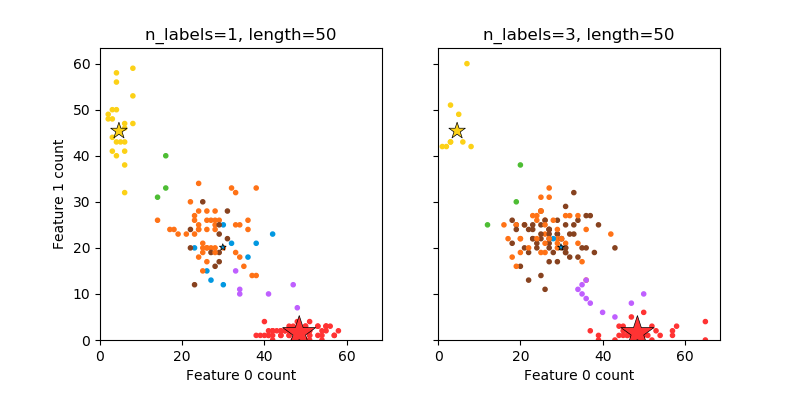

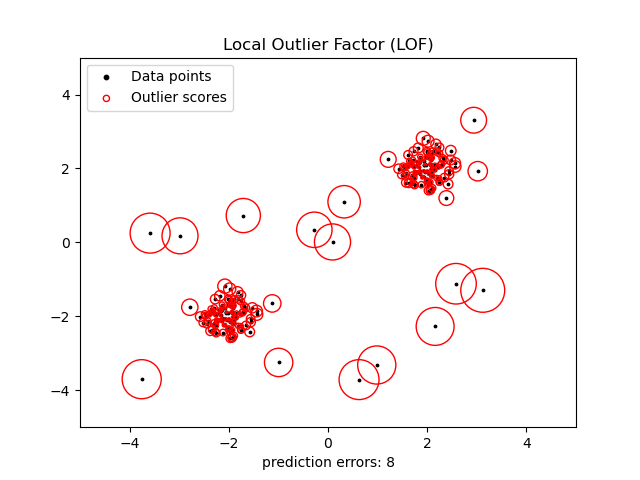

杂项 ¶

scikit-learn的其他案例和入门示例。

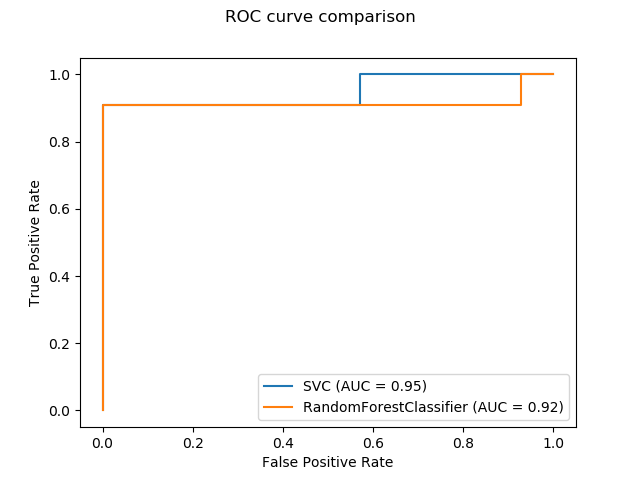

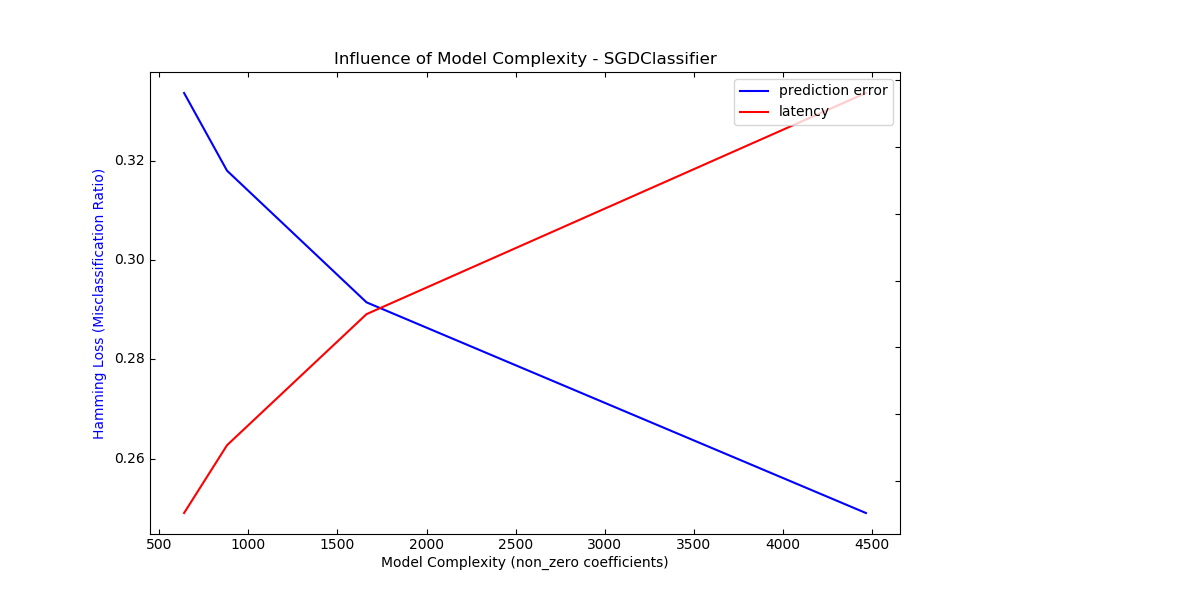

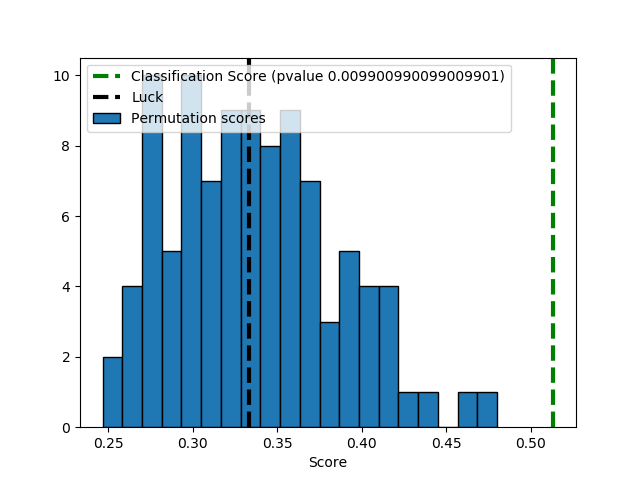

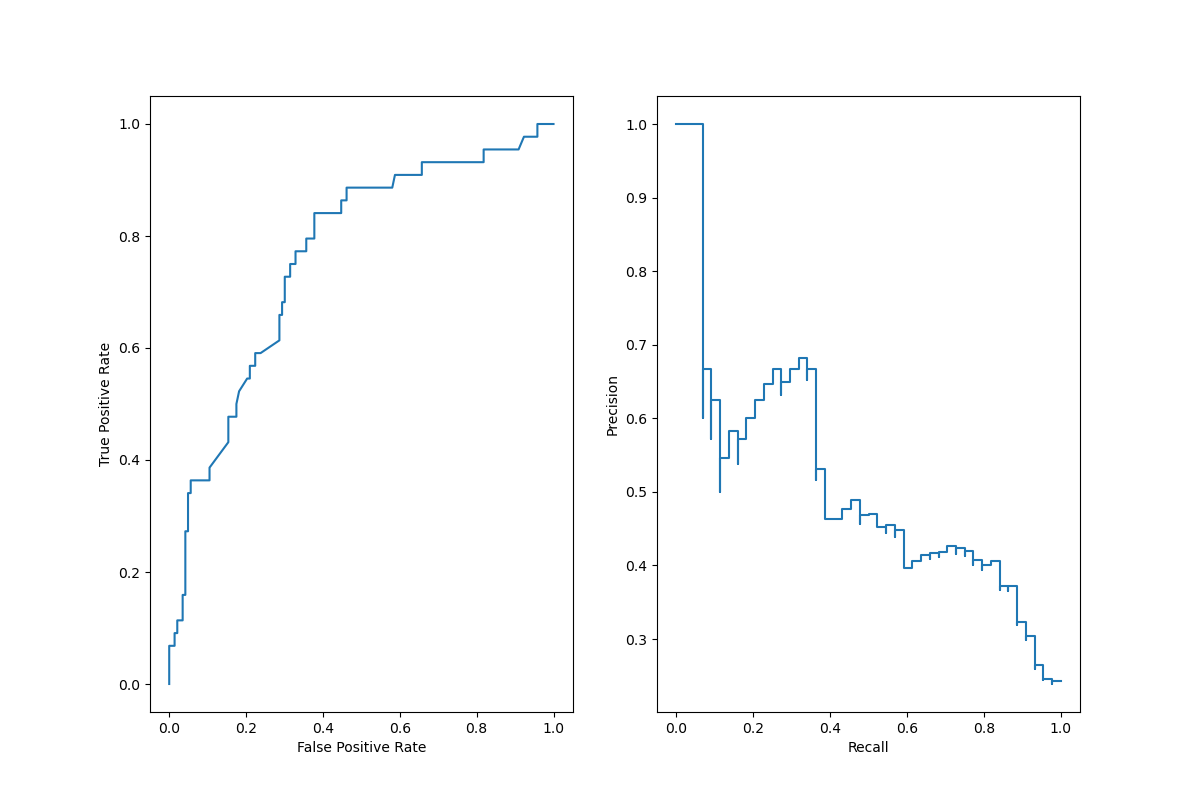

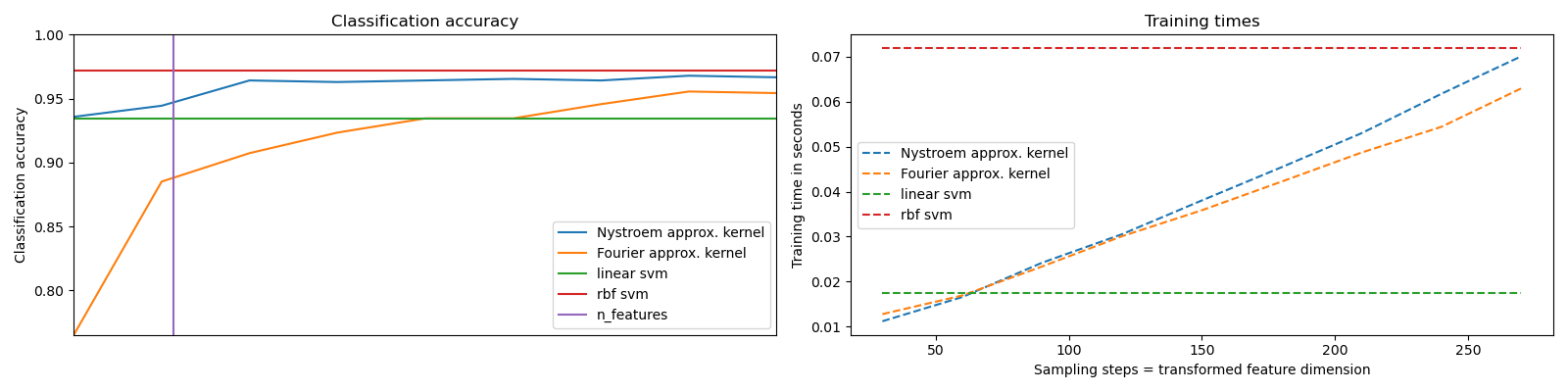

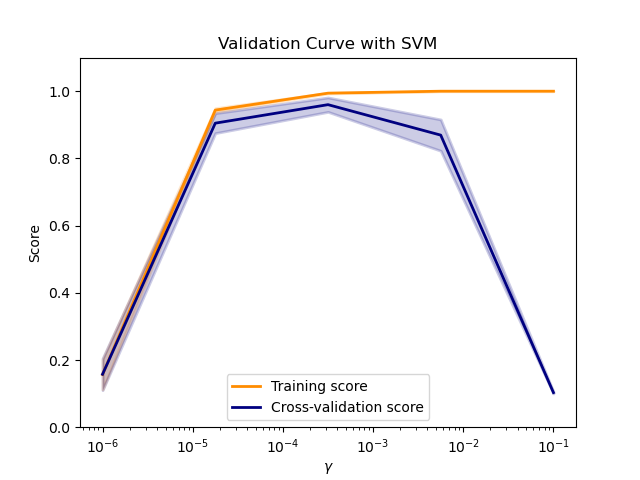

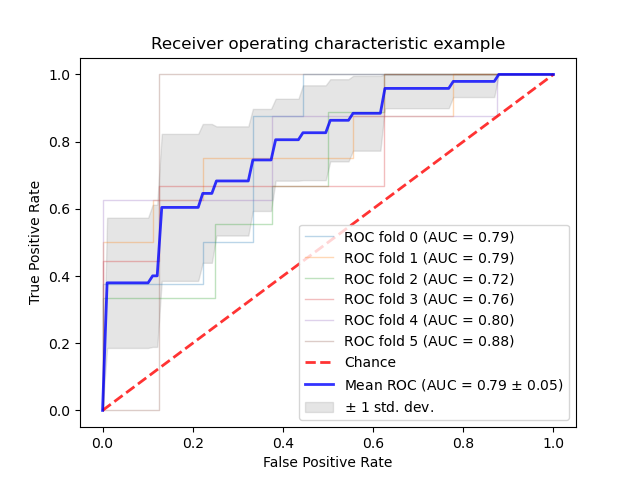

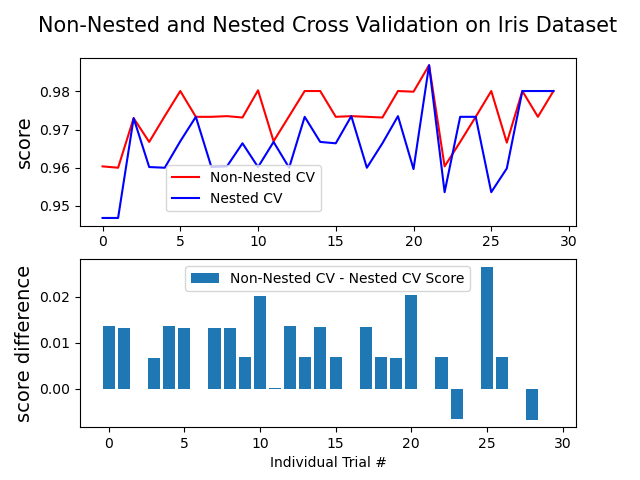

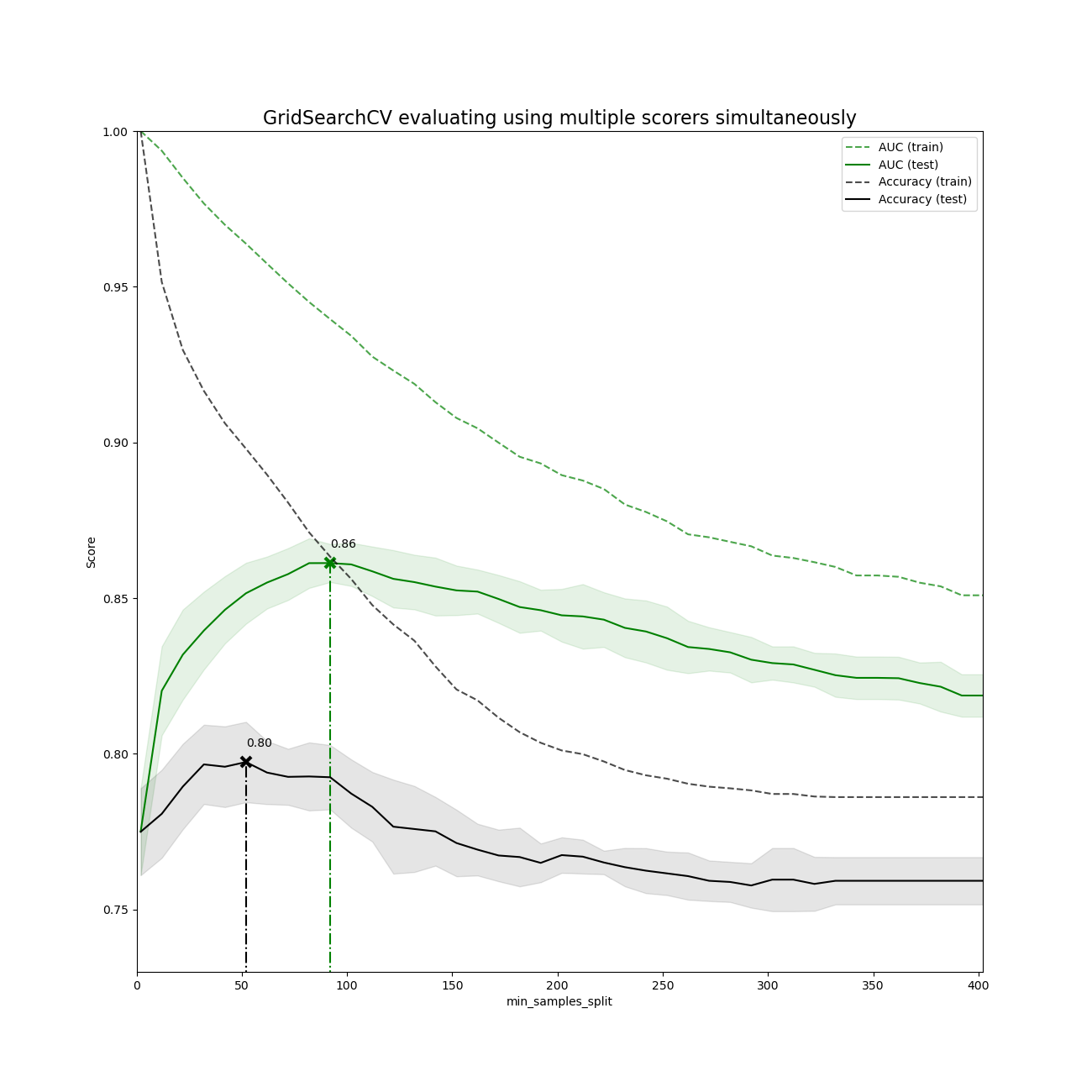

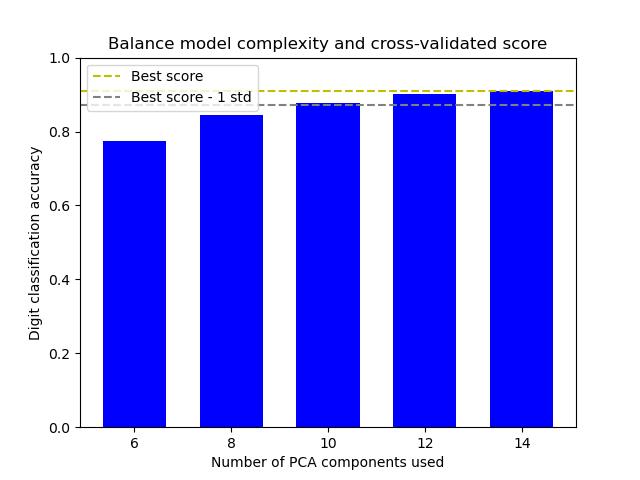

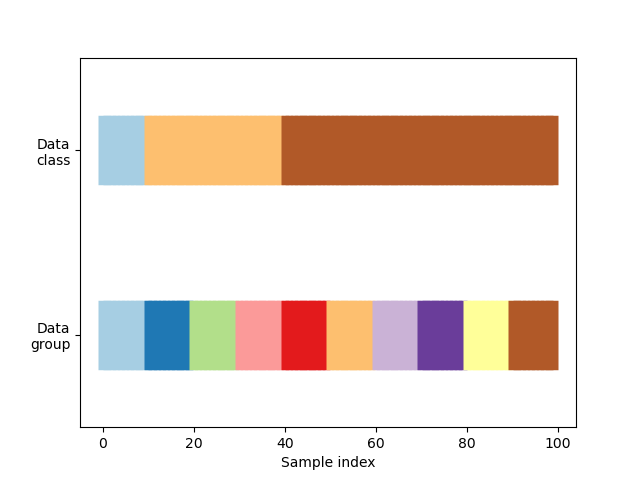

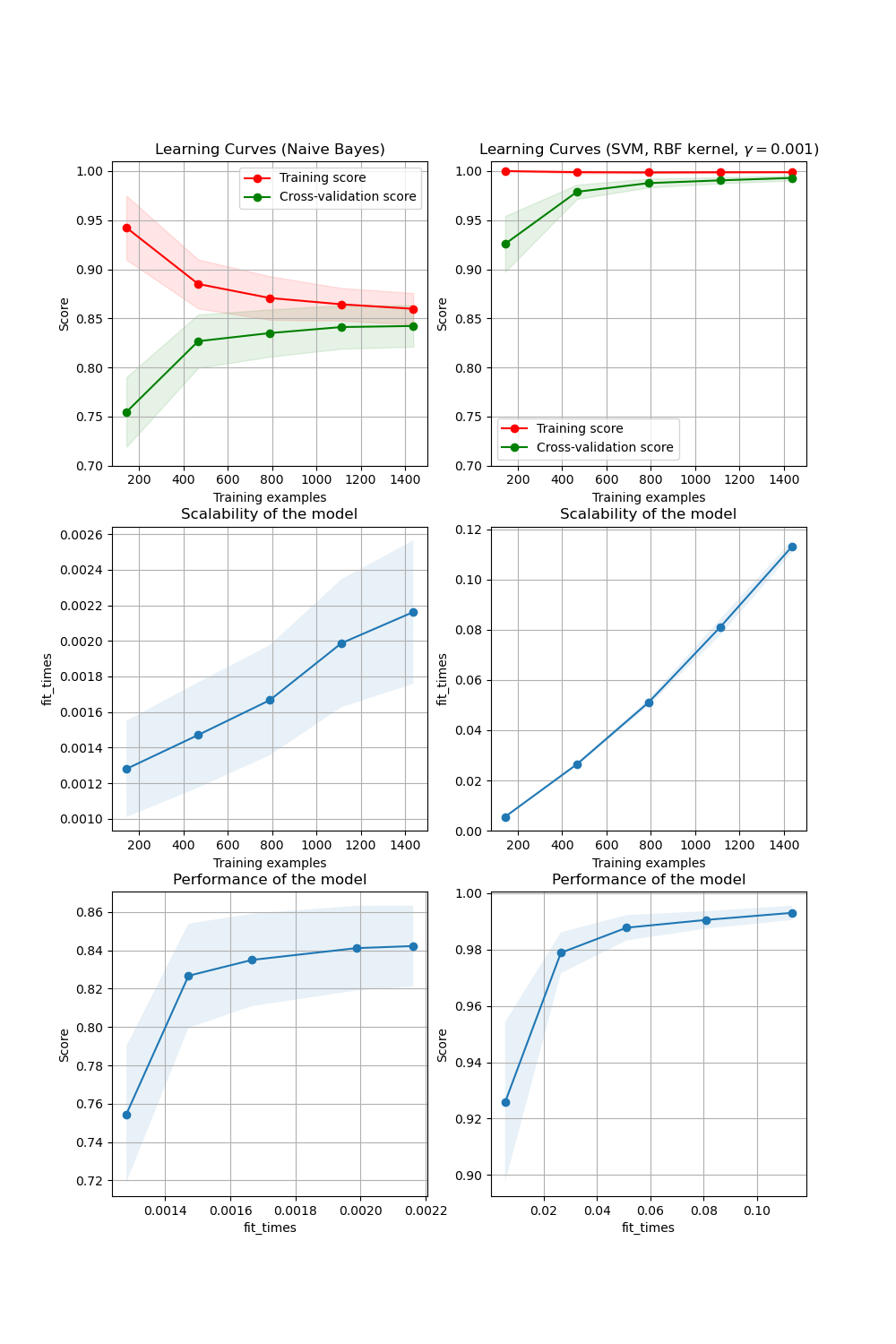

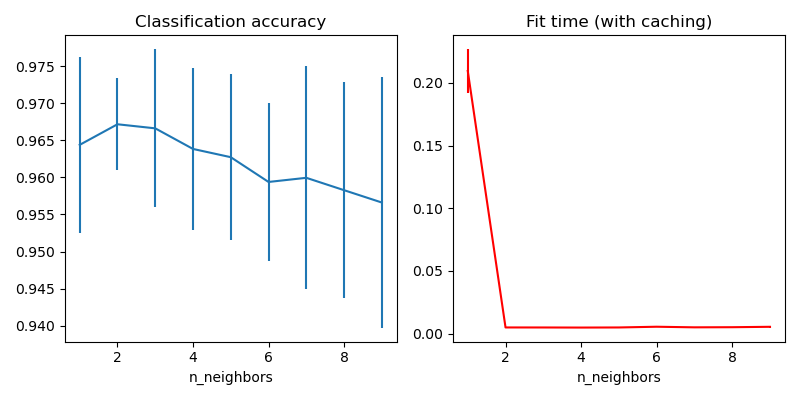

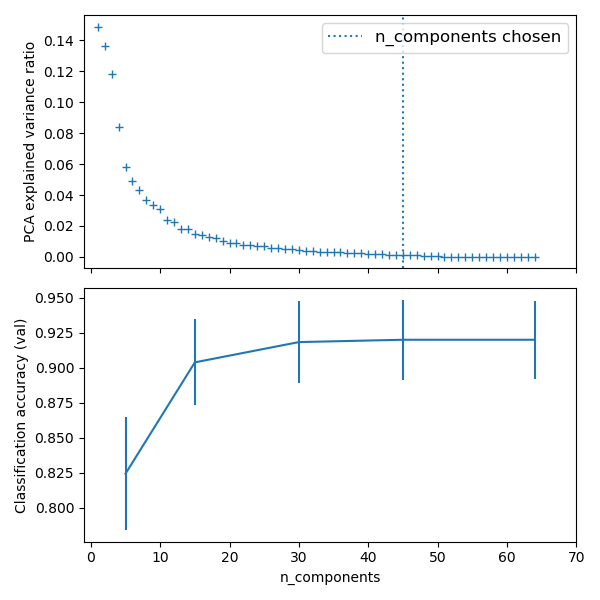

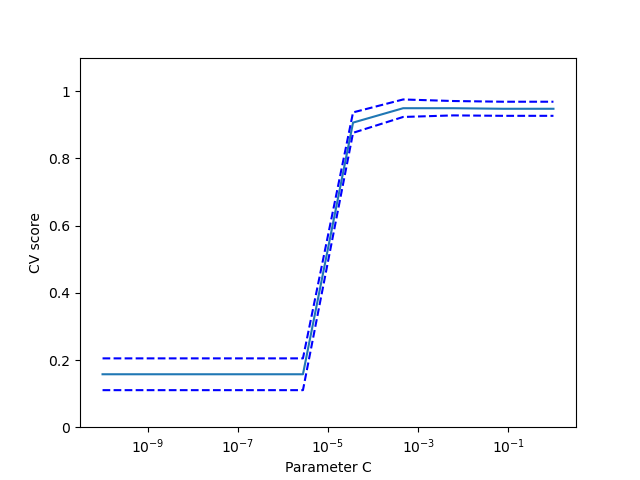

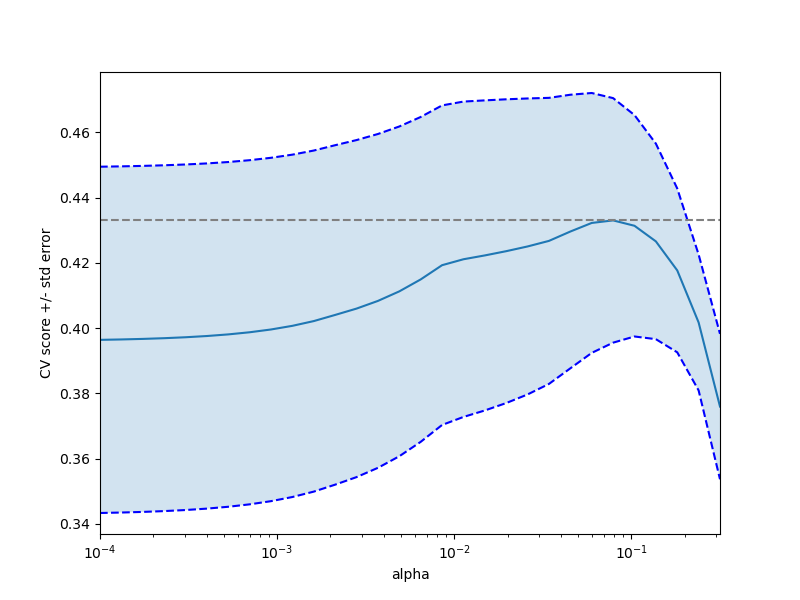

模型选择 ¶

与sklearn.model_selection模块有关的示例。

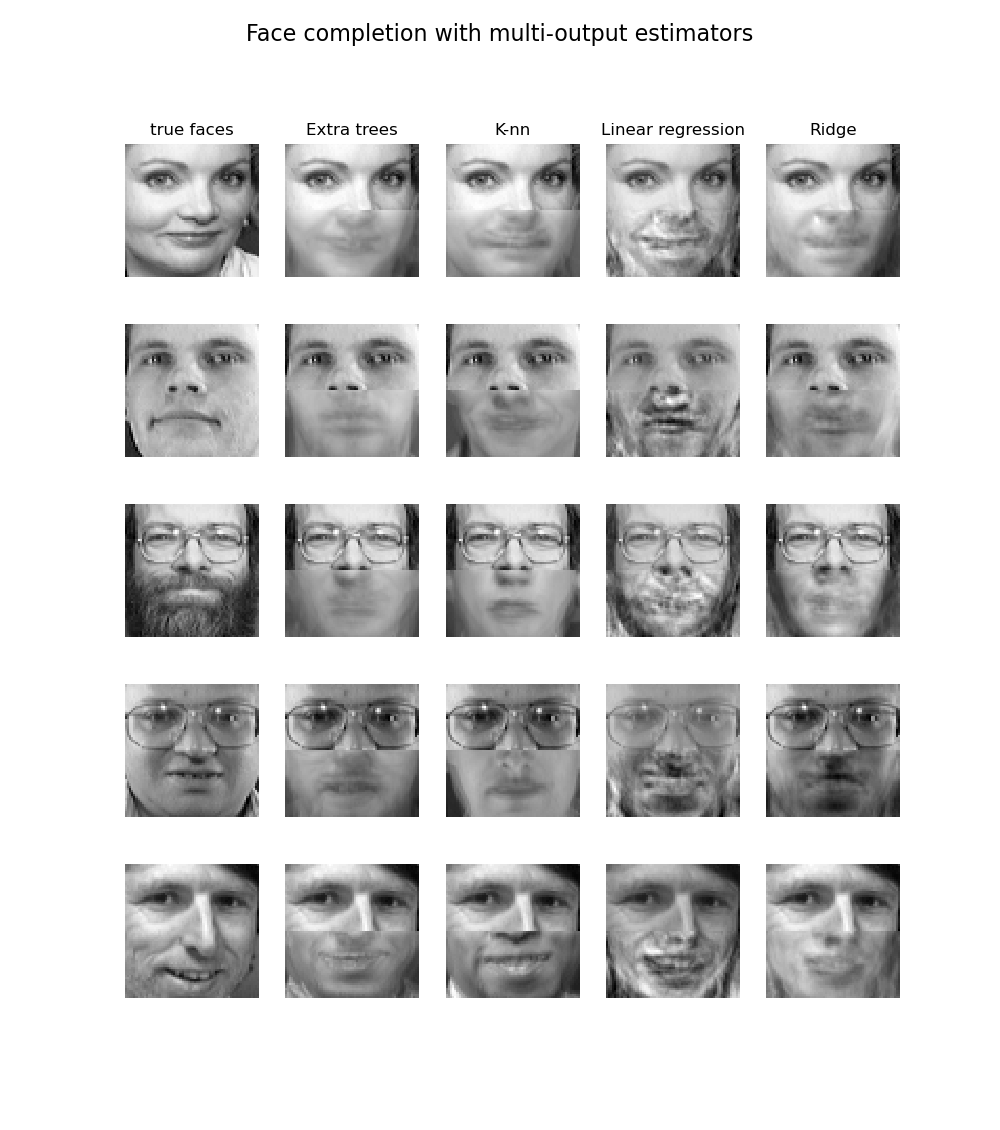

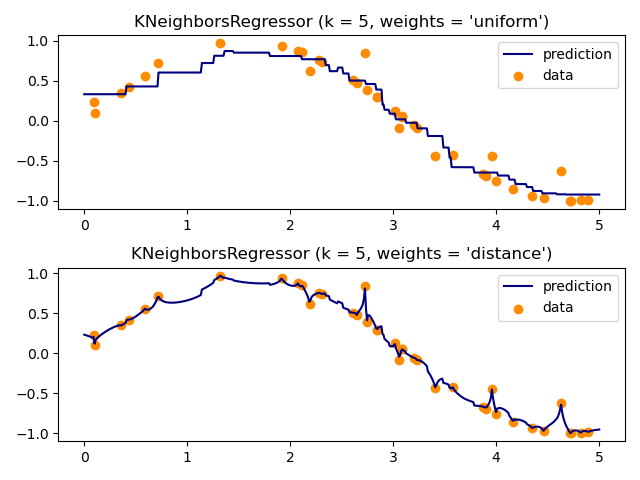

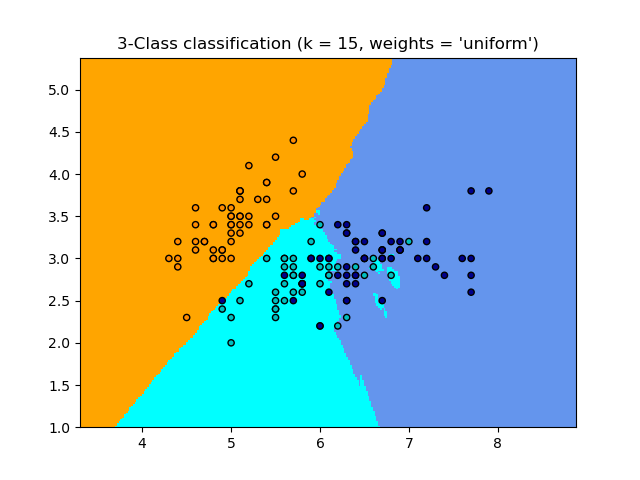

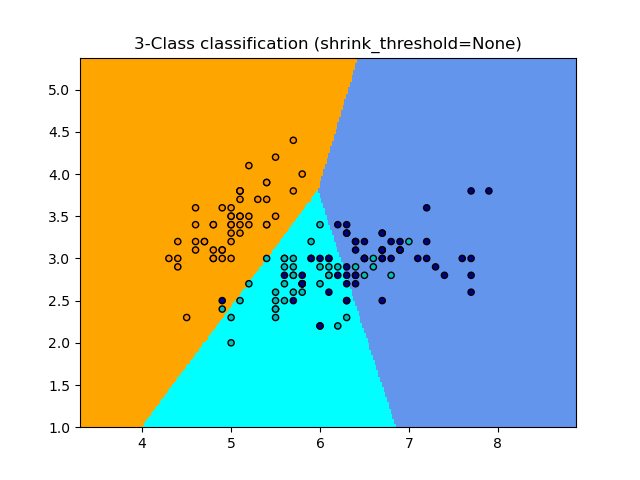

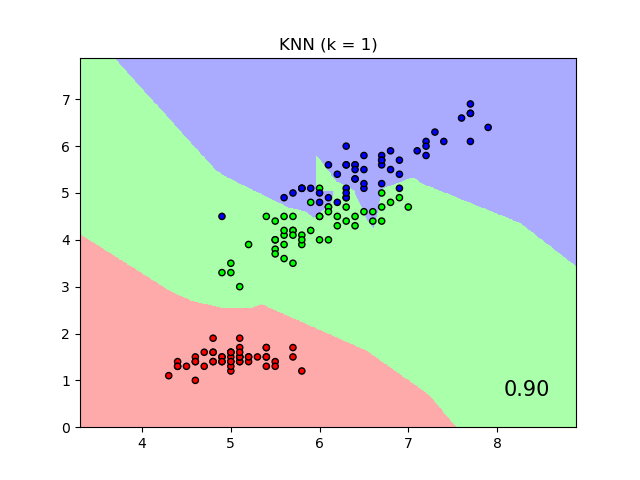

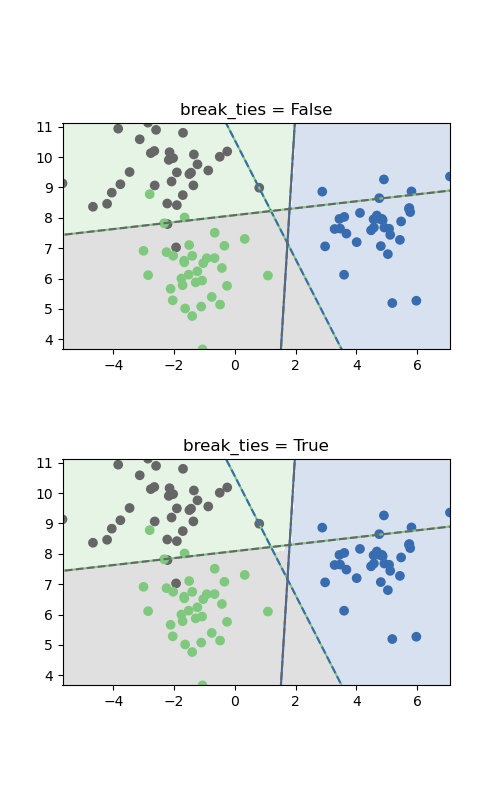

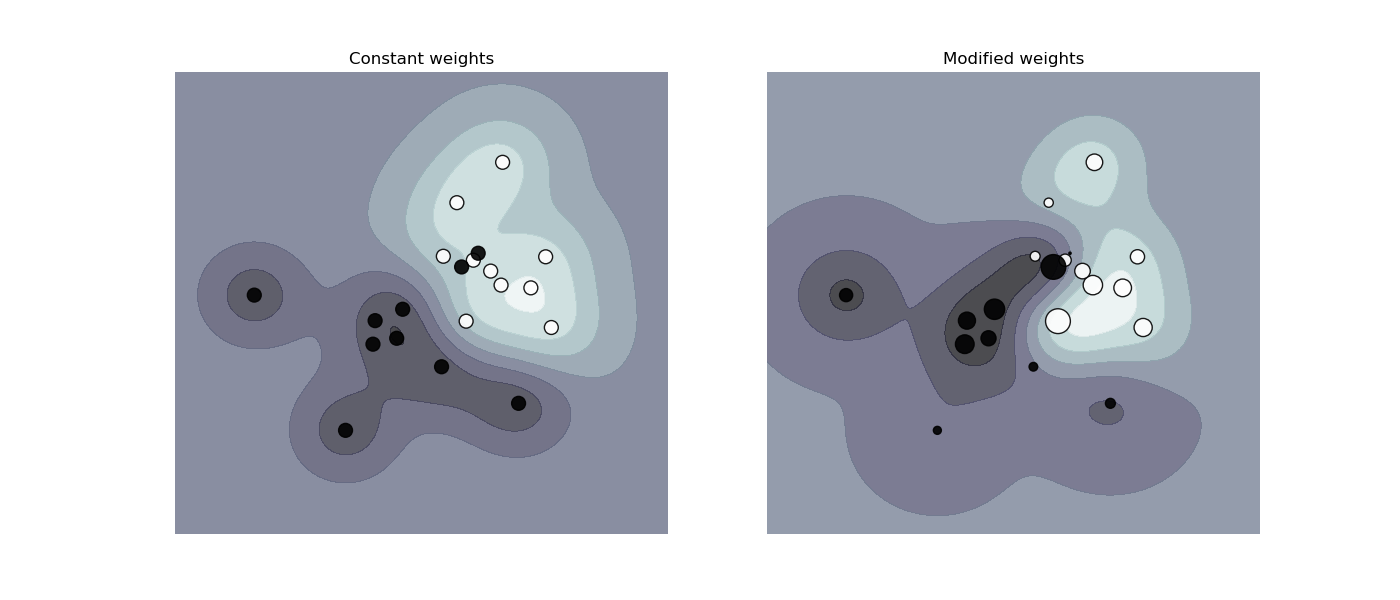

最近邻 ¶

有关sklearn.neighbors模块的示例。

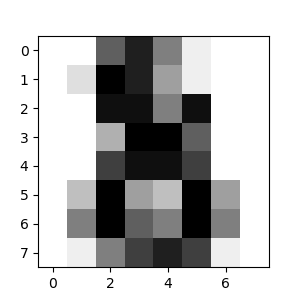

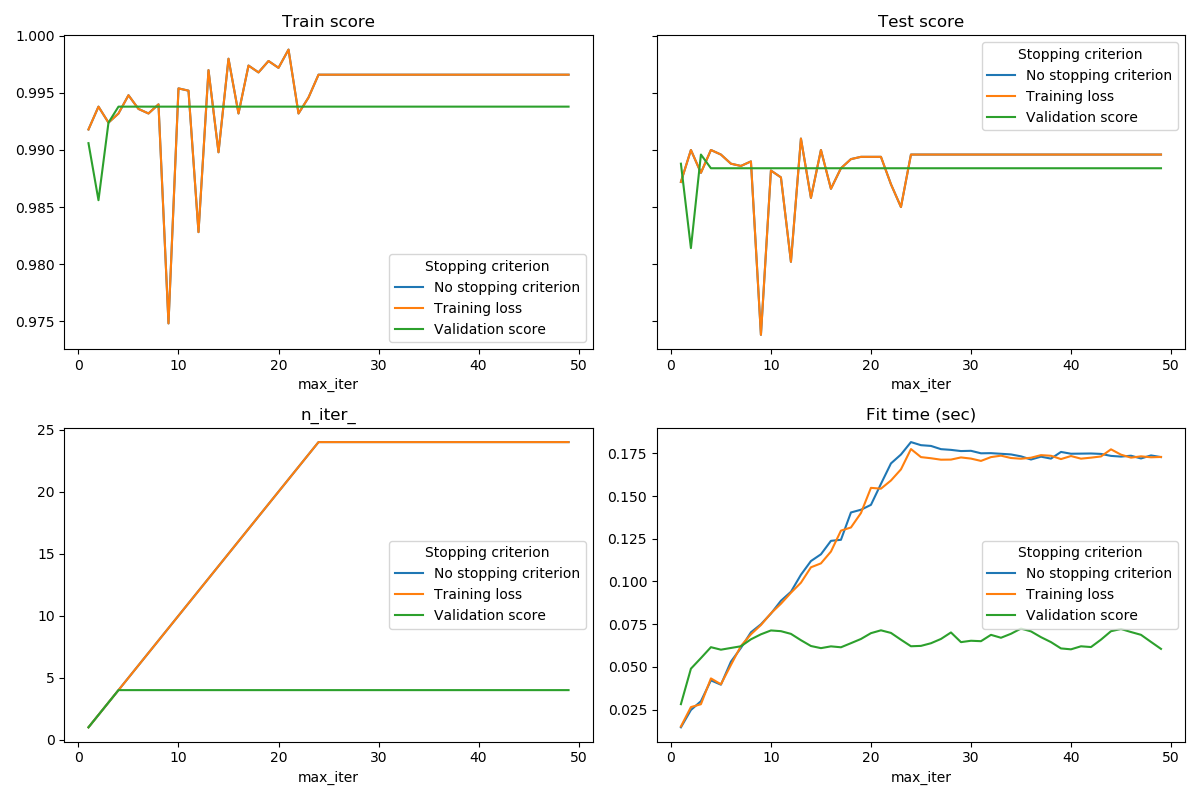

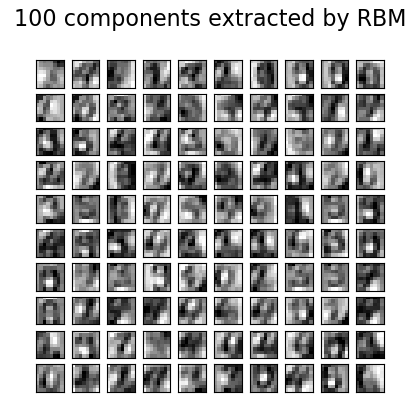

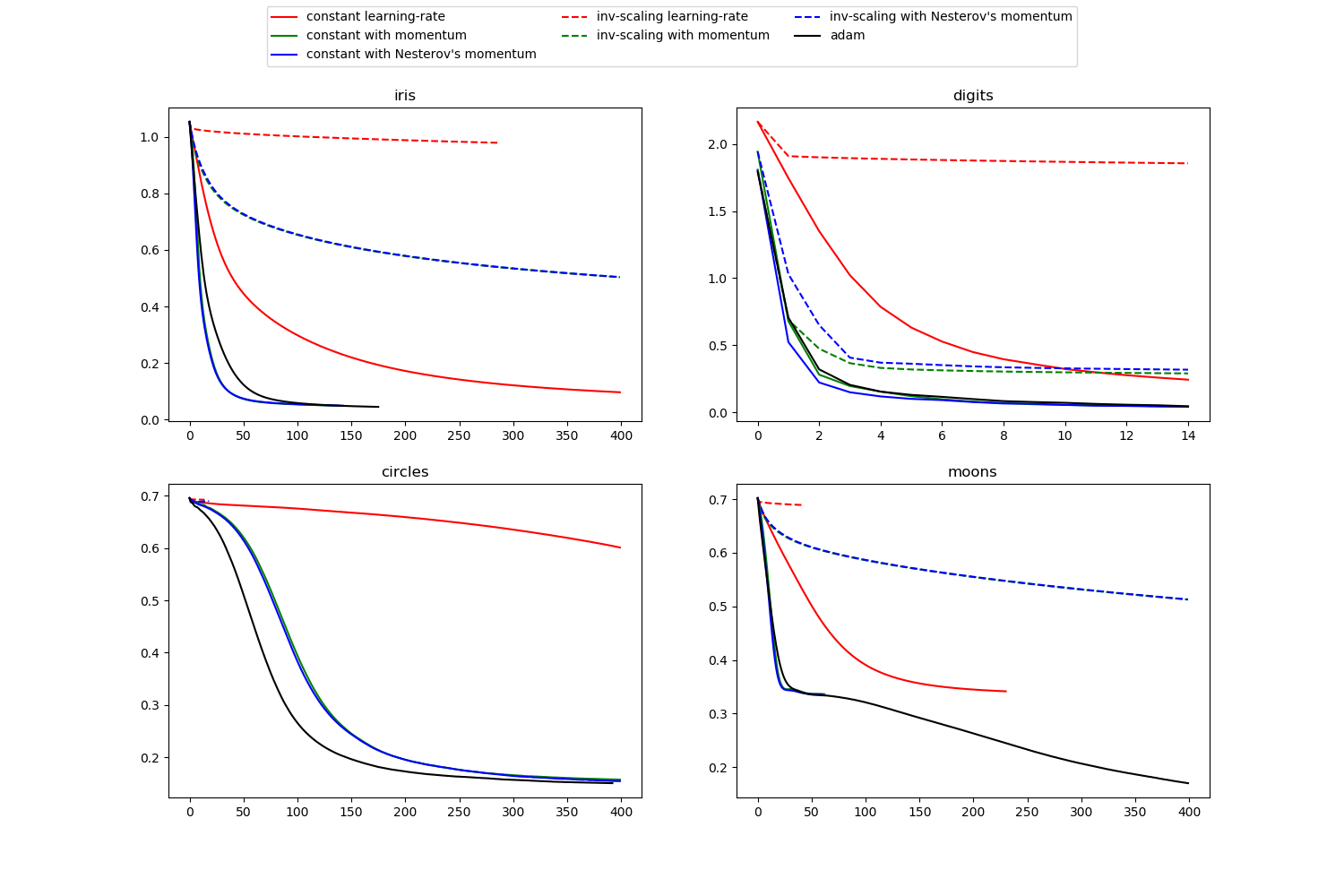

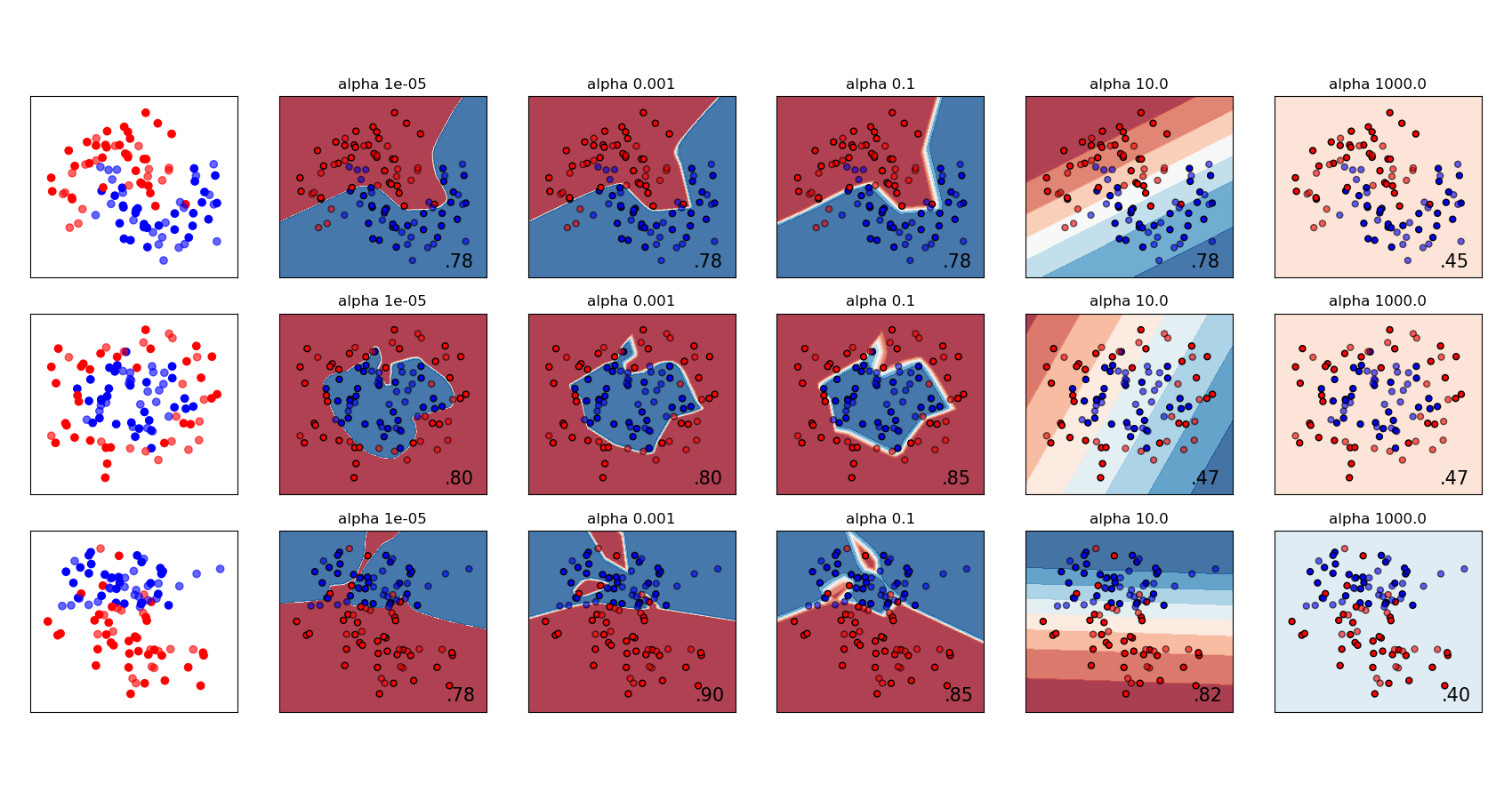

神经网络 ¶

有关sklearn.neural_network模块的示例。

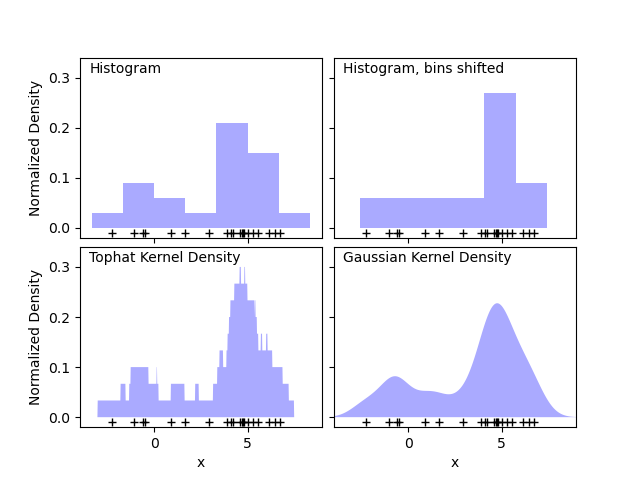

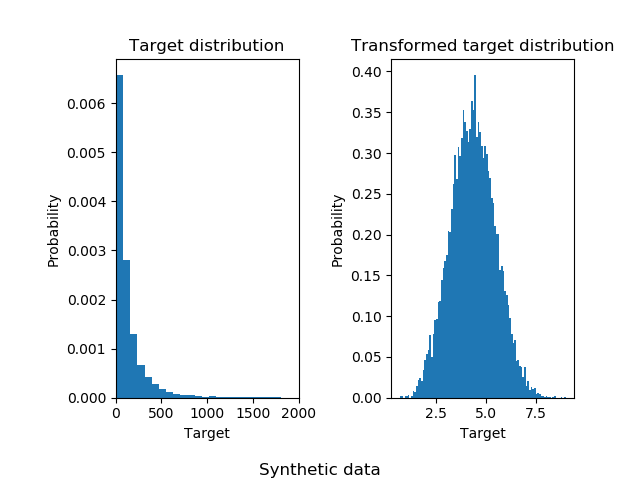

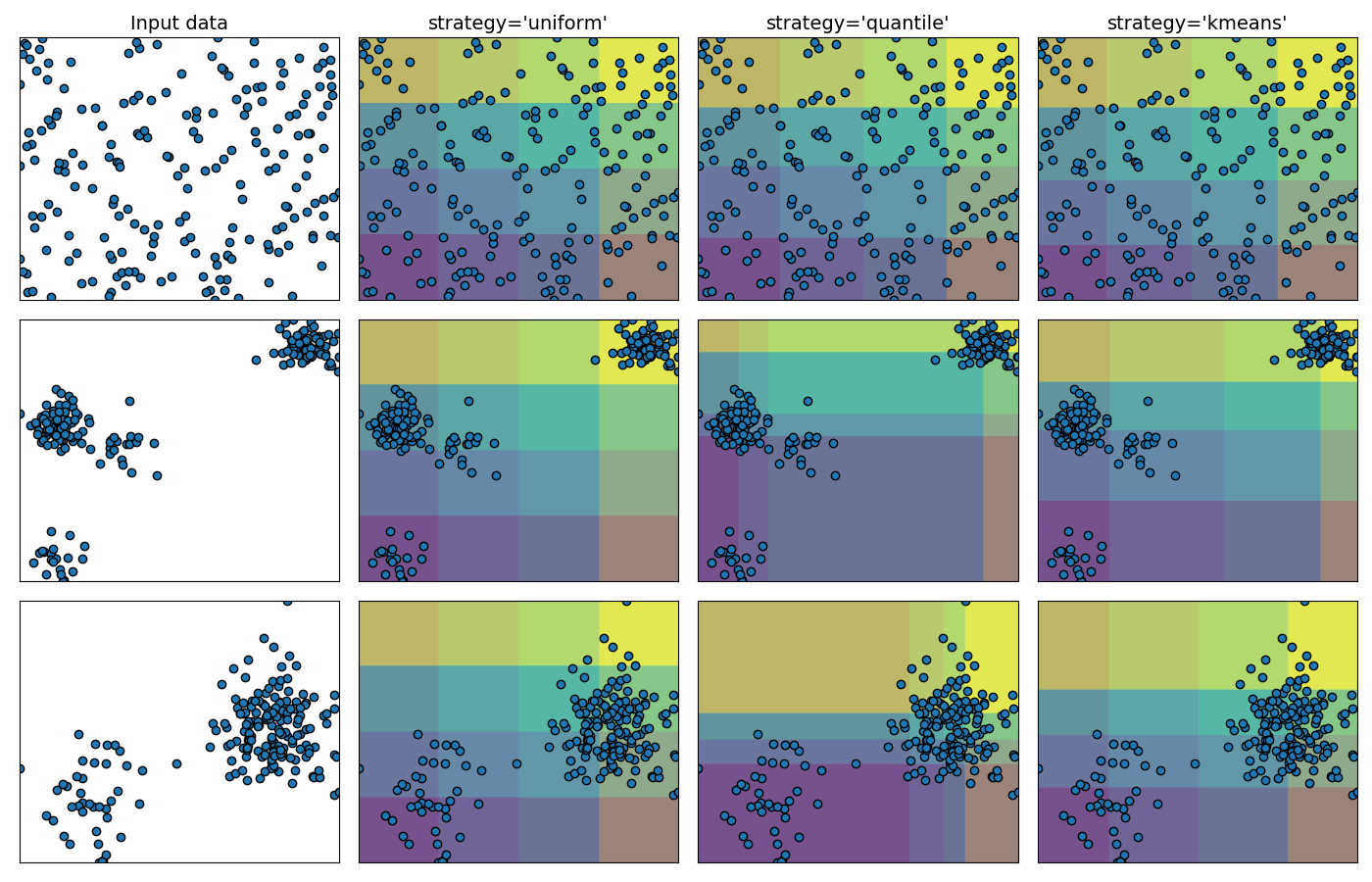

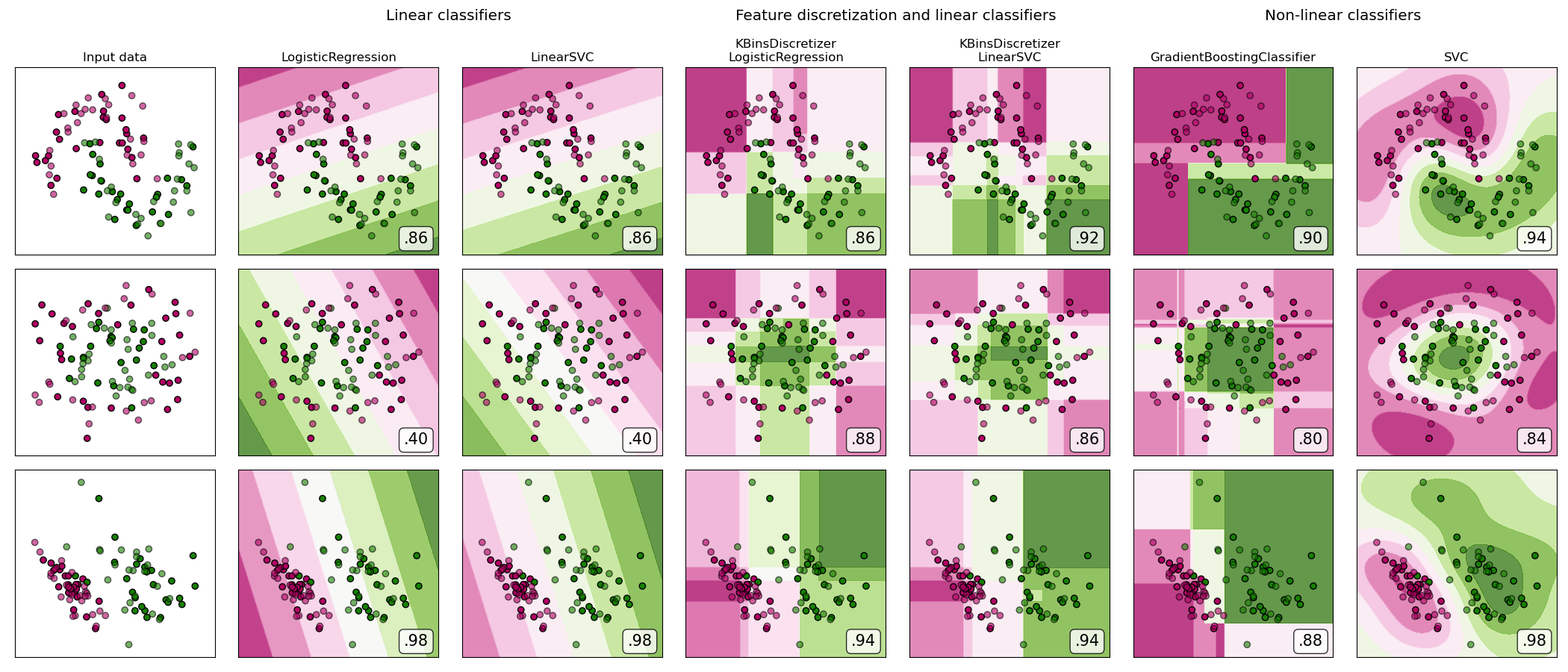

预处理 ¶

有关sklearn.preprocessing模块的示例。

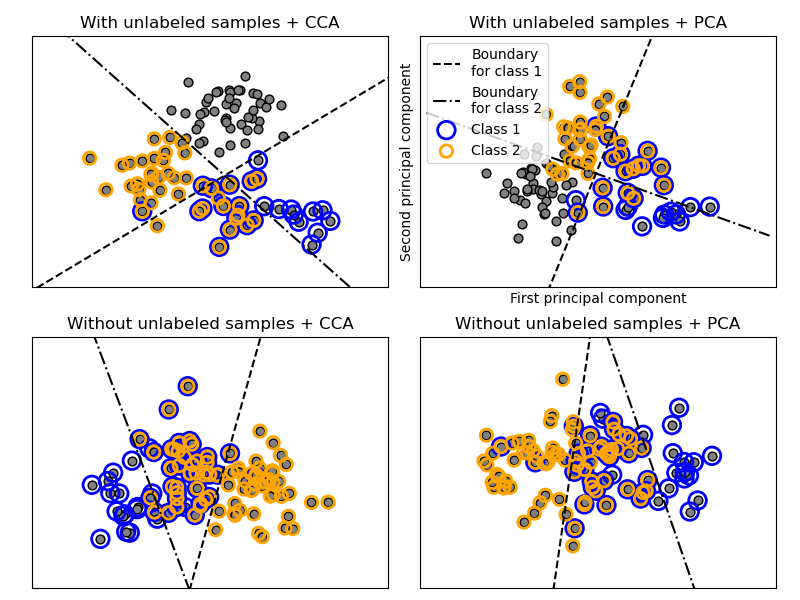

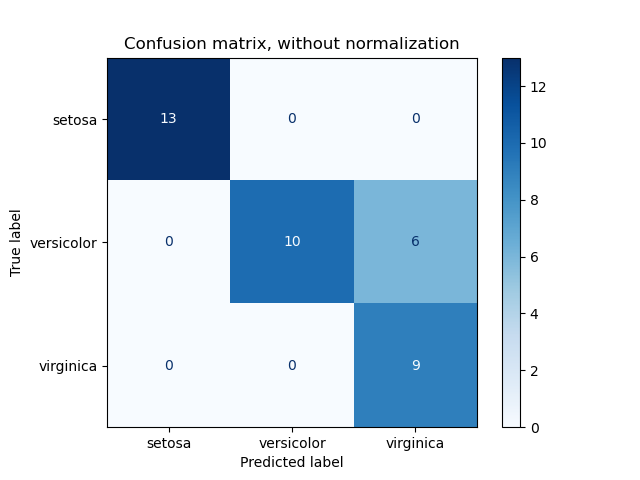

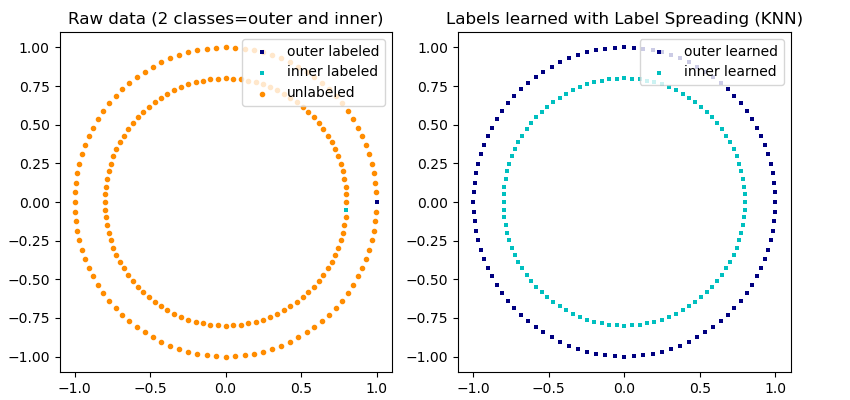

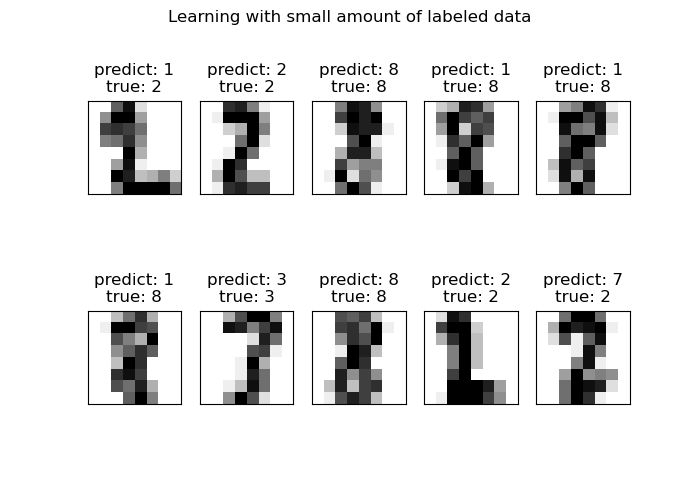

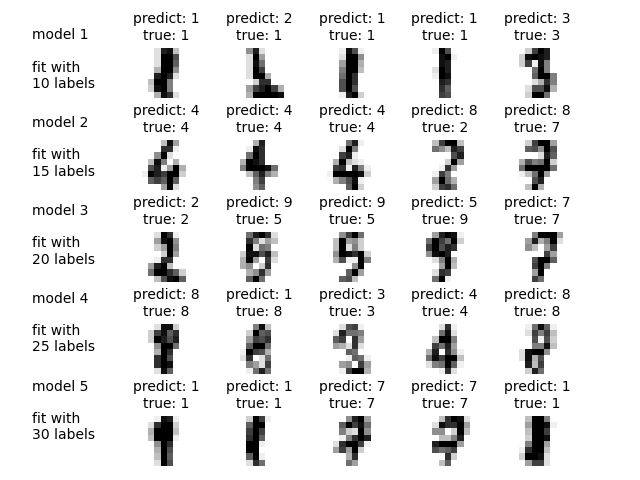

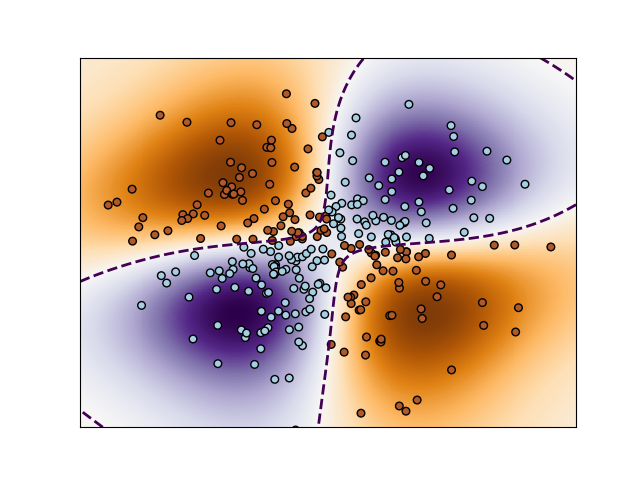

半监督分类 ¶

有关sklearn.semi_supervised模块的示例。

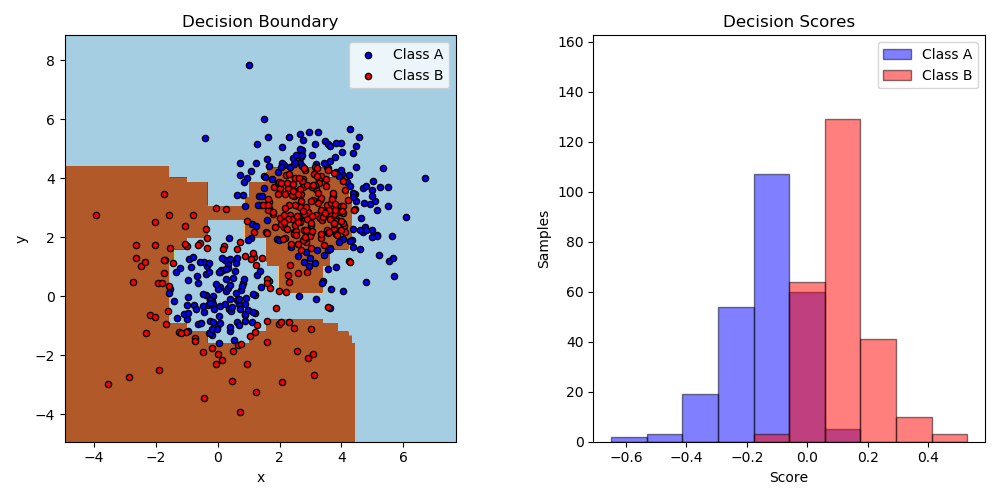

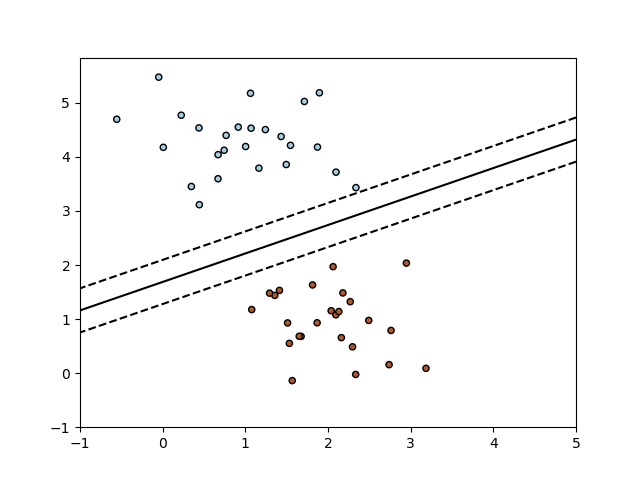

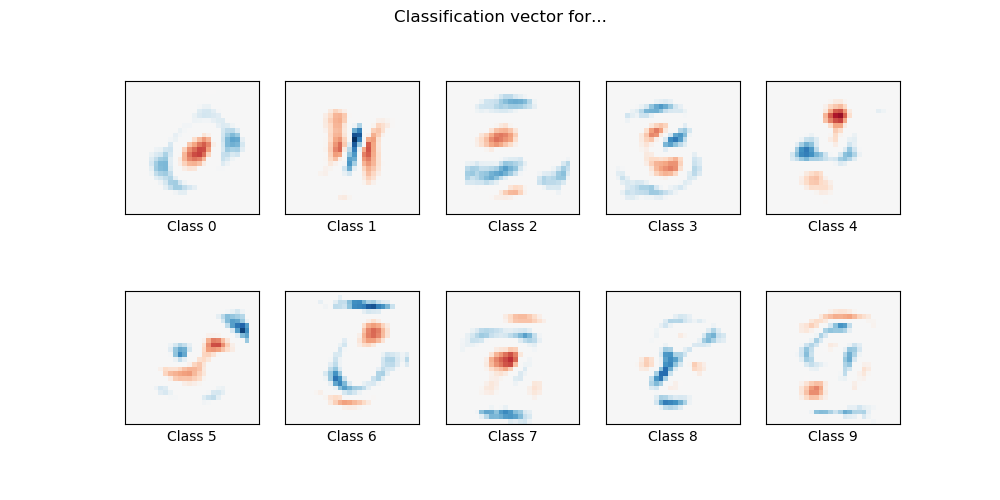

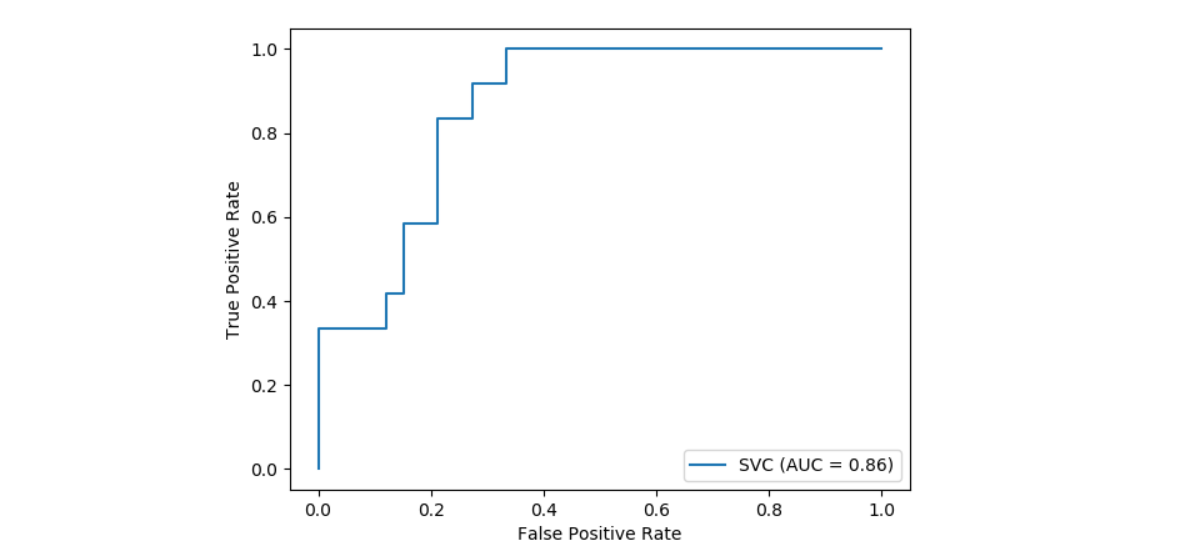

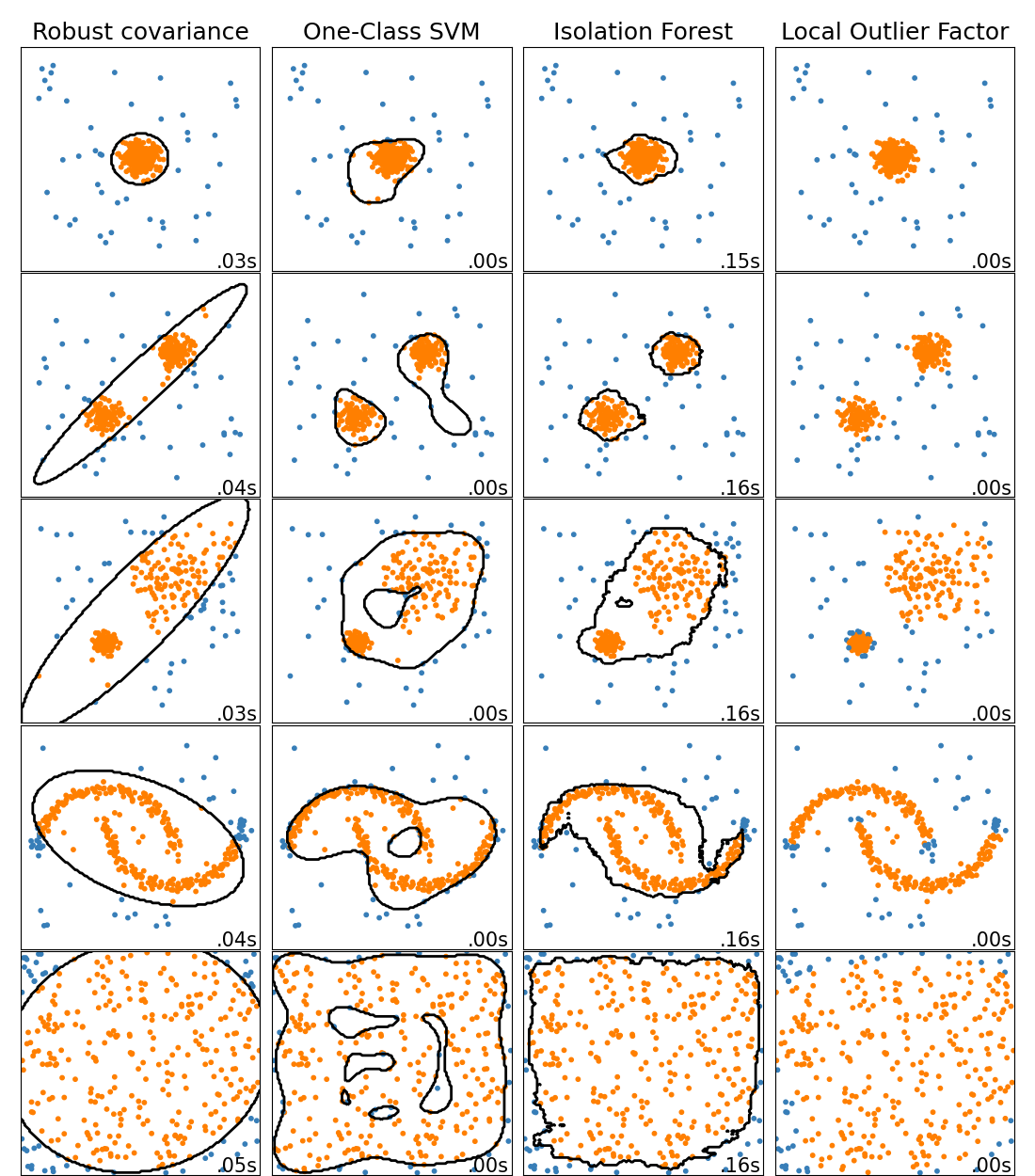

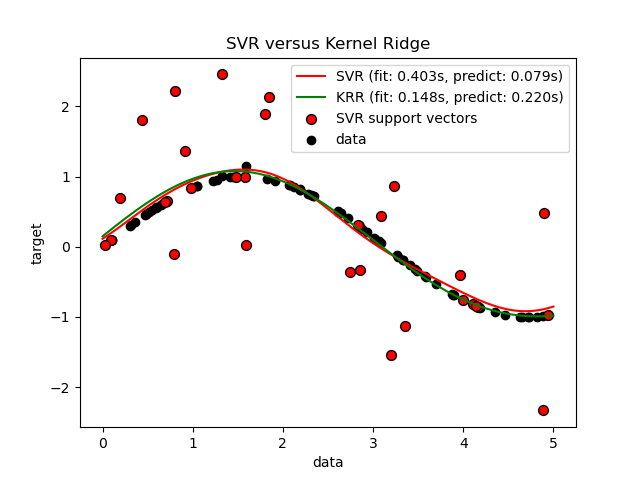

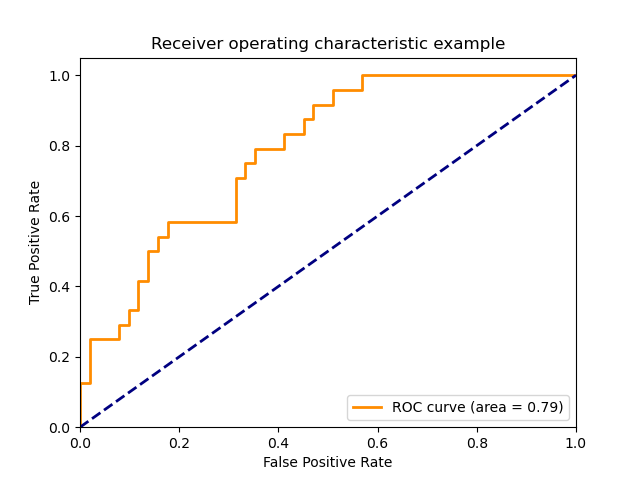

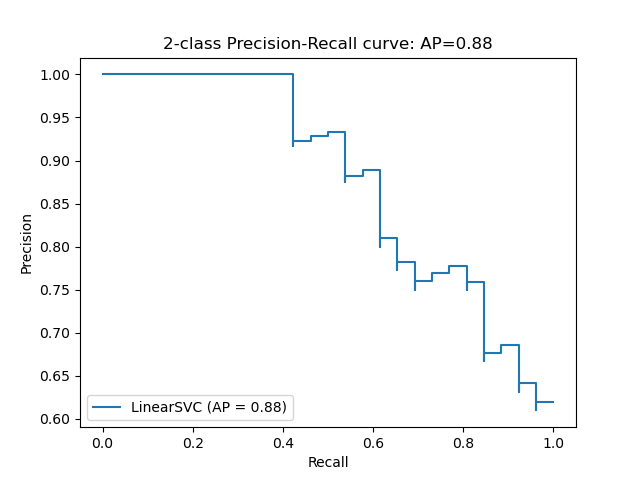

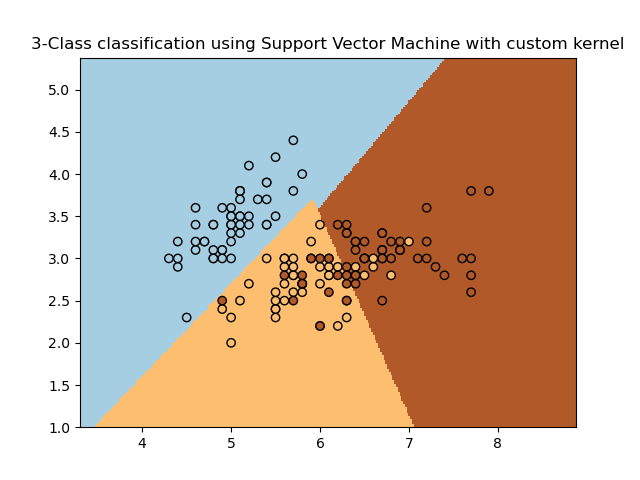

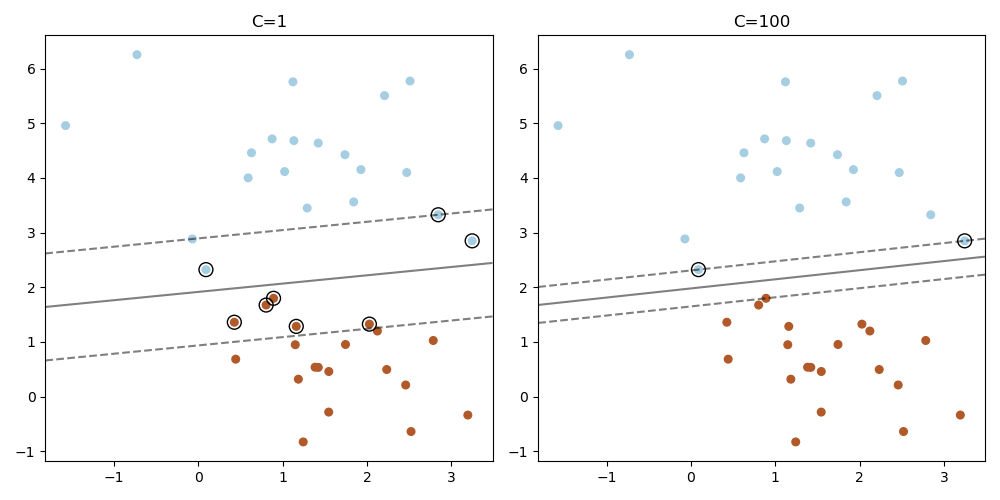

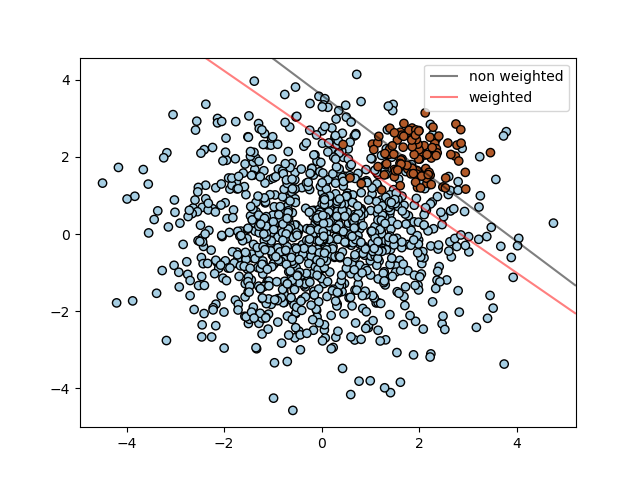

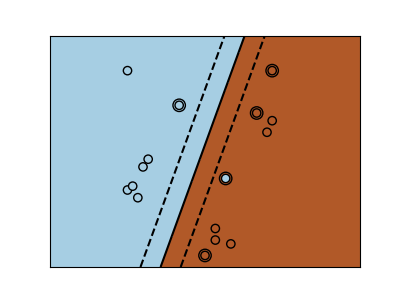

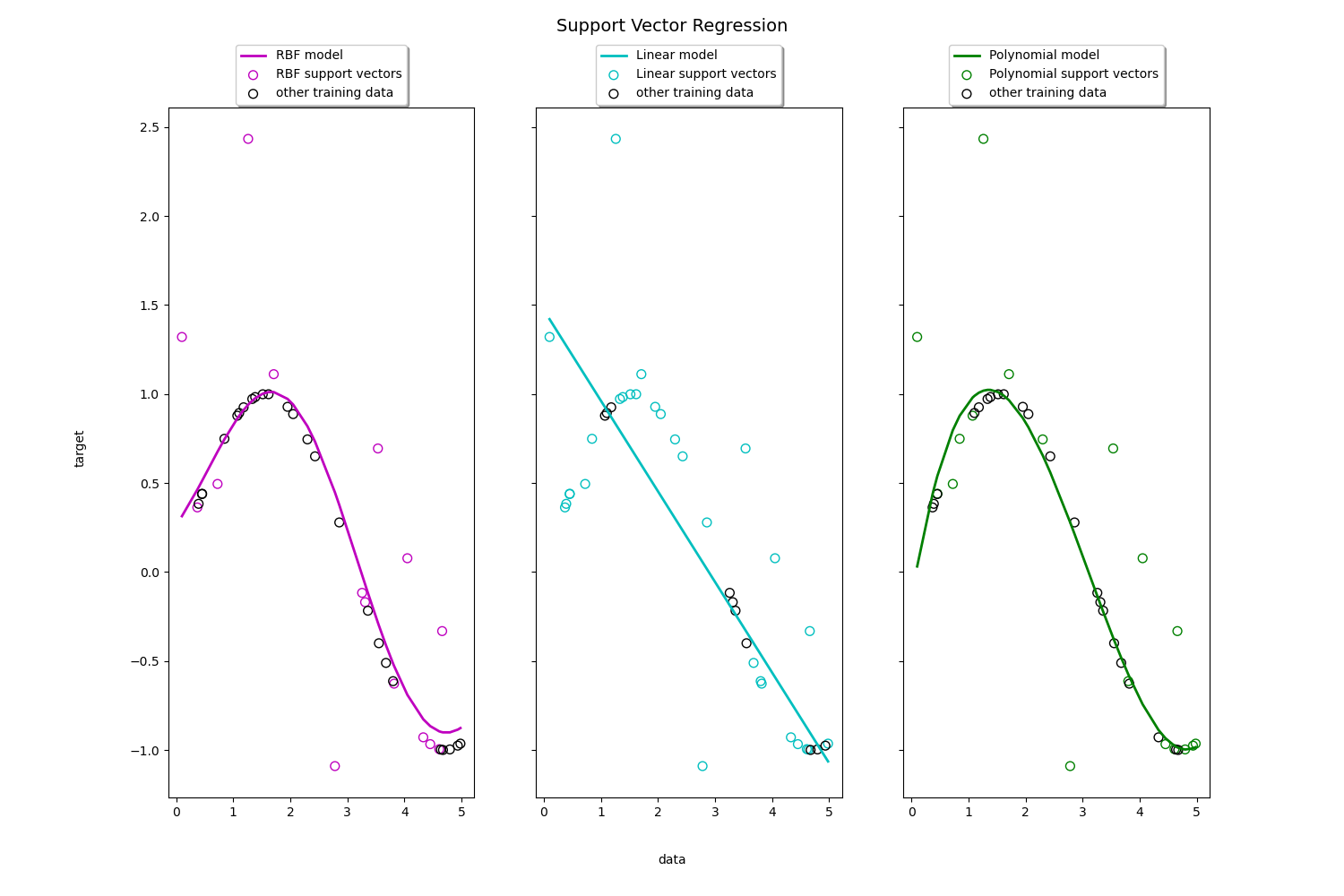

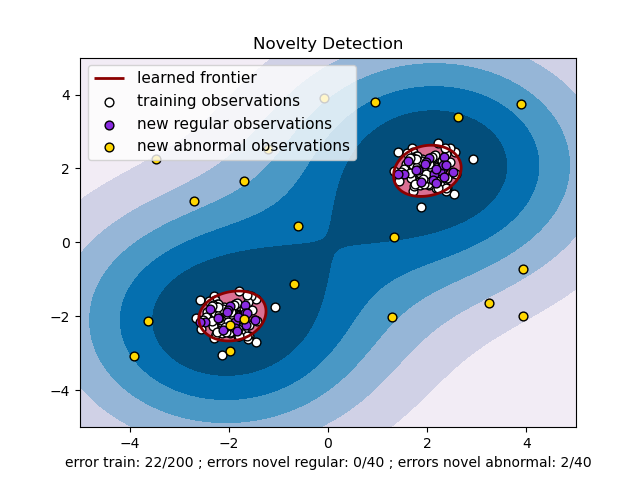

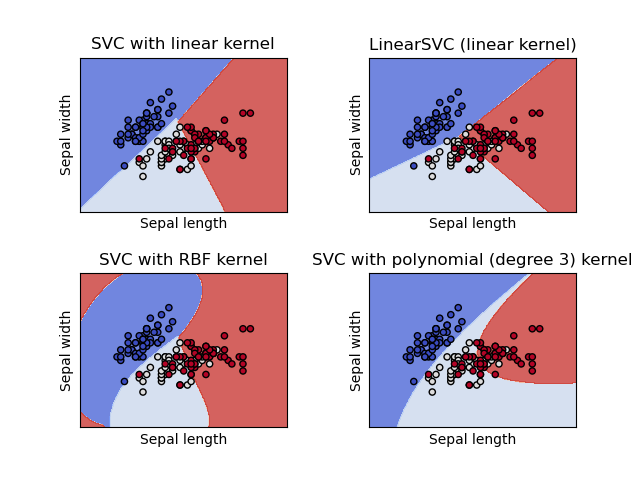

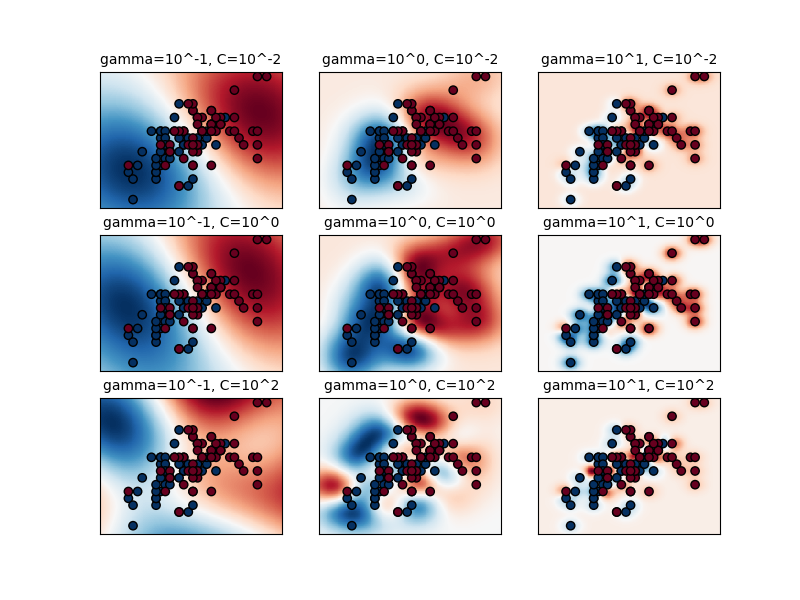

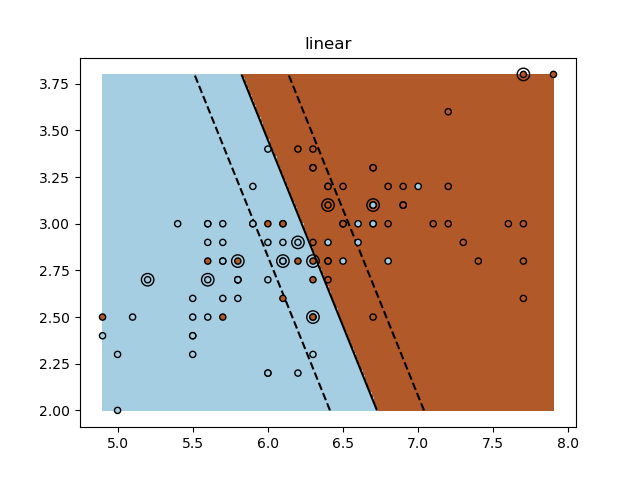

支持向量机 ¶

有关sklearn.svm模块的示例。