sklearn.linear_model.SGDClassifier¶

class sklearn.linear_model.SGDClassifier(loss='hinge', *, penalty='l2', alpha=0.0001, l1_ratio=0.15, fit_intercept=True, max_iter=1000, tol=0.001, shuffle=True, verbose=0, epsilon=0.1, n_jobs=None, random_state=None, learning_rate='optimal', eta0=0.0, power_t=0.5, early_stopping=False, validation_fraction=0.1, n_iter_no_change=5, class_weight=None, warm_start=False, average=False)

具有SGD训练的线性分类器(SVM,逻辑回归等)。

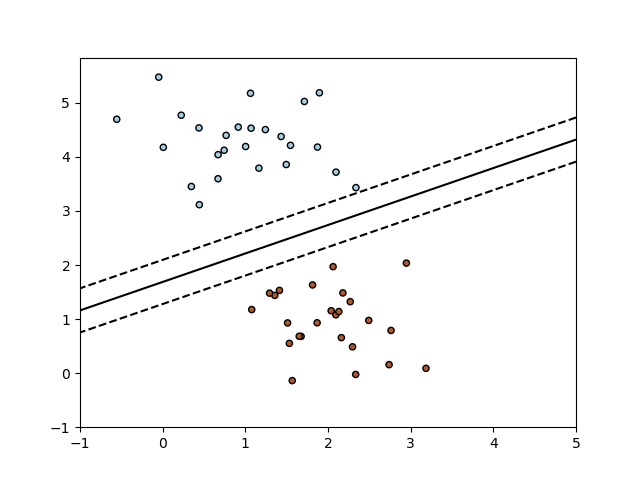

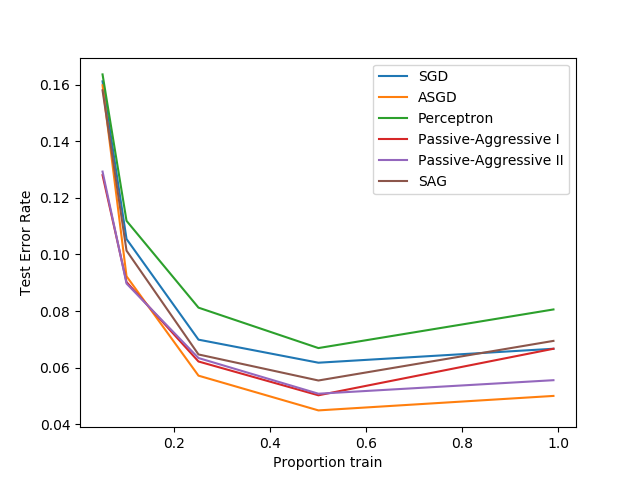

该估计器通过随机梯度下降(SGD)学习实现正则化线性模型:每次对每个样本估计损失的梯度,并以递减的强度(即学习率)沿此路径更新模型。SGD允许通过该partial_fit方法进行小批量(在线/核心外)学习。为了使用默认学习率计划获得最佳结果,数据应具有零均值和单位方差。

此实现使用表示为密集或稀疏浮点值数组的数据。它所拟合的模型可以用损失参数来控制;默认情况下,它适用于线性支持向量机(SVM)。

正则化器是一个附加在损失函数上的惩罚,它使用平方欧氏范数L2或绝对范数L1或两者的组合(弹性网)将模型参数收缩到零向量。如果由于正则化器的原因,参数更新跨越了0.0值,那么更新被截断为0.0,以允许学习稀疏模型和实现在线特征选择。

在用户指南中阅读更多内容。

| 参数 | 说明 |

|---|---|

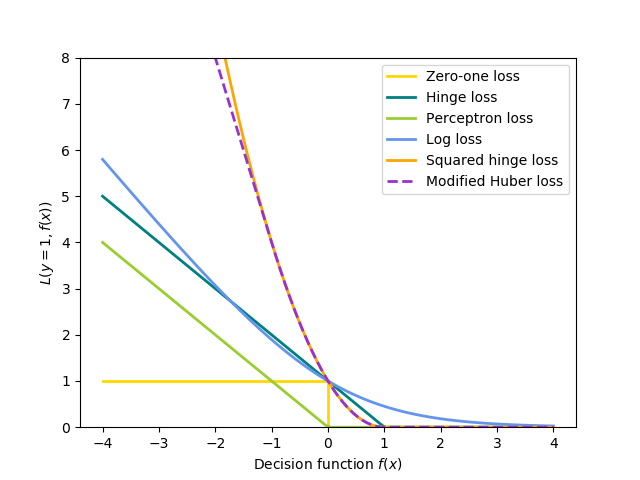

| loss | str, default=’hinge’ 要使用的损失函数。默认为'hinge',这将提供线性SVM。 可选项有“hinge”,“log”,“ modified_huber”,“ squared_hinge”,“ perceptron”或回归损失:“ squared_loss”,“ huber”,“ epsilon_insensitive”或“ squared_epsilon_insensitive”。 log损失使逻辑回归成为概率分类器。 'modified_huber'是另一个平滑的损失,它使异常值和概率估计具有一定的容忍度。“ squared_hinge”与hinge类似,但会受到二次惩罚。“perceptron”是感知器算法使用的线性损失。其他损失是为回归而设计的,但也可用于分类。请参阅 SGDRegressor以获取更多信息。 |

| penalty | {‘L2’, ‘L1’, ‘elasticnet’}, default=’L2’ 要使用的惩罚(又称正则化)。默认值为“ L2”,这是线性SVM模型的标准正则化器。“ L1”和“ elasticnet”可能会给模型带来稀疏性(特征选择),而这是“ l2”无法实现的。 |

| alpha | float, default=0.0001 与正则项相乘的常数。值越高,正则化越强。当 learning_rate设置为“optimal” 时,也用于计算学习率。 |

| l1_ratio | float, default=0.15 弹性网混合参数,其中0 <= l1_ratio <=1。l1_ratio = 0对应于L2惩罚,l1_ratio = 1对应与L1惩罚。仅在 penalty为“ elasticnet”时使用。 |

| fit_intercept | bool, default=True 是否估计截距。如果为False,则假定数据已经中心化。 |

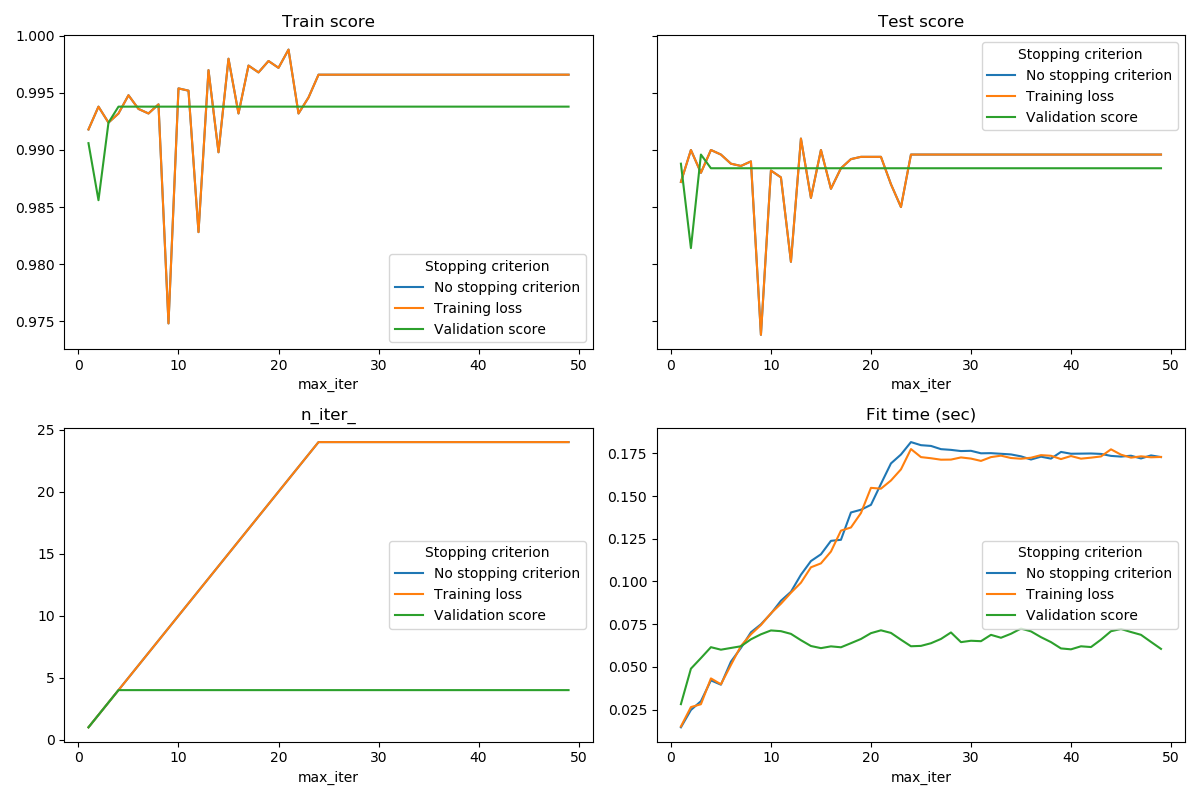

| max_iter | int, default=1000 通过训练数据的最大次数(又称历元)。它只会影响 fit方法中的行为,而不会影响 partial_fit方法。0.19版本中的新功能。 |

| tol | float, default=1e-3 停止标准。如果不是None,则连续 n_iter_no_change次(eploss> best_loss-tol)时迭代将停止。0.19版本中的新功能。 |

| shuffle | bool, default=True 在每次迭代之后是否重新打乱训练数据。 |

| verbose | int, default=0 日志的详细程度。 |

| epsilon | float, default=0.1 仅当 loss是“ huber”,“ epsilon_insensitive”或“ squared_epsilon_insensitive”时,损失函数对epsilon是不敏感的。对于“huber”,确定一个阈值,在这个阈值上,准确预测变得不那么重要了。对于epsilon不敏感的情况,如果当前的预测和正确的标签小于这个阈值,那么它们之间的任何差异都将被忽略。 |

| n_jobs | int, default=None 用于执行OVA(对于多类问题而言为“一个对所有”)的CPU内核数。除非 joblib.parallel_backend在上下文中进行了设置,否则None表示1 。 -1表示使用所有处理器。有关 更多详细信息,请参见词汇表。 |

| random_state | int, RandomState instance, default=None 用于打乱训练数据,当 shuffle设置为 True。可以用一个整数为多个函数调用传递重复的输出。请参阅词汇表。 |

| learning_rate | str, default=’optimal’ 学习率参数: - ‘constant’: eta = eta0- ‘optimal’: eta = 1.0 / (alpha * (t + t0)),其中t0由Leon Bottou提出的启发式方法选择。- ‘invscaling’: eta = eta0 / pow(t, power_t)- ‘adaptive’:eta = eta0,只要训练持续减少即可。如果early_stopping为True,每次迭代中连续n_iter_no_change次未能减少tol的训练损失或未能增加tol的验证分数,则当前学习率除以5。 *0.20版中的新功能:*添加了“adaptive”选项 |

| eta0 | double, default=0.0 “constant”,“invscaling”或“adaptive”,初始学习率。默认值为0.0,因为eta0没有被默认的选项' optimal '。 |

| power_t | double, default=0.5 逆标度学习率指数[默认0.5]。 |

| early_stopping | bool, default=False 是否使用验证提前停止终止训练。如果设置为True,它将自动将训练数据的分层部分的 score留作验证,并在连续n_iter_no_change次的验证分数没有提高至少tol时终止训练。0.20版中的新功能。 |

| validation_fraction | float, default=0.1 预留的训练数据比例作为早期停止的验证集。必须介于0和1之间。仅在 early_stopping为True时使用。 |

| n_iter_no_change | int, default=5 迭代次数,结果没有改善,迭代需要提前停止。 *0.20版中的新功能:*添加了“ n_iter_no_change”选项 |

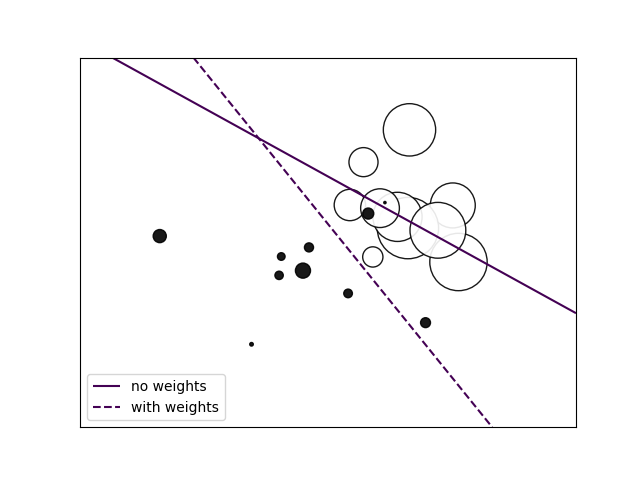

| class_weight | dict, {class_label: weight} or “balanced”, default=None 预设class_weight 拟合参数。 类别关联的权重。如果没有给出,所有类别的权重都应该是1。 “balanced”模式使用y的值来自动调整为与输入数据中的类频率成反比的权重。如 n_samples / (n_classes * np.bincount(y)) |

| warm_start | bool, default=False 设置为True时,重用前面调用的解决方案来进行初始化,否则,只清除前面的解决方案。请参阅词汇表。 当warm_start为True时,重复调用fit或partial_fit可能会导致解决方案与一次调用fit时有所不同,这是因为数据的重排方式不同。如果使用动态学习率,则根据已经看到的样本数调整学习率。调用 fit会重置此计数器,而partial_fit会导致增加现有计数器。 |

| average | bool or int, default=False 设置为True时,将计算平均SGD权重并将结果存储在 coef_属性中。如果将int设置为大于1,则一旦看到的样本总数达到平均值就会开始平均。如average=10,将在看到10个样本后开始平均。 |

| 属性 | 说明 |

|---|---|

| coef_ | ndarray of shape (1, n_features) if n_classes == 2 else (n_classes, n_features) 分配给特征的权重。 |

| intercept_ | ndarray of shape (1,) if n_classes == 2 else (n_classes,) 决策函数中的常数项。 |

| n_iter_ | int 达到停止标准之前的实际迭代次数。对于多类别拟合,它是每个二分类拟合的最大值。 |

| loss_function_ | concrete LossFunction |

| classes_ | array of shape (n_classes,) |

| t_ | int 训练期间进行的权重更新次数,与 (n_iter_ * n_samples)相同。 |

另见

线性支持向量分类。

逻辑回归。

继承自SGDClassifier。

Perceptron()等同于SGDClassifier(loss="perceptron", eta0=1, learning_rate="constant", penalty=None)。

示例

>>> import numpy as np

>>> from sklearn.linear_model import SGDClassifier

>>> from sklearn.preprocessing import StandardScaler

>>> from sklearn.pipeline import make_pipeline

>>> X = np.array([[-1, -1], [-2, -1], [1, 1], [2, 1]])

>>> Y = np.array([1, 1, 2, 2])

>>> # Always scale the input. The most convenient way is to use a pipeline.

>>> clf = make_pipeline(StandardScaler(),

... SGDClassifier(max_iter=1000, tol=1e-3))

>>> clf.fit(X, Y)

Pipeline(steps=[('standardscaler', StandardScaler()),

('sgdclassifier', SGDClassifier())])

>>> print(clf.predict([[-0.8, -1]]))

[1]

| 方法 | 说明 |

|---|---|

decision_function(self, X) |

预测样本的置信度得分。 |

densify(self) |

将系数矩阵转换为密集数组格式。 |

fit(self, X, y[, coef_init, intercept_init, …]) |

用随机梯度下降拟合线性模型。 |

get_params(self[, deep]) |

获取此估计器的参数。 |

partial_fit(self, X, y[, classes, sample_weight]) |

对给定的样本进行一次随机梯度下降。 |

predict(self, X) |

预测X中样本的类别标签。 |

score(self, X, y[, sample_weight]) |

返回给定测试数据和标签上的平均准确度。 |

set_params(self, **kwargs) |

设置并验证估计器的参数。 |

sparsify(self) |

将系数矩阵转换为稀疏格式。 |

__init__(self, loss='hinge', *, penalty='l2', alpha=0.0001, l1_ratio=0.15, fit_intercept=True, max_iter=1000, tol=0.001, shuffle=True, verbose=0, epsilon=0.1, n_jobs=None, random_state=None, learning_rate='optimal', eta0=0.0, power_t=0.5, early_stopping=False, validation_fraction=0.1, n_iter_no_change=5, class_weight=None, warm_start=False, average=False)

初始化self, 请参阅help(type(self))以获得准确的说明。

decision_function(self, X)

预测样本的置信度得分。

样本的置信度分数是该样本到超平面的符号距离。

| 参数 | 说明 |

|---|---|

| X | array_like or sparse matrix, shape (n_samples, n_features) 样本数据。 |

| 返回值 | 说明 |

|---|---|

| array, shape=(n_samples,) if n_classes == 2 else (n_samples, n_classes) 每个(样本,类别)组合的置信度得分。在二分类情况下,self.classes_ [1]的置信度得分> 0表示将预测该类。 |

densify(self)

将系数矩阵转换为密集数组格式。

将coef_数值(返回)转换为numpy.ndarray。这是coef_的默认格式,并且是拟合模型所需的格式,因此仅在之前被稀疏化的模型上才需要调用此方法。否则,它是无操作的。

| 返回值 | 说明 |

|---|---|

| self | 拟合估计器。 |

fit(self, X, y, coef_init=None, intercept_init=None, sample_weight=None)

[源码]

用随机梯度下降拟合线性模型。

| 参数 | 说明 |

|---|---|

| X | {array-like, sparse matrix} of shape (n_samples, n_features) 训练数据 |

| y | array-like of shape (n_samples,) 目标标签。 |

| coef_init | ndarray of shape (n_classes, n_features), default=None 用于热启动优化的初始系数。 |

| intercept_init | ndarray of shape (n_classes,), default=None 初始截距以热启动优化。 |

| sample_weight | array-like, shape (n_samples,), default=None 权重应用于各个样本。如果未提供,则假定权重相同。如果指定了class_weight,则这些权重将与class_weight(通过构造函数传递)相乘。 |

| 返回值 | 说明 |

|---|---|

| self | 返回self的实例。 |

get_params(self,deep = True )

[源码]

获取此估计器的参数。

| 参数 | 说明 |

|---|---|

| deep | bool, default=True 如果为True,返回此估计器和所包含子对象的参数。 |

| 返回值 | 说明 |

|---|---|

| params | mapping of string to any 参数名称映射到其值。 |

partial_fit(self, X, y, classes=None, sample_weight=None)

[源码]

对给定的样本进行一次随机梯度下降的迭代。

在内部,此方法使用max_iter = 1。因此,不能保证调用一次后达到损失函数的最小值。目标收敛、提前停止等问题由用户自行处理。

| 参数 | 说明 |

|---|---|

| X | {array-like, sparse matrix}, shape (n_samples, n_features) 训练数据的子集 |

| y | ndarray of shape (n_samples,) 目标值的子集 |

| classes | ndarray of shape (n_classes,), default=None partial_fit调用中所有的类。可以通过 np.unique(y_all)获得,其中y_all是整个数据集的目标向量。第一次调用partial_fit时需要此参数,在后续调用中可以将其省略。请注意,y不需要包含classes中的所有标签。 |

| sample_weight | array-like, shape (n_samples,), default=None 权重应用于各个样本。如果未提供,则假定权重相同。 |

| 返回值 | 说明 |

|---|---|

| self | 返回self的实例。 |

predict(self, X)

[源码]

预测X中样本的类别标签。

| 参数 | 说明 |

|---|---|

| X | array_like or sparse matrix, shape (n_samples, n_features) 样本数据 |

| 返回值 | 说明 |

|---|---|

| C | array, shape [n_samples] 每个样本的预测类别标签。 |

property predict_log_proba

概率估计的对数。

此方法仅适用于对数损失和修正Huber损失。

当loss =“ modified_huber”时,概率估计只可能是0和1,所以取对数是不可能的。

详细信息请参见predict_proba。

| 参数 | 说明 |

|---|---|

| X | {array-like, sparse matrix} of shape (n_samples, n_features) 进行预测的样本数据。 |

| 返回值 | 说明 |

|---|---|

| T | array-like, shape (n_samples, n_classes) 返回模型中每个类的样本的对数概率,按 self.classes_中的类别顺序排序 。 |

property predict_proba

概率估计。

此方法仅适用于对数损失和修正Huber损失。

根据Zadrozny和Elkan的建议,通过简单的归一化方法从二元(one-vs.-rest)估计值中得出多类概率估计值。

对于损失函数为“ modified_huber”的二分类概率估计值由(clip(decision_function(X),-1,1)+ 1)/ 2给出。对于其他损失函数,有必要通过用sklearn.calibration.CalibratedClassifierCV分类器包裹来进行适当的概率校准 。

| 参数 | 说明 |

|---|---|

| X | {array-like, sparse matrix}, shape (n_samples, n_features) 进行预测的样本数据。 |

| 返回值 |

|---|

| ndarray of shape (n_samples, n_classes) 返回模型中每个类的样本概率,按 self.classes_中的类别顺序排序 。 |

参考

Zadrozny and Elkan, “Transforming classifier scores into multiclass probability estimates”, SIGKDD’02, http://www.research.ibm.com/people/z/zadrozny/kdd2002-Transf.pdf

The justification for the formula in the loss=”modified_huber” case is in the appendix B in: http://jmlr.csail.mit.edu/papers/volume2/zhang02c/zhang02c.pdf

score(self,X,y,sample_weight = None )

[源码]

返回给定测试数据和标签上的平均准确度。

在多标签分类中,这是子集准确性,这是一个严格的指标,因为你需要为每个样本正确预测对应的标签集。

| 参数 | 说明 |

|---|---|

| X | array-like of shape (n_samples, n_features) 测试样本。 |

| y | array-like of shape (n_samples,) or (n_samples, n_outputs) X的真实标签。 |

| sample_weight | array-like of shape (n_samples,), default=None 样本权重。 |

| 返回值 | 说明 |

|---|---|

| score | float 预测标签与真实标签的平均准确度 |

set_params(self, **kwargs)

[源码]

设置并验证估计器的参数。

| 参数 | 说明 |

|---|---|

| **kwargs | dict 估计器参数。 |

| 返回值 | 说明 |

|---|---|

| self | object 估计器实例。 |

sparsify(self)

[源码]

将系数矩阵转换为稀疏格式。

将coef_数值转换为scipy.sparse矩阵,对于L1正规化的模型,该矩阵比通常的numpy.ndarray具有更高的内存和存储效率。

该intercept_数值未转换。

| 返回值 | 说明 |

|---|---|

| self | 拟合估计器。 |

注

对于非稀疏模型,即当coef_中零的个数不多时,这实际上可能会增加内存使用量,因此请谨慎使用此方法。经验法则是,可以使用(coef_ == 0).sum()计算得到的零元素的数量必须大于50%,这时的效果是显着的。

在调用densify之前,调用此方法将无法进一步使用partial_fit方法(如果有)。