sklearn.neighbors.KNeighborsClassifier¶

class sklearn.neighbors.KNeighborsClassifier(n_neighbors=5, *, weights='uniform', algorithm='auto', leaf_size=30, p=2, metric='minkowski', metric_params=None, n_jobs=None, **kwargs)

分类器执行k最近邻投票。

在用户指南中阅读更多内容。

| 参数 | 说明 |

|---|---|

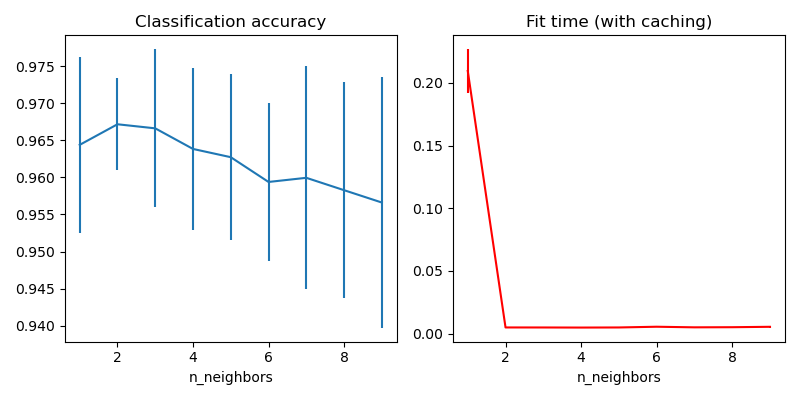

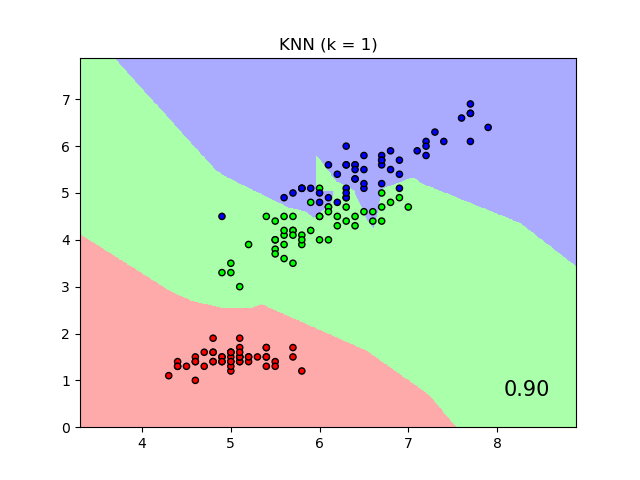

| n_neighbors | int, default=5 默认情况下用于kneighbors查询的近邻数 |

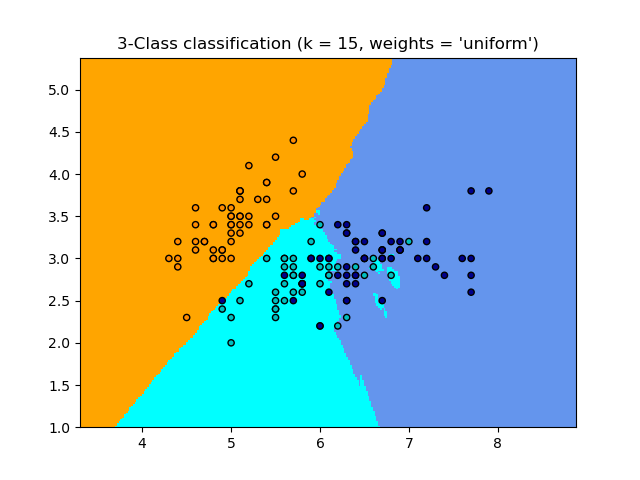

| weights | {‘uniform’, ‘distance’} or callable, default=’uniform’ 预测中使用的权重函数。 可能的值: “uniform”:统一权重。 每个邻域中的所有点均被加权。 “distance”:权重点与其距离的倒数。 在这种情况下,查询点的近邻比远处的近邻具有更大的影响力。 [callable]:用户定义的函数,该函数接受距离数组,并返回包含权重的相同形状的数组。 |

| algorithm | {‘auto’, ‘ball_tree’, ‘kd_tree’, ‘brute’}, default=’auto’ 用于计算最近临近点的算法: “ ball_tree”将使用BallTree kd_tree”将使用KDTree “brute”将使用暴力搜索。 “auto”将尝试根据传递给fit方法的值来决定最合适的算法。 注意:在稀疏输入上进行拟合将使用蛮力覆盖此参数的设置。 |

| leaf_size | int, default=30 叶大小传递给BallTree或KDTree。 这会影响构造和查询的速度,以及存储树所需的内存。 最佳值取决于问题的性质。 |

| p | int, default=2 Minkowski指标的功率参数。 当p = 1时,这等效于对p = 2使用manhattan_distance(l1)和euclidean_distance(l2)。对于任意p,使用minkowski_distance(l_p)。 |

| metric | str or callable, default=’minkowski’ 树使用的距离度量。 默认度量标准为minkowski,p = 2等于标准欧几里德度量标准。 有关可用度量的列表,请参见DistanceMetric的文档。 如果度量是“预先计算的”,则X被假定为距离矩阵,并且在拟合过程中必须为平方。 X可能是一个稀疏图,在这种情况下,只有“非零”元素可以被视为临近点。 |

| metric_params | dict, default=None 度量功能的其他关键字参数。 |

| n_jobs | int, default=None 为临近点搜索运行的并行作业数。 除非在joblib.parallel_backend上下文中,否则None表示1。 -1表示使用所有处理器。 有关更多详细信息,请参见词汇表。 不会影响拟合方法。 |

| 属性 | 说明 |

|---|---|

| classes_ | array of shape (n_classes,) 分类器已知的类标签 |

| effective_metric_ | str or callble 使用的距离度量。 它将与度量参数相同或与其相同,例如 如果metric参数设置为“ minkowski”,而p参数设置为2,则为“ euclidean”。 |

| effective_metric_params_ | dict 度量功能的其他关键字参数。 对于大多数指标而言,它与metric_params参数相同,但是,如果将valid_metric_属性设置为“ minkowski”,则也可能包含p参数值。 |

| outputs_2d_ | bool 在拟合期间,当y的形状为(n_samples,)或(n_samples,1)时为False,否则为True。 |

另见

注意

有关算法选择和leaf_size的讨论,请参见在线文档中的最近邻。

警告:关于最近临近点算法,如果发现两个临近点(临近点k + 1和k)具有相同的距离但标签不同,则结果将取决于训练数据的顺序。

https://en.wikipedia.org/wiki/K-nearest_neighbor_algorithm

示例

>>> X = [[0], [1], [2], [3]]

>>> y = [0, 0, 1, 1]

>>> from sklearn.neighbors import KNeighborsClassifier

>>> neigh = KNeighborsClassifier(n_neighbors=3)

>>> neigh.fit(X, y)

KNeighborsClassifier(...)

>>> print(neigh.predict([[1.1]]))

[0]

>>> print(neigh.predict_proba([[0.9]]))

[[0.66666667 0.33333333]]

方法

| 方法 | 说明 |

|---|---|

fit(, X, y) |

使用X作为训练数据和y作为目标值拟合模型 |

get_params([, deep]) |

获取此估计量的参数。 |

kneighbors([, X, n_neighbors, …]) |

查找点的K临近点。 |

kneighbors_graph([, X, n_neighbors, mode]) |

计算X中点的k临近点的(加权)图 |

predict(, X) |

预测提供的数据的类标签。 |

predict_proba(, X) |

测试数据X的返回概率估计。 |

score(, X, y[, sample_weight]) |

返回给定测试数据和标签上的平均准确度。 |

set_params(, **params) |

设置此估算器的参数。 |

__init__(n_neighbors=5, *, weights='uniform', algorithm='auto', leaf_size=30, p=2, metric='minkowski', metric_params=None, n_jobs=None, **kwargs)

[源码]

初始化. 请参阅help(type())以获得准确的说明。

fit(X, y)

[源码]

使用X作为训练数据和y作为目标值拟合模型

| 参数 | 说明 |

|---|---|

| X | {array-like, sparse matrix, BallTree, KDTree} 训练数据。 如果是数组或矩阵,则将其形状设置为[n_samples,n_features],如果是metric =“ precomputed”,则为[n_samples,n_samples]。 |

| y | {array-like, sparse matrix} 形状的目标值= [n_samples]或[n_samples,n_outputs] |

get_params(deep=True)

获取此估计量的参数。

| 参数 | 说明 |

|---|---|

| deep | bool, default=True 如果为True,则将返回此估算器和作为估算器的所包含子对象的参数。 |

| 返回值 | 说明 |

|---|---|

| params | mapping of string to any 参数名称映射到其值。 |

kneighbors(X=None, n_neighbors=None, return_distance=True)

[源码]

查找点的K临近点。 返回每个点的临近点的索引和与之的距离。

| 参数 | 说明 |

|---|---|

| X | array-like, shape (n_queries, n_features), or (n_queries, n_indexed) if metric == ‘precomputed’ 查询点。 如果未提供,则返回每个索引点的临近点。 在这种情况下,查询点不被视为其自己的临近点。 |

| n_neighbors | int 要获取的临近点数(默认值为传递给构造函数的值)。 |

| return_distance | boolean, optional. Defaults to True. 如果为False,则不会返回距离 |

| 返回值 | 说明 |

|---|---|

| neigh_dist | array, shape (n_queries, n_neighbors) 表示点的长度的数组,仅在return_distance = True时存在 |

| neigh_ind | array, shape (n_queries, n_neighbors) 总体矩阵中最近点的索引。 |

示例

在下面的示例中,我们从代表我们的数据集的数组构造一个NearestNeighbors类,并询问谁最接近[1,1,1]

>>> samples = [[0., 0., 0.], [0., .5, 0.], [1., 1., .5]]

>>> from sklearn.neighbors import NearestNeighbors

>>> neigh = NearestNeighbors(n_neighbors=1)

>>> neigh.fit(samples)

NearestNeighbors(n_neighbors=1)

>>> print(neigh.kneighbors([[1., 1., 1.]]))

(array([[0.5]]), array([[2]]))

如您所见,它返回[[0.5]]和[[2]],这意味着该元素位于距离0.5处,并且是样本的第三个元素(索引从0开始)。 您还可以查询多个点:

>>> X = [[0., 1., 0.], [1., 0., 1.]]

>>> neigh.kneighbors(X, return_distance=False)

array([[1],

[2]]...)

[源码]

计算X中点的k临近点的(加权)图形

| 参数 | 说明 |

|---|---|

| X | array-like, shape (n_queries, n_features), or (n_queries, n_indexed) if metric == ‘precomputed’ 查询点。 如果未提供,则返回每个索引点的临近点。 在这种情况下,查询点不被视为其自己的临近点。 |

| n_neighbors | int 每个样本的临近点数。 (默认值为传递给构造函数的值)。 |

| mode | {‘connectivity’, ‘distance’}, optional 返回矩阵的类型:“连通性”将返回具有1和0的连通性矩阵,在“距离”中,边为点之间的欧几里得距离。 |

| 返回值 | 说明 |

|---|---|

| A | sparse graph in CSR format, shape = [n_queries, n_samples_fit] n_samples_fit是拟合数据中的样本数A [i,j],分配了将i连接到j的边的权重。 |

另见:

示例

>>> X = [[0], [3], [1]]

>>> from sklearn.neighbors import NearestNeighbors

>>> neigh = NearestNeighbors(n_neighbors=2)

>>> neigh.fit(X)

NearestNeighbors(n_neighbors=2)

>>> A = neigh.kneighbors_graph(X)

>>> A.toarray()

array([[1., 0., 1.],

[0., 1., 1.],

[1., 0., 1.]])

predict(X)

[源码]

预测提供的数据的类标签。

| 参数 | 说明 |

|---|---|

| X | array-like of shape (n_queries, n_features), or (n_queries, n_indexed) if metric == ‘precomputed’ 测试样品。 |

| 返回值 | 说明 |

|---|---|

| y | ndarray of shape (n_queries,) or (n_queries, n_outputs) 每个数据样本的类标签。 |

predict_proba(X)

[源码]

测试数据X的返回概率估计。

| 参数 | 说明 |

|---|---|

| X | array-like of shape (n_queries, n_features), or (n_queries, n_indexed) if metric == ‘precomputed’ 测试样品。 |

| 返回值 | 说明 |

|---|---|

| p | ndarray of shape (n_queries, n_classes), or a list of n_outputs 如果n_outputs> 1,则为此类数组。输入样本的类概率。 类按字典顺序排序。 |

score(X, y, sample_weight=None)

[源码]

返回给定测试数据和标签上的平均准确度。

在多标签分类中,这是子集准确性,这是一个严格的指标,因为您需要为每个样本正确预测每个标签集。

| 参数 | 说明 |

|---|---|

| X | array-like of shape (n_samples, n_features) 测试样本 |

| y | array-like of shape (n_samples,) or (n_samples, n_outputs) X的真实标签。 |

| sample_weight | array-like of shape (n_samples,), default=None 样品权重。 |

| 返回值 | 说明 |

|---|---|

| score | float .predict(X) wrt. y.的平均准确度 |

set_params( **params)

[源码]

设置此估算器的参数。

该方法适用于简单的估计器以及嵌套对象(例如管道)。 后者的参数格式为

| 参数 | 说明 |

|---|---|

| params | dict 估算器参数。 |

| 返回值 | 说明 |

|---|---|

| self | object 估算器实例。 |