用邻域成分分析进行降维¶

用于降维的邻域成分分析的样本案例。

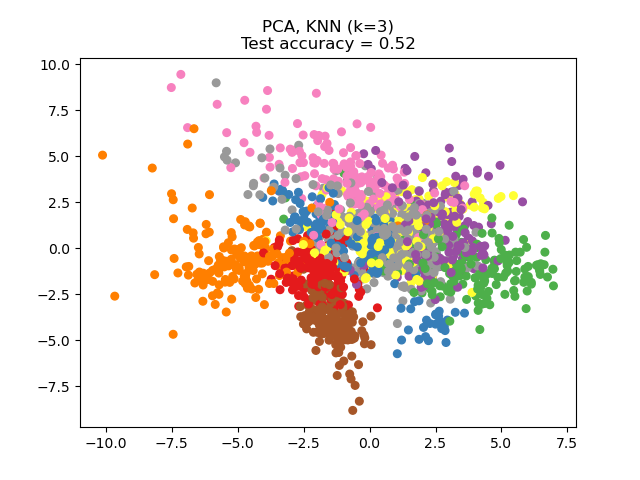

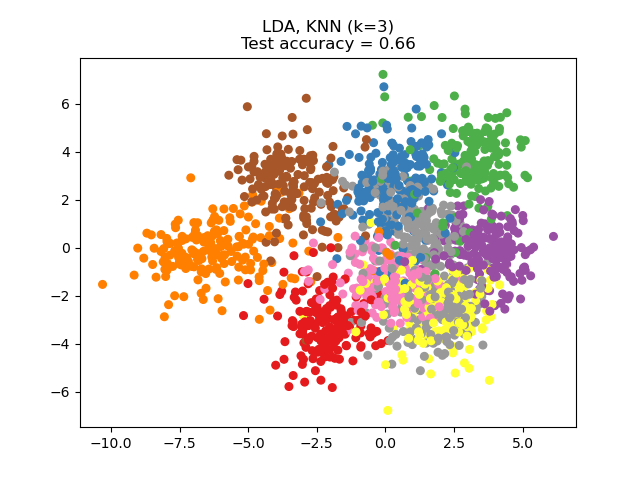

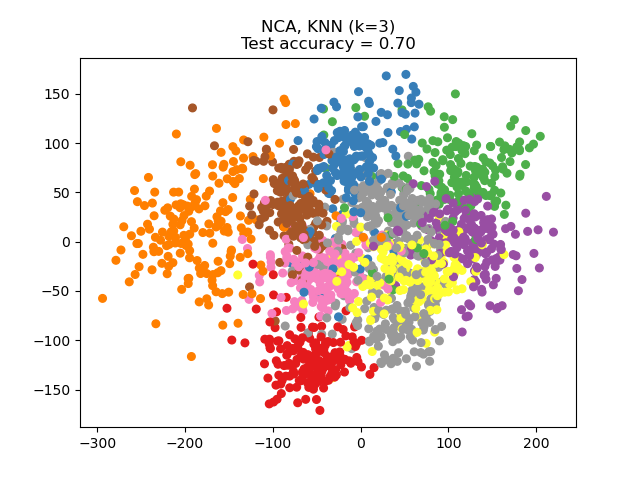

本案例比较了应用于手写数字数据集的不同的(线性)降维方法。数据集包含从0到9的数字图像,每个类别大约有180个样本。每个图像的尺寸为8x8 = 64,在这里我们将其缩小为二维数据点。

应用于此数据的主成分分析(PCA)可以识别出说明数据差异最大的特征组合(又被称为主成分或特征空间中的方向)。在这里,我们在2个第一主成分上绘制了不同的样本。

线性判别分析(LDA)尝试识别出类别之间差异最大的属性。尤其是,与PCA相比,LDA是使用已知类别标签的受监督方法。

邻域成分分析(NCA)试图找到一个特征空间,以使随机最近邻算法具有最佳准确性。像LDA一样,它是一种受监督的方法。

可以看到,尽管维数大大减少,但NCA还是对数据进行了聚类,这在视觉上是有意义的。

输入:

# 执照: BSD 3 clause

import numpy as np

import matplotlib.pyplot as plt

from sklearn import datasets

from sklearn.model_selection import train_test_split

from sklearn.decomposition import PCA

from sklearn.discriminant_analysis import LinearDiscriminantAnalysis

from sklearn.neighbors import (KNeighborsClassifier,

NeighborhoodComponentsAnalysis)

from sklearn.pipeline import make_pipeline

from sklearn.preprocessing import StandardScaler

print(__doc__)

n_neighbors = 3

random_state = 0

# 导入手写数字数据集

X, y = datasets.load_digits(return_X_y=True)

# 分类训练集与测试集

X_train, X_test, y_train, y_test = \

train_test_split(X, y, test_size=0.5, stratify=y,

random_state=random_state)

dim = len(X[0])

n_classes = len(np.unique(y))

# 使用PCA将维度降到2维

pca = make_pipeline(StandardScaler(),

PCA(n_components=2, random_state=random_state))

# 使用LinearDiscriminantAnalysis将维度减小到2维

lda = make_pipeline(StandardScaler(),

LinearDiscriminantAnalysis(n_components=2))

# 使用NeighbourhoodComponentAnalysis将维度减小到2维

nca = make_pipeline(StandardScaler(),

NeighborhoodComponentsAnalysis(n_components=2,

random_state=random_state))

# 使用最近邻分类器

knn = KNeighborsClassifier(n_neighbors=n_neighbors)

# 列出需要比较的方法

dim_reduction_methods = [('PCA', pca), ('LDA', lda), ('NCA', nca)]

# plt.figure()

for i, (name, model) in enumerate(dim_reduction_methods):

plt.figure()

# plt.subplot(1, 3, i + 1, aspect=1)

# 拟合模型

model.fit(X_train, y_train)

# 在嵌入式训练集上拟合最近邻分类器

knn.fit(model.transform(X_train), y_train)

# 计算嵌入式测试集上的最近邻精度

acc_knn = knn.score(model.transform(X_test), y_test)

# 使用拟合模型将数据集嵌入2维

X_embedded = model.transform(X)

# 绘制预测点并显示评估分数

plt.scatter(X_embedded[:, 0], X_embedded[:, 1], c=y, s=30, cmap='Set1')

plt.title("{}, KNN (k={})\nTest accuracy = {:.2f}".format(name,

n_neighbors,

acc_knn))

plt.show()

脚本的总运行时间:(0分钟2.546秒)